功能

2024年 4月 23日

借助 Union.ai 和 NVIDIA DGX 云实现 AI 工作流程的大众化

GPU 最初专用于在电子游戏中渲染 3D 图形,主要用于加速线性代数计算。如今,GPU 已成为 AI 革命的关键组成部分之一。 现在,

2 MIN READ

2024年 4月 22日

借助 NVIDIA TensorRT-LLM 和 NVIDIA Triton 推理服务器提升 Meta Llama 3 性能

我们很高兴地宣布支持 Meta Llama 3 系列模型,通过 NVIDIA TensorRT LLM 加速和优化 LLM 推理性能。

2 MIN READ

2024年 4月 22日

借助 NVIDIA Aerial CUDA 加速 RAN,增强 5G/6G 的 DU 性能和工作负载整合

Aerial CUDA 加速无线电接入网 (RAN) 可加速电信工作负载,使用 CPU、

5 MIN READ

2024年 4月 22日

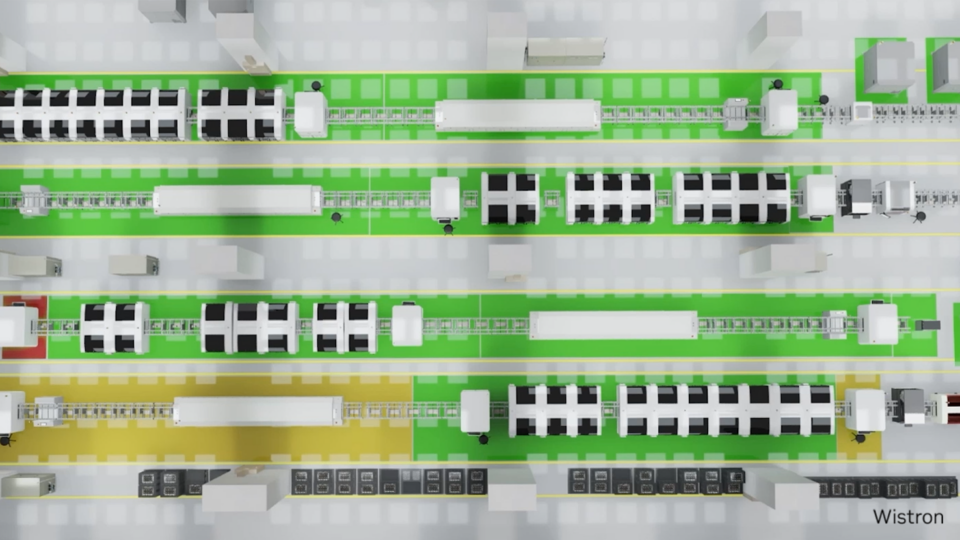

使用 OpenUSD 和 NVIDIA Omniverse 开发虚拟工厂解决方案

与 NVIDIA AI、Omniverse 和通用场景描述 (OpenUSD) 等平台一起,业界开发者正在构建虚拟工厂解决方案。

1 MIN READ

2024年 4月 19日

测量多流工作负载的 GPU 占用率

随着新一代产品的推出, NVIDIA GPU 的性能也变得越来越强大。这种提升通常有两种形式。每个流多处理器 (SM) (GPU 的主力)…

3 MIN READ

2024年 4月 18日

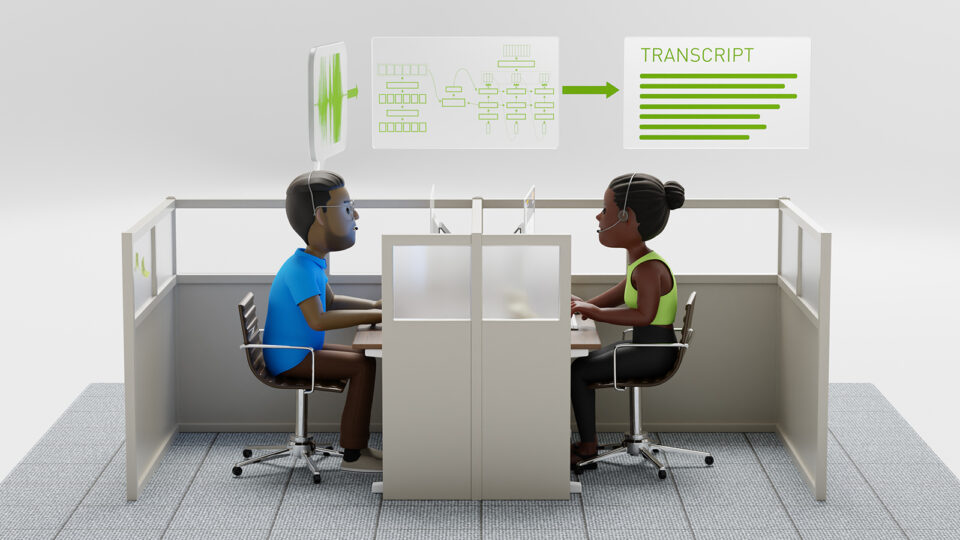

借助 NVIDIA NeMo Parakeet ASR 模型突破语音识别的界限

NVIDIA NeMo Parakeet 是一个端到端平台,用于在任何地方(任何云端和本地)大规模开发多模态生成式 AI 模型,

2 MIN READ

2024年 4月 18日

借助 NVIDIA NeMo Parakeet-TDT 提高 ASR 的准确性和速度

NVIDIA NeMo 是一个端到端平台,用于在任何云和本地的任何地方大规模开发多模式生成 AI 模型,最近发布了 Parakeet-TDT。

2 MIN READ

2024年 4月 18日

NVIDIA NeMo Canary 模型的语音识别和翻译新标准

NVIDIA NeMo 是一种端到端平台,用于开发和部署多模态 生成式 AI 模型。它可以随时随地进行大规模模型部署。

2 MIN READ

2024年 4月 17日

使用 GPU 加速的 nvImageCodec 推进医学影像解码

本文将深入分析 DICOM 医学影像的解码功能。AWS HealthImaging 利用 NVIDIA 的 nvJPEG2000 库…

5 MIN READ

2024年 4月 10日

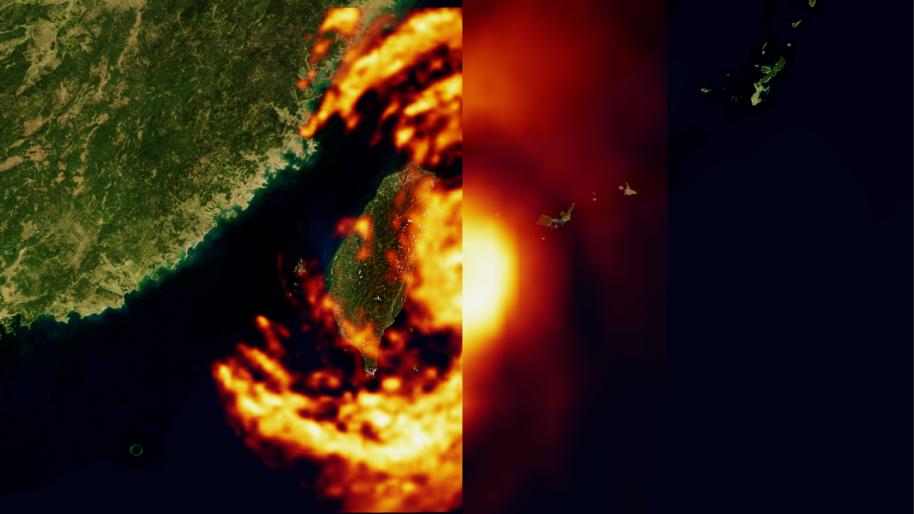

生成式 AI 如何借助 NVIDIA Earth-2 为气候技术赋能

在全球变暖的背景下,NVIDIA Earth-2 已成为气候技术的关键平台,在应对气候变化放大的越来越严重的极端天气影响方面产生可行的见解。

3 MIN READ

2024年 4月 3日

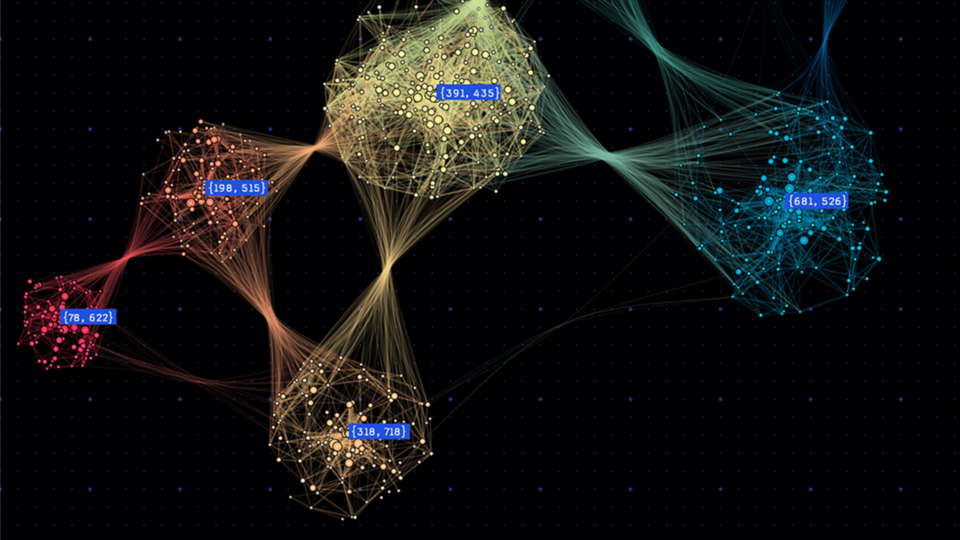

使用 WholeGraph 优化图形神经网络的内存和检索,第 2 部分

大规模图形神经网络 (GNN) 训练带来了艰巨的挑战,特别是在图形数据的规模和复杂性方面。这些挑战不仅涉及神经网络的正向和反向计算的典型问题,

2 MIN READ

2024年 4月 2日

使用 NVIDIA TensorRT-LLM 调整和部署 LoRA LLM

大型语言模型 (LLM) 可以从大量文本中学习,并为各种任务和领域生成流畅、一致的文本,从而彻底改变自然语言处理 (NLP)。然而,

7 MIN READ

2024年 3月 27日

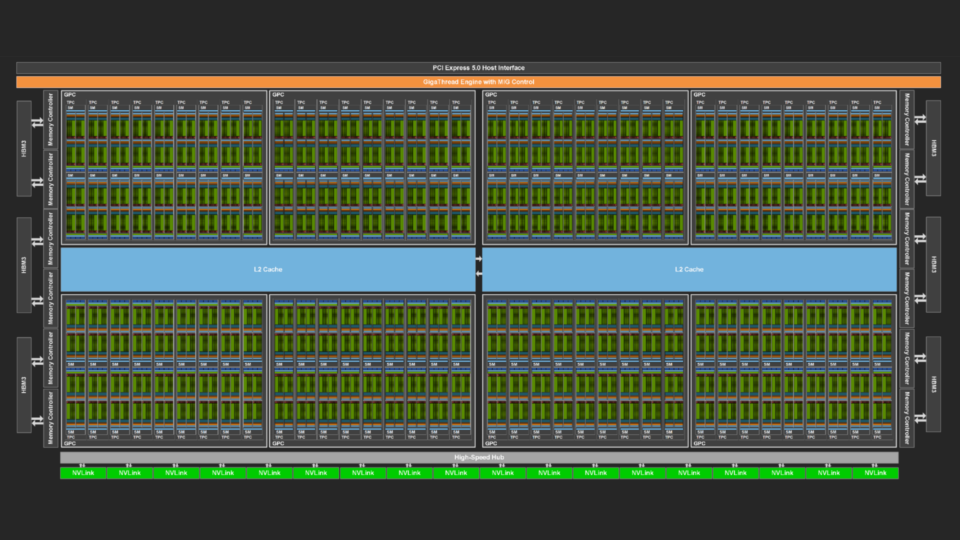

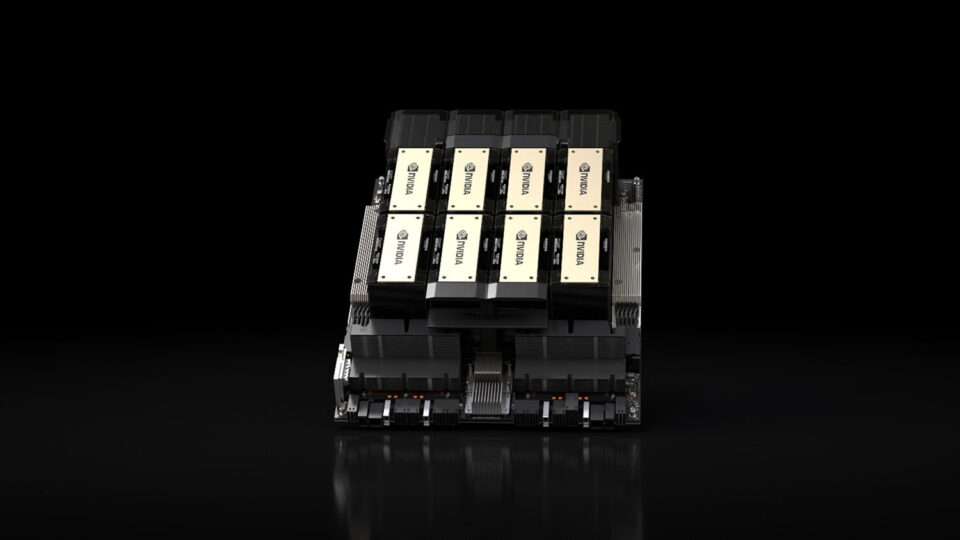

NVIDIA H200 Tensor Core GPU 和 NVIDIA TensorRT-LLM 集 MLPerf LLM 推理记录

随着生成式 AI 模型的持续创新,生成式 AI 在计算应用方面取得了巨大进步,从而大幅增强人类能力。这些模型包括 生成式 AI 模型,

3 MIN READ

2024年 3月 27日

借助 NVIDIA NeMo 定制器轻松微调和对齐 LLM

随着 大型语言模型(LLM) 在企业 AI 应用中获得更多吸引力,定制化模型 理解和集成特定行业术语、

1 MIN READ

2024年 3月 27日

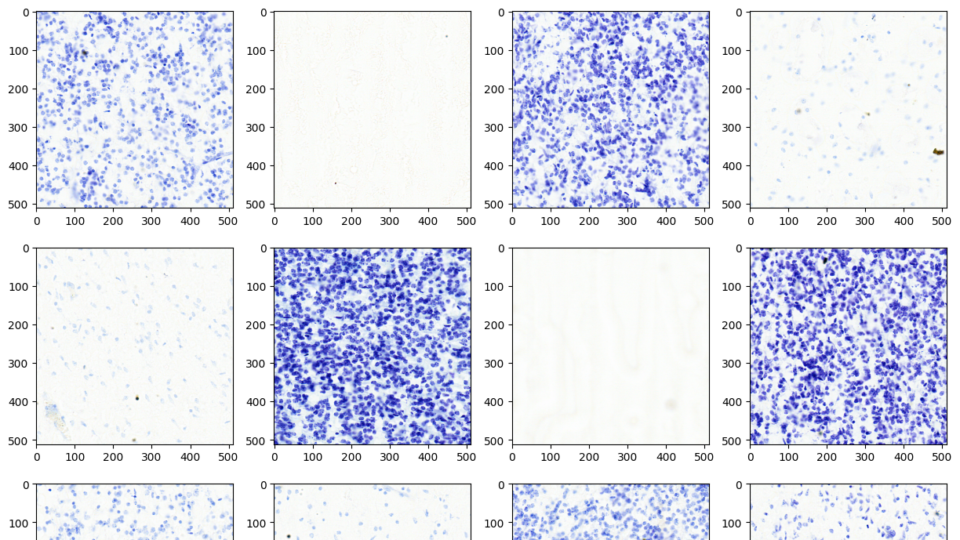

借助 NVIDIA NeMo Curator 扩展和整理用于 LLM 训练的高质量数据集

大型语言模型 (LLM) 是提高运营效率和推动创新的强大工具。NVIDIA NeMo 微服务 旨在简化构建和部署模型的流程。

1 MIN READ

2024年 3月 27日

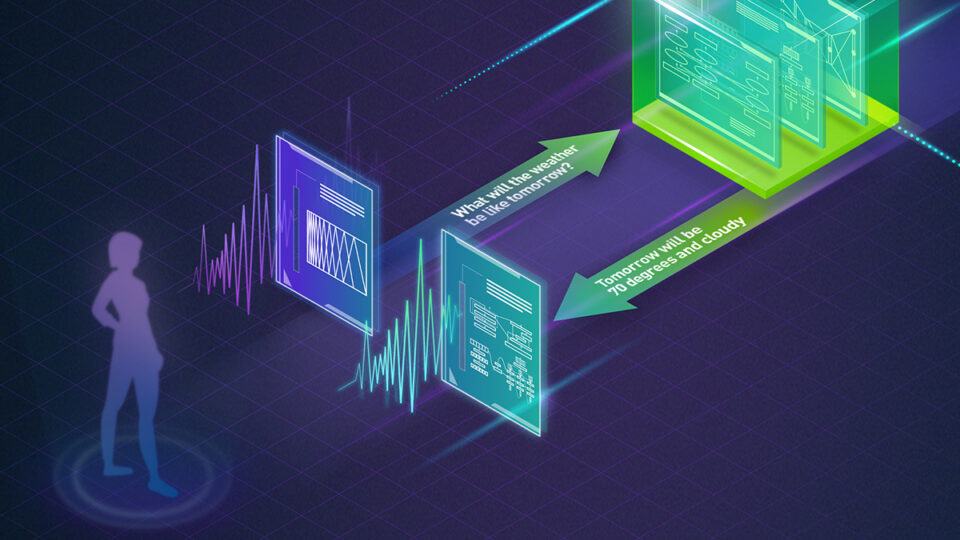

借助 NVIDIA NeMo 开发自定义企业生成式 AI

生成式 AI 在计算领域发生了翻身,为人类以自然、直观的方式与计算机交互打开了新方式。对于企业来说,生成式 AI 的潜力巨大。

3 MIN READ