Cosmos、DeepSeek、Gemma、GPT-OSS、Llama、Nemotron、Phi、Qwen 等开源 AI 模型构成了人工智能创新的基石。通过向全球的研究人员、初创企业及各类组织免费提供模型权重、架构设计和训练方法,这些模型极大地推动了人工智能技术的普及与 democratization。

全球各地的开发者都可以学习并构建创新技术,例如专家混合(MoE)、新型注意力机制核、推理后训练等,而无需从零开始。正如本文所述,这种技术民主化得益于专用于加速人工智能的 NVIDIA 系统与开源软件的广泛应用,覆盖从云端和数据中心到桌面及边缘设备的各个场景。

NVIDIA Blackwell 架构如何通过 NVFP4 大规模加速 AI?

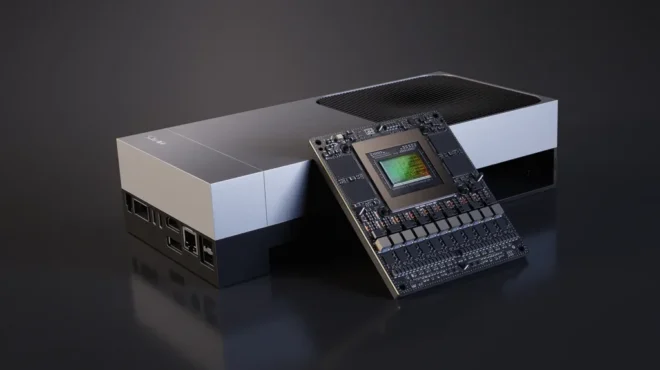

NVIDIA Blackwell GPU 架构是一款专为人工智能打造的超级芯片,集成了第五代 Tensor Core 和全新的 NVFP4(4 位浮点)数字格式,可提供高精度的大规模计算性能。该架构搭载了新一代高带宽互连技术 NVIDIA NVLink‑72,实现超高速的 GPU-to-GPU 通信,并支持多 GPU 扩展,满足严苛 AI 工作负载的需求。此外,Blackwell GPU 还配备了第二代 Transformer 引擎和 NVLink Fusion 技术,进一步提升性能与效率。

开源工具如何推动 AI 创新?

加速 AI 不仅需要强大的硬件和开源 AI 模型,还需要一个经过优化且持续快速演进的软件堆栈,以应对当今严苛的 AI 工作负载,实现最佳性能。

NVIDIA 通过发布开源工具、模型和数据集,推动系统层面的创新,助力开发者普及尖端 AI 功能。您可以在 NVIDIA GitHub 仓库中找到 1,000 多个开源工具,在 NVIDIA Hugging Face 集合中则可获取 450 多个模型和 80 多个数据集。

这种全面的开源方法覆盖了从基础数据处理工具到完整的 AI 开发与部署框架的整个 NVIDIA 软件堆栈。NVIDIA 发布了多个开源 CUDA-X 库,这些库能够加速互连工具的整个生态系统,使开发者可以充分释放 Blackwell 等先进硬件上开源 AI 的全部潜力。

开源 AI 工具开发流程如何运作?

开源 AI 工具的开发流程始于数据准备与分析。 RAPIDS 是一个开源的 GPU 加速 Python 库套件,可显著加速数据准备和 ETL(提取、转换、加载)流程,并直接支持模型训练。通过 RAPIDS,AI 工作负载能够实现端到端的 GPU 运行,有效消除代价高昂的 CPU 瓶颈,从而加快训练与推理速度。

数据管线加速完成后,下一步是模型训练。 NVIDIA NeMo 框架是一个面向大语言模型(LLM)、多模态模型和语音模型的端到端训练框架,能够将预训练和后训练的工作负载从单个 GPU 无缝扩展到支持 Hugging Face/PyTorch 和 Megatron 模型的千节点集群。

NVIDIA PhysicsNeMo 是一个物理信息机器学习(Physics-ML)框架,可帮助研究人员和工程师将物理定律融入神经网络,从而加速数字孪生的开发与科学模拟进程。 NVIDIA BioNeMo 则将生成式 AI 引入生命科学领域,提供预训练模型及基于加速优化的 NVIDIA NIM 微服务,并配备用于蛋白质结构预测、分子设计和药物发现的工具,助力科研人员加快在生物学与医疗健康领域的突破性进展。

这些框架利用 NCCL,一个用于多 GPU 和多节点集体通信的开源 CUDA-X 库。NVIDIA NeMo、PhysicsNeMo 和 BioNeMo 在 PyTorch 的基础上,通过先进的生成式 AI 功能进行扩展,帮助开发者构建、定制和部署强大的生成式 AI 应用,突破传统深度学习工作流的局限。

在完成模型训练后,开发者需要高效地提供推理服务。NVIDIA TensorRT 推理堆栈(包括 TensorRT-LLM 和 TensorRT 模型优化器),提供了经过优化的内核和量化工具,支持大规模模型的部署。TensorRT-LLM 充分利用全新的 Blackwell 指令集和 FP4 格式,进一步提升性能,从而在大型模型上实现更快速、更节省内存的推理。

使用 CUTLASS 的内核开发者可以实现自定义解决方案,CUTLASS 是一个开源的 CUDA C++ 模板库。它简化了编写高性能 GPU 内核的过程,特别适用于矩阵-矩阵乘法(GEMM),而 GEMM 正是深度学习的核心基础。

NVIDIA Dynamo 是一个开源且框架无关的推理服务平台,能够高效地支持大规模用户服务。该平台兼容 PyTorch、TensorRT-LLM、vLLM 和 SGLang,旨在通过分离推理的不同阶段,并结合智能的 LLM 意识调度,扩展 AI 推理能力,从而最大化 AI 工厂的 token 吞吐量。

Dynamo 还集成了 NIXL,这是一个开源的高吞吐量、低延迟通信库,专为 AI 推理环境中的数据传输而优化。在 Dynamo 0.4 上运行 TensorRT-LLM 的最新结果显示,性能表现十分出色:对于较长的输入序列,其在 NVIDIA B200 Blackwell GPU 上运行 OpenAI GPT-OSS 120B 模型时,交互速度最高提升达 4 倍,且不牺牲吞吐量;而在 NVIDIA GB200 NVL72 上运行 DeepSeek-R1 671B 模型时,每 GPU 的吞吐量提升了 2.5 倍,同时推理成本未增加。

开源模型和数据集

框架只是故事的一半,开发者还需要开放的模型和数据集来支持大规模实验、微调与部署。为此,NVIDIA 正在不断扩充其开放模型和数据集库,以完善开源工具生态。

在 Hugging Face 上,NVIDIA 发布了数百个模型和数据集,涵盖语言、视觉、多模态以及机器人等领域,其中包括:

- NVIDIA Nemotron 系列,专为代理式 AI 打造的完全开放模型,提供卓越的推理准确性和性能效率

- 适用于物理 AI 的基础模型与推理模型,例如 NVIDIA Cosmos

这些模型采用了 NVIDIA 开源模型许可等宽松型授权方式,旨在促进广泛应用与创新。从学术研究到云服务,NVIDIA 的开源项目和模型已被集成到数百万开发者的 workflow 中,显著扩大了 Blackwell GPU 的影响力。

NVIDIA Nemotron 是一个推理能力强大的大语言模型(LLM)系列,专为实现高准确性和卓越性能而设计。该系列开放模型采用高效推理与微调友好的架构,结合模型剪枝和混合架构等先进技术,吞吐量可达当前第二佳开放模型的 6 倍。通过知识蒸馏、监督微调(SFT)和强化学习等方法,这些模型利用 NVIDIA 构建并精心策划的高质量开放训练数据集进行优化,在推理和代理任务中均表现出卓越的准确性。Nemotron 模型以 NIM 推理微服务的形式封装,可轻松部署于从桌面到数据中心的各类 GPU 加速系统,帮助企业便捷地尝试多步推理能力,并针对自定义应用场景进行高效微调。

NVIDIA 还发布了 多模态模型,例如 Isaac GR00T N1.5—一款开放且可定制的视觉语言动作(VLA)模型,专为人形机器人设计,能够实现机器人的推理与环境理解——以及 嵌入模型、标记器 等。其中许多模型已针对 NVFP4 进行了预量化处理,且所有模型均附带相应的许可证。

但 AI 不仅限于文本或图像,开发者还希望实现对物理世界的模拟、推理与交互。NVIDIA 正在推动物理 AI 的发展,这一技术能够感知物理世界并与其互动,广泛应用于机器人、自动驾驶汽车和智能基础设施等领域。NVIDIA Cosmos 是实现这一愿景的关键组成部分,它是一套用于生成和理解世界的生成式模型与工具,可加速物理 AI 模型的开发。Cosmos 包含三大核心模型:预测、迁移与推理,同时还提供标记器和数据处理流程。所有组件均基于开放模型许可发布,供开发者自由下载和定制。

这些仿真与推理框架通过 NVIDIA Omniverse SDK 及相关库得到进一步增强,这些工具利用开源的通用场景描述(OpenUSD)实现数据聚合与场景组装。NVIDIA 贡献了实时 RTX 渲染扩展和物理架构,使开发者能够构建面向工业和机器人仿真应用的物理 AI 应用。上述技术共同构建了一个完整的“仿真到现实”工作流程,用于训练可在真实世界环境中运行的 AI 系统。

从加速原始数据处理的 RAPIDS,到开放模型如 Cosmos 和 Nemotron,NVIDIA 的开放生态系统覆盖了完整的 AI 生命周期。通过在每个阶段集成开源工具、模型与框架,开发者能够在不脱离开源生态的前提下,基于 Blackwell 硬件实现从原型开发到生产的无缝过渡。

开始使用 NVIDIA 开源 AI 生态系统

NVIDIA AI 软件堆栈已为全球数百万开发者的实际工作流提供支持,覆盖从学术研究实验室到财富 500 强企业的广泛场景,助力团队充分释放 Blackwell 等尖端 GPU 的性能潜力。NVIDIA 将 NVFP4 精度、第二代 Transformer 引擎和 NVLink Fusion 等突破性硬件创新,与无与伦比的开源框架、预训练模型及优化库深度融合,确保 AI 技术从原型设计到生产部署的无缝扩展。

最棒的是什么?您现在就能亲身体验。探索 GitHub 上的开源项目,访问 Hugging Face 上的数百个模型与数据集,或深入浏览 NVIDIA 开源项目目录。无论您是在构建大语言模型、生成式 AI、机器人,还是优化工作流程,这个开放的生态系统都已准备就绪,助您实现下一个重大突破。

NVIDIA 是开源社区的积极贡献者,深度参与了 Linux 内核、Python、PyTorch、Kubernetes、JAX 和 ROS 等多个重要项目的开发与维护。同时,NVIDIA 通过支持 Linux 基金会、PyTorch 基金会、Python 软件基金会、云原生计算基金会、开源机器人联盟 以及 OpenUSD 联盟 等组织,持续推动开源生态的发展。除了对大型基金会的支持,NVIDIA 还通过其免费和开源软件(FOSS)基金等项目,积极投资于小型开源社区。众多 NVIDIA 工程师在领先的开源生态系统中担任核心开发者和维护者,致力于维护支撑全球 AI 创新的关键项目。