Intermediate Technical

2024年 4月 26日

使用张量并行技术进行自动驾驶感知模型训练

由于采用了多摄像头输入和深度卷积骨干网络,用于训练自动驾驶感知模型的 GPU 内存占用很大。

3 MIN READ

2024年 4月 23日

借助 Union.ai 和 NVIDIA DGX 云实现 AI 工作流程的大众化

GPU 最初专用于在电子游戏中渲染 3D 图形,主要用于加速线性代数计算。如今,GPU 已成为 AI 革命的关键组成部分之一。 现在,

2 MIN READ

2024年 4月 22日

借助 NVIDIA Aerial CUDA 加速 RAN,增强 5G/6G 的 DU 性能和工作负载整合

Aerial CUDA 加速无线电接入网 (RAN) 可加速电信工作负载,使用 CPU、

5 MIN READ

2024年 4月 22日

Mistral Large 和 Mixtral 8x22B LLM 现已由 NVIDIA NIM 和 NVIDIA API 提供支持

本周发布的模型包括两个新的 NVIDIA AI 基础模型:Mistral Large 和 Mixtral 8x22B。

1 MIN READ

2024年 4月 22日

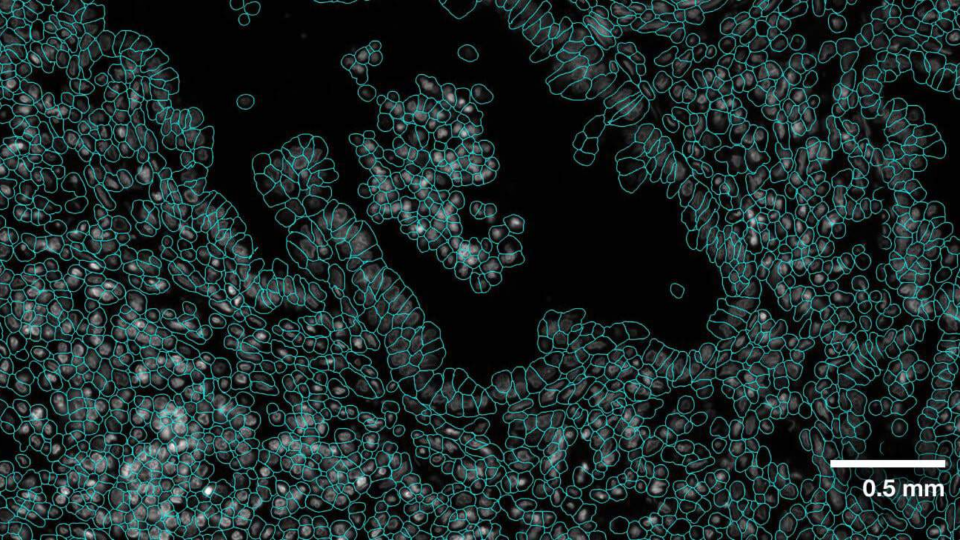

借助 NVIDIA AI 基础模型 VISTA-2D 推进细胞分割和形态分析

基因组学研究人员使用不同的测序技术来更好地理解生物系统,包括单细胞和空间组学。与从细胞层面查看数据的单细胞不同,空间组学考虑了数据的位置,

2 MIN READ

2024年 4月 19日

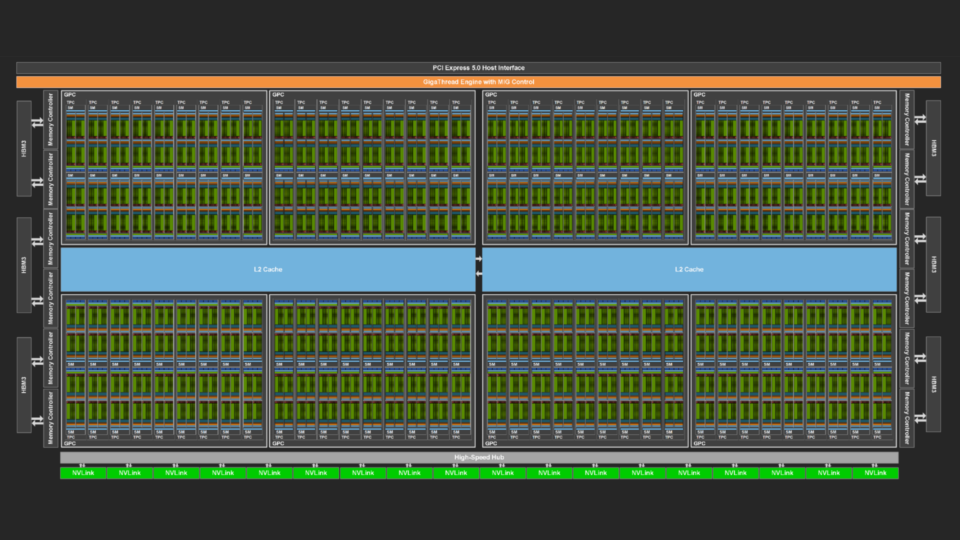

测量多流工作负载的 GPU 占用率

随着新一代产品的推出, NVIDIA GPU 的性能也变得越来越强大。这种提升通常有两种形式。每个流多处理器 (SM) (GPU 的主力)…

3 MIN READ

2024年 4月 18日

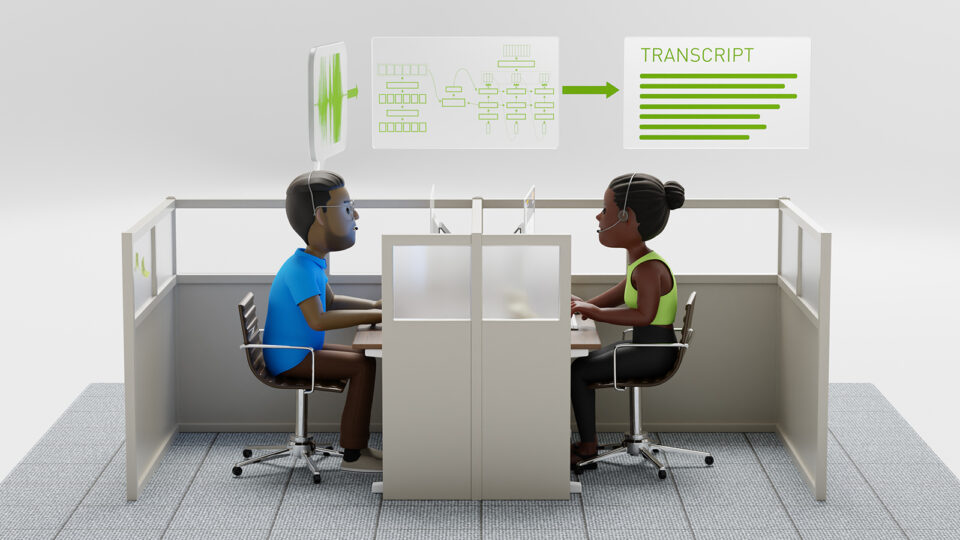

借助 NVIDIA NeMo Parakeet ASR 模型突破语音识别的界限

NVIDIA NeMo Parakeet 是一个端到端平台,用于在任何地方(任何云端和本地)大规模开发多模态生成式 AI 模型,

2 MIN READ

2024年 4月 3日

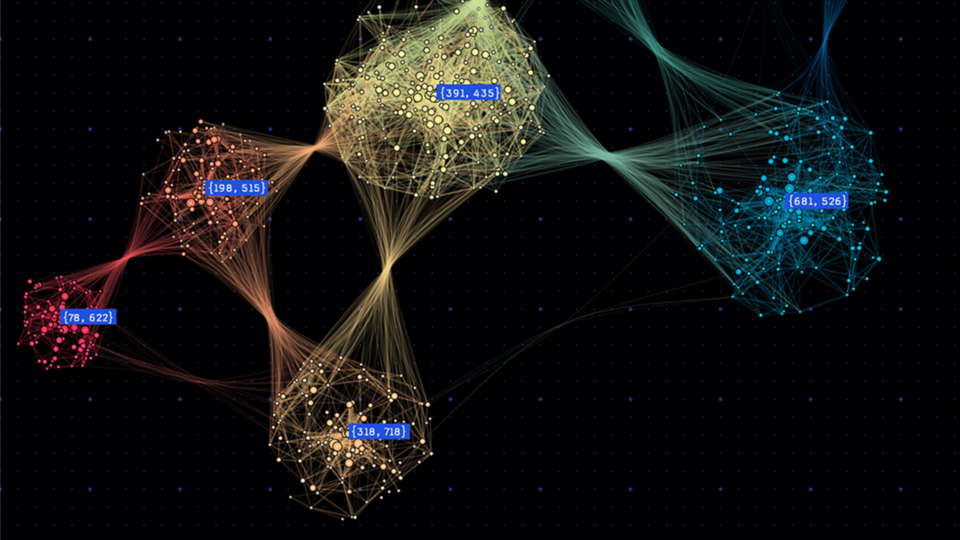

使用 WholeGraph 优化图形神经网络的内存和检索,第 2 部分

大规模图形神经网络 (GNN) 训练带来了艰巨的挑战,特别是在图形数据的规模和复杂性方面。这些挑战不仅涉及神经网络的正向和反向计算的典型问题,

2 MIN READ

2024年 4月 2日

使用 NVIDIA TensorRT-LLM 调整和部署 LoRA LLM

大型语言模型 (LLM) 可以从大量文本中学习,并为各种任务和领域生成流畅、一致的文本,从而彻底改变自然语言处理 (NLP)。然而,

7 MIN READ

2024年 3月 27日

借助 NVIDIA NeMo 定制器轻松微调和对齐 LLM

随着 大型语言模型(LLM) 在企业 AI 应用中获得更多吸引力,定制化模型 理解和集成特定行业术语、

1 MIN READ

2024年 3月 27日

高效的 CUDA 调试:将 NVIDIA Compute Sanitizer 与 NVIDIA 工具扩展程序结合使用并创建自定义工具

NVIDIA Compute Sanitizer 是一款功能强大的工具,可以节省时间和精力,同时提高 CUDA 应用程序的可靠性和性能。

5 MIN READ

2024年 3月 21日

重新思考如何训练 Diffusion 模型

在探索了扩散模型采样、参数化和训练的基础知识之后,我们的团队开始研究这些网络架构的内部结构。请参考 生成式 AI 研究聚焦:

2 MIN READ

2024年 3月 20日

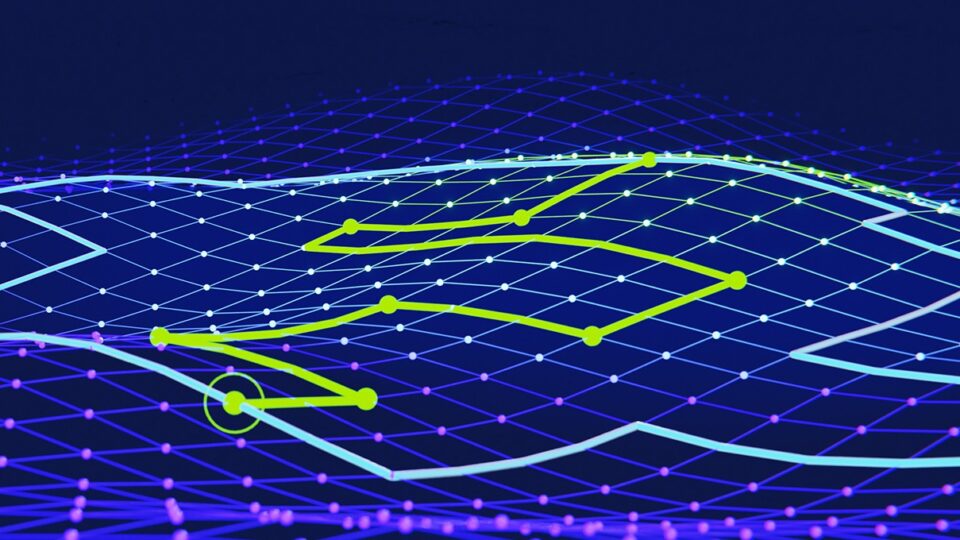

突破性的 NVIDIA cuOpt 算法将路线优化解决方案的速度提高 100 倍

NVIDIA cuOpt 是一个加速优化引擎,专为解决复杂的路线规划问题而设计。它能够高效地处理各种问题,包括但不限于:休息和等待时间、

2 MIN READ

2024年 3月 20日

使用 NVIDIA Holoscan 1.0 开发生产就绪型 AI 传感器处理应用

边缘 AI 开发者正在为安全关键型和受监管用例构建 AI 应用和产品。借助 NVIDIA Holoscan 1.0,

2 MIN READ

2024年 3月 20日

借助 NVIDIA AI Enterprise IGX 为任务关键型边缘 AI 提供支持

NVIDIA SDK 在加速智慧城市、医疗和机器人等一系列用例中的 AI 应用方面发挥了重要作用。但是,

1 MIN READ

2024年 3月 19日

NVIDIA 语音和翻译 AI 模型在速度和准确性方面创下记录

NVIDIA 开发的语音和翻译 AI 模型正在推动性能和创新的发展。NVIDIA Parakeet 自动语音识别 (ASR) 模型系列以及…

2 MIN READ