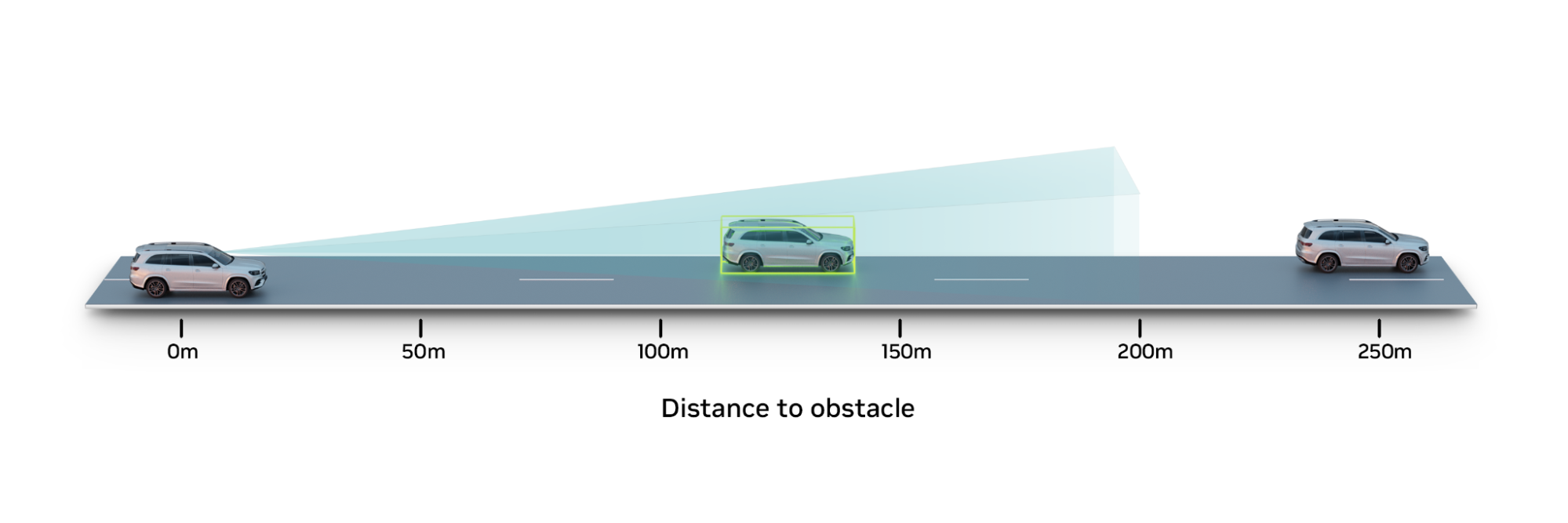

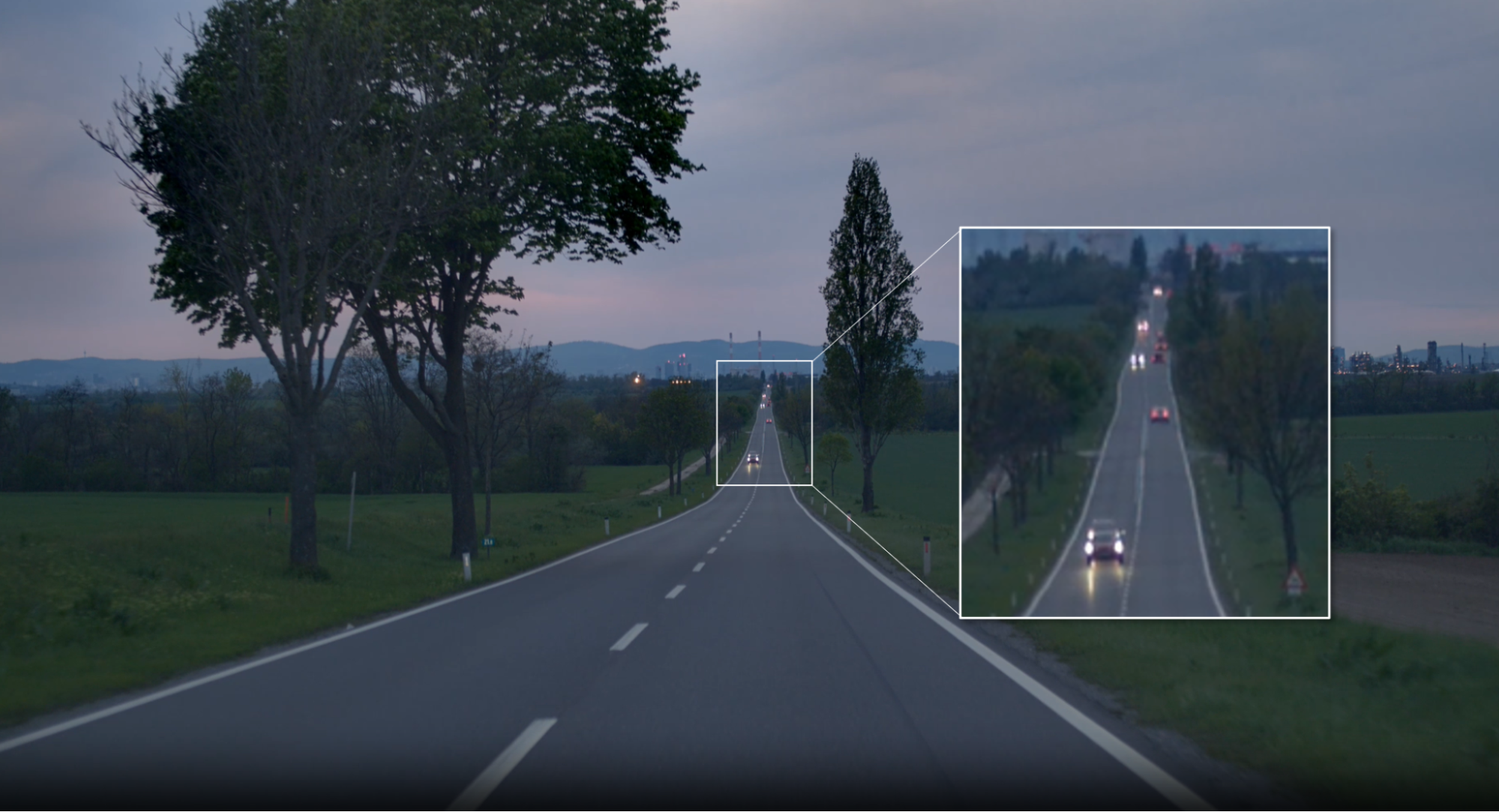

检测远场物体,如 100 米以外的车辆,是自动驾驶系统在高速公路上安全操作的基础

在这样的高速环境中,每一秒都很重要。因此,如果在以 70 英里/小时的速度行驶时,自动驾驶汽车( AV )的感知范围可以从 100 米增加到 200 米,那么车辆有更多的时间做出反应。

然而,对于通常部署在量产乘用车中的基于摄像头的感知系统来说,扩展这一范围尤其具有挑战性。训练用于远场物体检测的相机感知系统需要收集大量的相机数据以及地面实况( GT )标签,例如 3D 边界框和距离。

对于超过 200 米的物体来说,提取这些 GT 数据变得更加困难。物体离得越远,在图像中就越小,最终只有几个像素宽。通常,像激光雷达这样的传感器与聚合和自动标记技术一起使用来提取 3D 和距离信息,但这些数据在激光雷达的工作范围之外变得稀疏和嘈杂。

这个NVIDIA DRIVEAV 团队需要在开发过程中解决这一确切的挑战。为此,我们在NVIDIA DRIVE Sim,利用NVIDIA Omniverse Replicator.

NVIDIA DRIVE Sim 是一款基于 Omniverse 的 AV 模拟器,包括经过高保真度传感器模拟验证的基于物理的传感器模型。有关更多详细信息,请参阅Validating NVIDIA DRIVE Sim Camera Models.

NVIDIA DRIVE Sim 能够以像素级的精度查询模拟场景中每个物体的位置,包括以任何相机分辨率放置在距离自我车辆 400 米或 500 米处的物体

当车辆位置信息与基于物理的合成相机数据相结合时,可以生成用于感知的必要的 3D 和距离 GT 标签

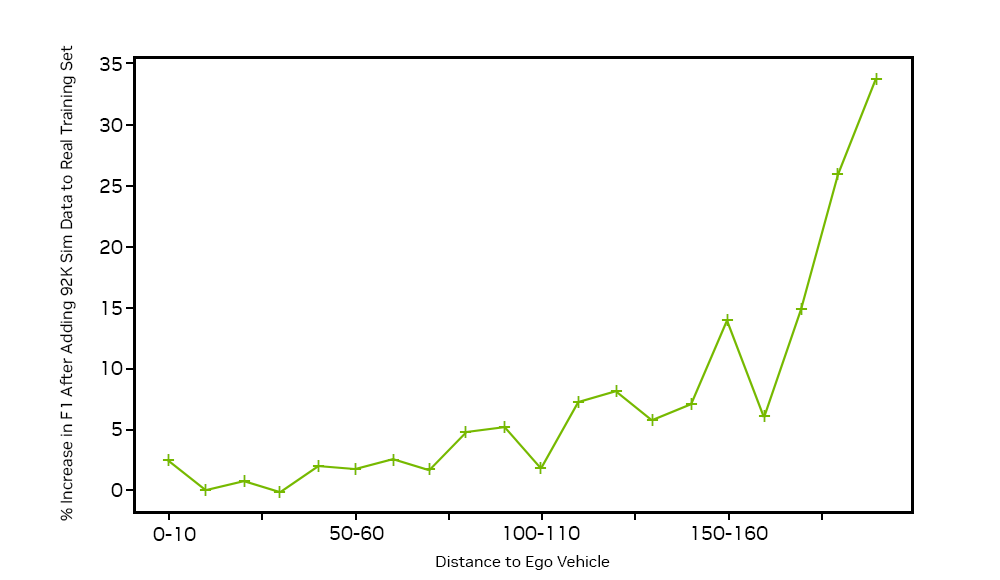

通过将这些合成 GT 数据添加到我们现有的真实数据集中,我们能够训练网络来检测远距离的汽车,并在 190 米至 200 米的距离内实现 33% 的 F1 成绩提高。

用于远场物体的合成 GT 数据生成

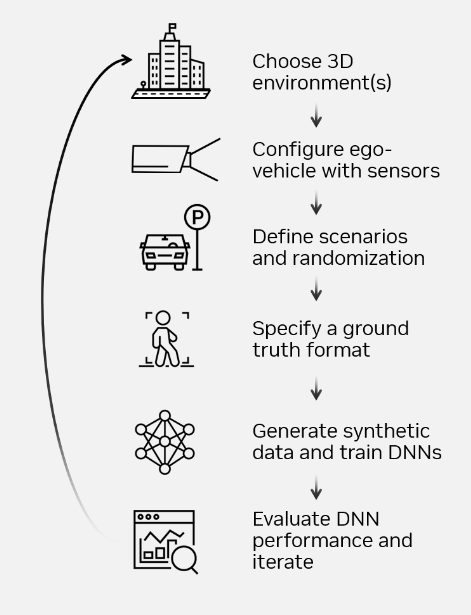

为了解决精确标记的远场数据的稀缺性,我们的目标是生成一个由近 100 K 长距离物体图像组成的合成数据集,以增强现有的真实数据集。图 3 显示了使用 Omniverse Replicator 在 NVIDIA DRIVE Sim 中生成这些数据集的过程,从选择 3D 环境到评估深度神经网络( DNN )性能。

在选择了解决高速公路用例的 3D 环境后,我们配置了一辆配备必要摄像头传感器的 ego 车辆。

NVIDIA DRIVE Sim 利用基于 Omniverse Replicator 框架构建的域随机化 API ,以编程方式更改 3D 资产的外观、位置和运动。通过使用ASAM OpenDRIVE绘制 API 地图时,我们将车辆和障碍物放置在 100 米至 350 米的远场距离处,并以上下文方式放置在远处。

NVIDIA DRIVE Sim 动作系统能够模拟各种引入闭塞的具有挑战性的情况,如车道变更或近距离切入。这为现实世界中难以遇到的场景提供了关键数据

在数据生成之前的最后一步,我们利用 Omniverse Replicator 中的 GT 编写器生成必要的 标签,包括三维边界框、速度、语义标签和对象 ID 。

利用合成相机数据提高相机感知性能

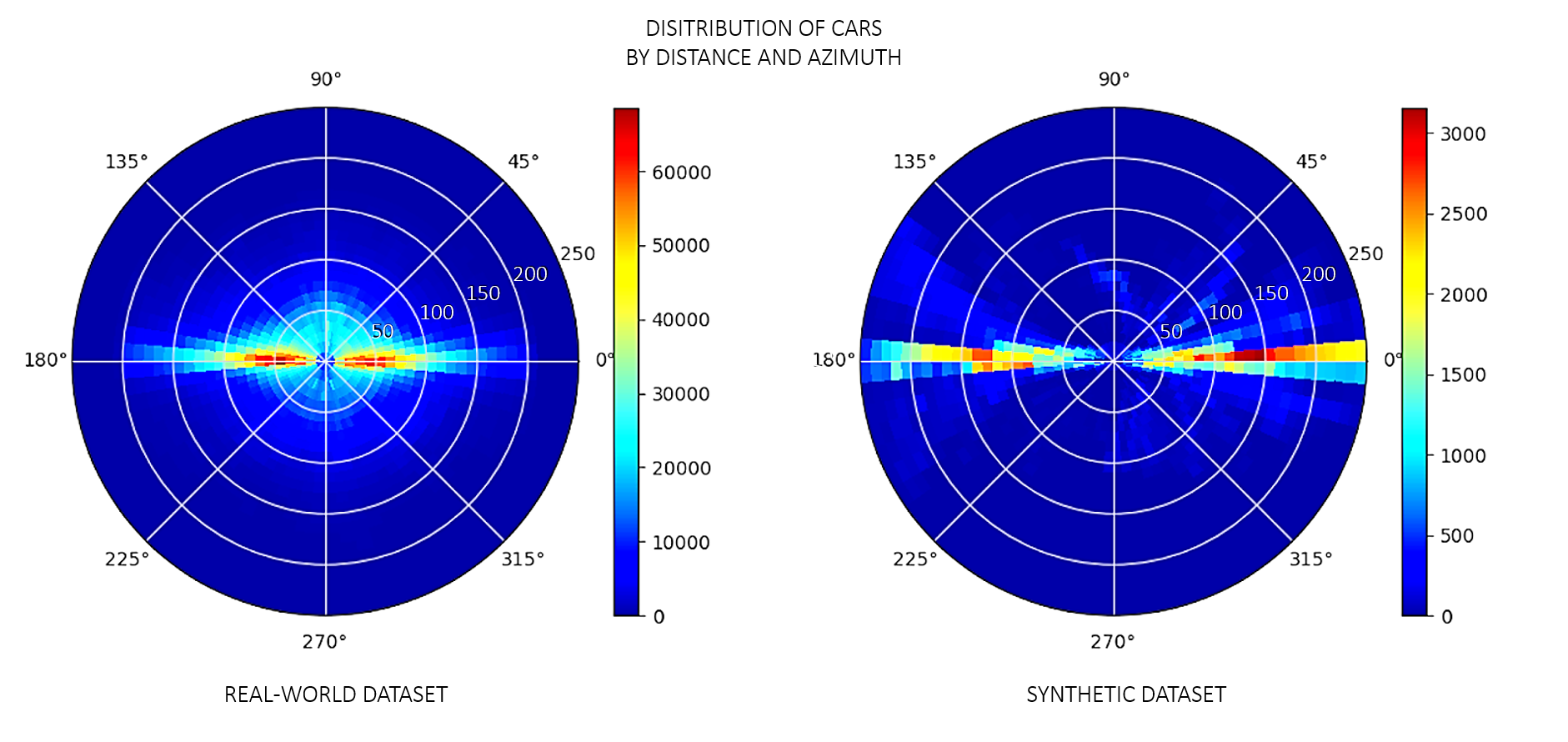

对于该用例,真实训练数据集由 100 多万张图像组成,其中包含 200 米以下高速公路场景中车辆的 GT 标签。如图 4 左侧所示,这些真实图像中的汽车分布在距离数据采集车辆不到 100 米的地方达到峰值。对于距离更远的物体, GT 标签稀疏,不足以增强感知。

在这种情况下,我们生成了约 92 K 的合成图像,其中约 371 K 个汽车实例和 GT 标签集中在高达 350 米的远程车辆分布上。合成数据集中的汽车分布更倾向于 150 米及更远的距离。通过将~ 92K 的合成图像添加到该真实数据集中,我们将所需的标记远场对象引入到训练分布中

在组合数据集上训练感知算法后,我们将网络与汽车分布高达 200 米的真实数据集进行了测试。通过距离提高感知性能的 KPI 显示 F1 分数提高了 33% ,这是对 190 米至 200 米汽车数据集上模型准确性的衡量

总结

合成数据正在推动 AV 开发的重大范式转变,解锁以前不可能的新用例。使用 NVIDIA DRIVE Sim 和 NVIDIA Omniverse Replicator ,您可以在虚拟试验场中制作新传感器的原型,评估新的地面实况类型和 AV 感知算法,并模拟罕见和不良事件,所有这些都只需现实世界所需时间和成本的一小部分。

合成数据集为 AV 感知提供的丰富可能性不断发展。要查看我们的工作流程并了解更多信息,请观看 NVIDIA GTC DRIVE 开发者日会议,How to Generate Synthetic Data with NVIDIA DRIVE Replicator.