생성형 AI는 모든 산업을 혁신할 수 있는 잠재력을 가지고 있습니다. 인간 작업자들은 이미 거대 언어 모델 (LLM)을 사용하여 어려운 인지 작업을 설명하고, 추론하고, 해결하고 있습니다. 검색 증강 생성 (RAG)은 LLM을 데이터에 연결하여 최신의 정확한 정보에 액세스할 수 있게 함으로써 LLM의 활용도를 넓혀줍니다.

이미 많은 기업에서 RAG를 통해 비즈니스 프로세스를 자동화하고 데이터를 채굴하여 인사이트를 얻는 방법을 모색하기 시작했습니다. 대부분의 기업이 생성형 AI 사용 사례에 맞춰 여러 파일럿을 구축했지만, 그 중 90%는 가까운 시일 내에 평가 단계를 넘어서지 못할 것으로 예상됩니다. 뛰어난 RAG 파일럿을 실제 비즈니스 가치를 제공하는 프로덕션 서비스로 전환하는 것은 여전히 어려운 과제입니다.

이 블로그에서는 NVIDIA AI가 RAG 애플리케이션을 파일럿에서 프로덕션으로 전환하는 4가지 단계를 어떻게 지원하는지 설명합니다.

엔터프라이즈급 RAG 파이프라인 구축

프로덕션 지원 엔터프라이즈 RAG 파이프라인을 개발 및 배포하는 데는 많은 장애물이 있습니다.

IT 관리자는 LLM 보안, 사용성, 휴대성 및 데이터 거버넌스와 관련된 문제에 직면합니다. 엔터프라이즈 개발자는 LLM 정확성과 LLM 프로그래밍 프레임워크의 전반적인 성숙도에 어려움을 겪을 수 있습니다. 또한 오픈 소스 혁신의 엄청난 속도는 매일 새로운 LLM 모델과 RAG 기술이 등장하면서 모든 사람을 압도하고 있습니다.

프로덕션 RAG 개발 및 배포를 간소화하는 기본 요소

NVIDIA는 클라우드 네이티브 엔드투엔드 RAG 애플리케이션을 위한 레퍼런스 아키텍처를 제공하여 이러한 복잡성을 관리할 수 있도록 지원합니다. 이 레퍼런스 아키텍처는 인기 있는 오픈 소스 소프트웨어와 NVIDIA 가속화를 결합한 모듈식 아키텍처입니다. 포괄적인 모듈식 빌딩 블록 제품군을 활용하면 몇 가지 이점이 있습니다.

- 첫째, 기업은 새로운 구성 요소를 기존 인프라에 선택적으로 통합할 수 있습니다.

- 둘째, 파이프라인의 각 단계에서 상용 및 오픈 소스 구성 요소 중에서 선택할 수 있습니다. 기업은 각자의 사용 사례에 적합한 구성 요소를 자유롭게 선택하면서 동시에 공급업체 의존성을 피할 수 있습니다.

- 마지막으로, 모듈식 아키텍처는 파이프라인의 각 단계에서 평가, 관찰, 문제 해결 작업을 간소화합니다.

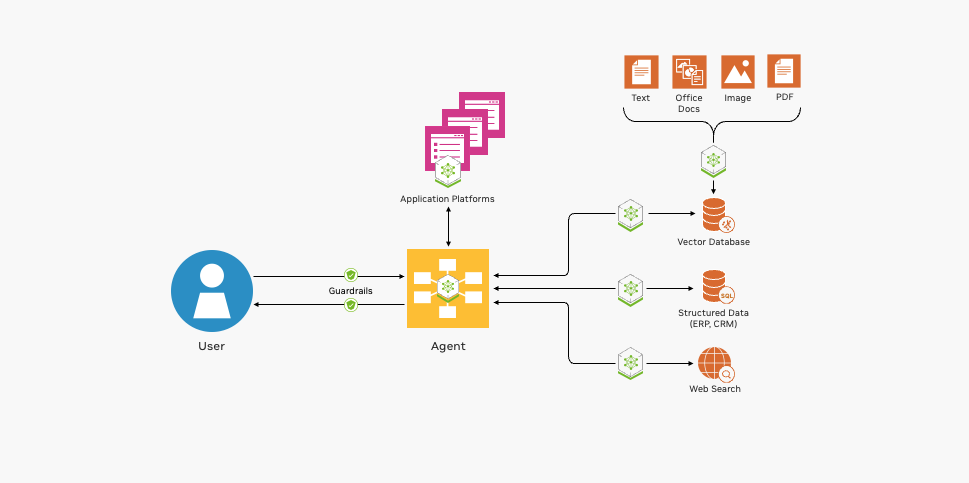

그림 1은 RAG 파이프라인을 배포하기 위한 필수 구성 요소를 보여줍니다.

NVIDIA는 RAG 애플리케이션 개발에 도움이 되는 오픈 소스 통합, GPU 가속 컨테이너 등을 제공합니다.

인기 있는 프레임워크 및 도구와의 오픈 소스 통합

NVIDIA는 RAG 애플리케이션 개발을 시작하는 데 도움이 되는 예제 파이프라인을 제공합니다. NVIDIA RAG 파이프라인 예제는 개발자에게 LangChain, LlamaIndex, Haystack 등 인기 있는 오픈 소스 LLM 프로그래밍 프레임워크와 NVIDIA 가속화된 소프트웨어를 결합하는 방법을 소개합니다. 이러한 예시를 출발점으로 삼아 엔터프라이즈 개발자는 오픈 소스 혁신과 가속화된 성능 및 확장성이라는 두 가지 장점을 모두 누릴 수 있습니다.

또한 이 예시에서는 평가, 파이프라인 가시성 및 데이터 수집을 위한 인기 있는 오픈 소스 도구와의 통합을 보여줌으로써 2일차 파이프라인 운영을 보다 쉽고 비용 효율적으로 수행할 수 있습니다.

빠르고 정확한 응답을 위한 GPU 가속 컨테이너

LLM 기반 엔터프라이즈 RAG 애플리케이션은 응답 속도가 빠르고 정확해야 합니다. CPU 기반 시스템은 엔터프라이즈 규모에서 만족할 만한 성능을 제공할 수 없습니다. NVIDIA API 카탈로그에는 GPU 가속화의 이점을 누릴 수 있는 RAG 파이프라인의 모든 단계를 지원하는 컨테이너가 포함되어 있습니다.

- NVIDIA NIM은 LLM 추론을 위한 업계 최고의 성능과 규모를 제공합니다.

- NVIDIA NeMo Retriever는 RAG 파이프라인의 핵심인 문서 임베딩, 검색 및 쿼리 기능을 간소화하고 가속화합니다.

- NVIDIA RAPIDS는 엔터프라이즈 데이터의 벡터 표현을 저장하는 데이터베이스의 검색 및 인덱싱을 가속화합니다.

멀티모달 입력, 출력 및 데이터 처리 지원

RAG 애플리케이션은 텍스트 기반 챗봇에서 이미지, 오디오, 비디오 등 다양한 모달리티를 포함하는 복잡한 이벤트 중심 워크플로우로 빠르게 진화하고 있습니다. NVIDIA AI 소프트웨어는 이러한 새로운 사용 사례를 해결하기 위해 RAG 파이프라인의 사용성과 기능을 향상시킵니다.

- NVIDIA Riva는 음성 언어를 사용하여 RAG 파이프라인과 상호 작용할 수 있도록 GPU 가속 텍스트 음성 변환, 음성 텍스트 변환 및 번역 인터페이스를 제공합니다.

- NVIDIA RAPIDS는 LLM 에이전트에 의해 트리거된 작업을 GPU 가속할 수 있습니다. 예를 들어, LLM 에이전트는 구조화된 데이터에 대한 통계 수학을 수행하기 위해 RAPIDS cuDF를 호출할 수 있습니다.

- NVIDIA Morpheus는 방대한 양의 엔터프라이즈 데이터를 전처리하고 실시간으로 수집하는 데 사용할 수 있습니다.

- NVIDIA Metropolis와 NVIDIA Holoscan은 RAG 파이프라인에 비디오 및 센서 처리 기능을 추가합니다.

엔터프라이즈 개발자는 이러한 AI 소프트웨어 구성 요소를 프로덕션에 배포하기 위해 NVIDIA AI Enterprise를 활용할 수 있습니다. NVIDIA AI Enterprise는 엔터프라이즈급 생성형 AI 애플리케이션을 위한 가장 빠르고 효율적인 런타임을 제공합니다.

RAG 앱을 파일럿에서 프로덕션으로 전환하는 4단계

프로덕션 RAG 애플리케이션을 구축하려면 많은 이해관계자 간의 협력이 필요합니다.

- 데이터 사이언티스트는 LLM의 성능과 정확성을 평가합니다.

- 엔터프라이즈 AI 개발자는 RAG 애플리케이션을 작성, 테스트 및 개선합니다.

- 데이터 엔지니어는 인덱싱 및 검색을 위해 엔터프라이즈 데이터를 연결하고 변환합니다.

- MLOps, DevOps 및 SRE(사이트 안정성 엔지니어)는 프로덕션 시스템을 배포하고 유지 관리합니다.

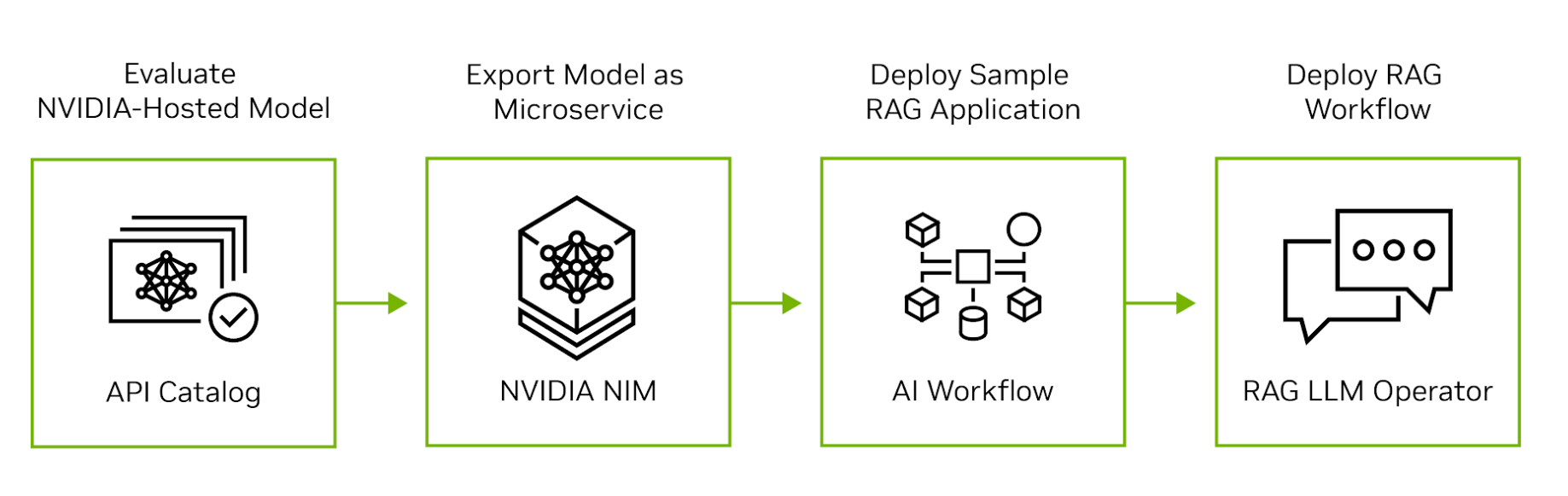

NVIDIA AI는 클라우드에서 실리콘으로 확장되어 RAG 애플리케이션 개발, 배포 및 운영의 모든 단계를 지원합니다. 그림 2는 RAG 애플리케이션을 평가 단계에서 프로덕션 단계로 전환하는 4단계를 보여줍니다.

1단계. NVIDIA API 카탈로그에서 LLM 평가하기

NVIDIA GPU에서 실행되는 주요 오픈 소스 및 상용 모델을 경험하려면 먼저 NVIDIA API 카탈로그를 방문하세요. 개발자는 사용자 인터페이스를 통해 모델과 상호 작용하고 이렇게 생성된 백엔드 API 호출을 볼 수 있습니다. API 호출은 Python, Go 또는 TypeScript 코드 스니펫 또는 셸 스크립트로 내보낼 수 있습니다.

2단계. 모델을 마이크로서비스로 내보내기

다음으로 모델을 NVIDIA NIM으로 내보냅니다. NIM은 생성형 AI의 배포를 가속화하도록 설계된 사용하기 쉬운 자체 호스팅 마이크로서비스입니다. 마이크로서비스는 모든 주요 클라우드의 버추얼 머신에서 컨테이너로 실행하거나 Helm을 통해 Kubernetes 클러스터에 설치할 수 있습니다. 데이터 프라이버시 또는 보안에 대한 우려가 있는 경우 자체 데이터 센터 또는 버추얼 프라이빗 클라우드에서 모델을 평가할 수 있습니다.

3단계. 샘플 RAG 애플리케이션 개발

자체 호스팅 모델을 평가한 후, NVIDIA 생성형 AI 예제를 살펴보고 샘플 RAG 애플리케이션을 작성하세요. 이 예제에서는 NVIDIA 마이크로서비스가 인기 있는 오픈 소스 LLM 프로그래밍 프레임워크와 통합되어 엔드투엔드 RAG 파이프라인을 생성하는 방법을 설명합니다. 데이터 사이언티스트는 이러한 예제를 사용하여 애플리케이션의 성능을 조정하고 정확도를 평가할 수 있습니다. 또한 NVIDIA AI 엔터프라이즈 고객은 생성형 AI 예제를 산업별 사용 사례에 어떻게 적용할 수 있는지 보여주는 NVIDIA AI 워크플로우에 액세스할 수 있습니다.

4단계. RAG 파이프라인을 프로덕션에 배포

애플리케이션이 개발된 후, MLOps 관리자는 NVIDIA RAG LLM 오퍼레이터를 사용하여 테스트 또는 프로덕션 네임스페이스에 애플리케이션을 배포할 수 있습니다. 현재 얼리 액세스로 제공되는 RAG LLM 오퍼레이터를 사용하면 애플리케이션 코드를 다시 작성하지 않고도 RAG 애플리케이션을 Kubernetes 클러스터에 빠르고 쉽게 배포할 수 있습니다.

RAG LLM 운영자는 Kubernetes에서 NVIDIA GPU의 배포와 관리를 자동화하는 인기 있는 인프라 소프트웨어인 NVIDIA GPU Operator 위에서 실행됩니다. 수명 주기 관리의 복잡성을 줄이고 RAG 파이프라인의 원활한 배포, 확장 및 관리를 가능하게 합니다.

생산성을 향상시키는 프로덕션 RAG 파이프라인

프로덕션 RAG 시스템은 수고를 줄이고, 관련 데이터를 더 쉽게 찾고, 이벤트를 자동화하여 작업자의 생산성을 높일 수 있습니다.

NVIDIA는 RAG 파이프라인을 사용하여 안전한 엔터프라이즈 소프트웨어 구축을 지원합니다. NVIDIA CVE 분석 도구는 NVIDIA NIM, NeMo Retriever, Morpheus 사이버 보안 AI 프레임워크를 결합하여 NGC 컨테이너에서 일반적인 취약성 및 노출(CVE)을 식별하고 분류합니다. NGC 컨테이너 레지스트리에 게시된 모든 컨테이너의 무결성을 보장하는 이 중요한 비즈니스 프로세스는 이제 며칠이 아닌 몇 시간 만에 완료됩니다.

Deepset, Sandia 국립 연구소, Infosys, Quantiphi, Slalom, Wipro 등 다양한 조직에서 엔터프라이즈 데이터의 시맨틱 검색을 지원하는 NVIDIA 생성형 AI를 통해 귀중한 인사이트를 확보하고 있습니다.

Haystack의 새로운 Haystack2.0과 NVIDIA NIM 및 NeMo Retriever의 통합은 조직이 GPU 가속 LLM을 효율적으로 검사하여 RAG 애플리케이션의 신속한 프로토타이핑을 지원하도록 돕습니다.

Sandia 국립 연구소와 NVIDIA는 정확도와 성능을 향상시키면서 데이터 인사이트를 극대화하기 위해 새로운 생성형 AI 툴을 평가하기 위해 협력하고 있습니다.

Infosys는 다양한 산업 분야에서 엔터프라이즈급 RAG 애플리케이션을 개발하기 위해 Infosys Topaz의 일부인 Infosys 생성형 AI와 NVIDIA NeMo를 결합하여 전략적 협력을 확대했습니다. 이러한 애플리케이션은 바이오제약 임상시험 보고서 자동화부터 100,000개 이상의 독점 재무 문서에서 인사이트를 찾는 것까지 다양한 사용 사례에 대한 표준을 파괴하고 가치를 제공합니다.

Quantiphi는 NVIDIA 가속화된 생성형 AI를 통합하여 방대한 신약 개발 문서 저장소에서 인사이트를 추출하고 인구 통계 및 지리적 위치에 맞춘 소매 공급망을 최적화하여 획기적인 결과를 제공할 수 있는 RAG 기반 솔루션을 개발합니다.

Slalom은 위험을 완화하고 책임감 있는 AI 적용을 보장하는 강력한 프레임워크를 통해 설계, 구현, 거버넌스 등 생성형 AI와 RAG의 복잡성을 탐색하는 조직을 지원하고 있습니다.

Wipro는 생성형 AI 도구를 사용하여 의료 기관이 미국 전역의 수백만 명의 환자에게 향상된 서비스 제공을 통해 치료 결과를 개선할 수 있도록 지원하고 있습니다.

시작하기

복잡한 비즈니스 과제를 해결하고 직원 생산성을 향상하기 위해 생성형 AI를 도입하는 기업이 점점 더 많아지고 있습니다. 또한 많은 기업이 생성형 AI를 자사 제품에 통합하고 있습니다. 기업은 NVIDIA AI Enterprise가 제공하는 보안, 지원 및 안정성을 바탕으로 RAG 애플리케이션을 파일럿에서 프로덕션으로 전환할 수 있습니다. 또한 NVIDIA AI를 표준화함으로써 기업은 빠르게 진화하는 LLM 에코시스템에 발맞출 수 있는 헌신적인 파트너를 확보할 수 있습니다.

최신 정보를 사용하여 도메인별 질문에 자연어로 정확하게 답변할 수 있는 챗봇 구축을 시작하려면 NVIDIA 생성형 AI 사례를 살펴보세요.

RAG 애플리케이션 구축을 위한 최신 혁신과 모범 사례에 대해 알아보려면 3월 18일부터 21일까지 열리는 NVIDIA GTC 2024의 검색 증강 생성 세션에서 확인해 보세요. RAG 개발자 데이에 참여하여 휴먼 음성 인터페이스를 갖춘 RAG 기반 애플리케이션을 구축하는 방법을 알아보세요.

관련 리소스

- GTC 세션: RAG 파이프라인의 대규모 프로덕션 배포

- GTC 세션: 생성형 AI 극장: RAG로 소프트웨어 제공 속도 향상

- GTC 세션: Snowflake Cortex로 RAG에서 Rich 앱까지(Snowflake 제공)

- NGC 컨테이너: 체인 서버

- SDK: MONAI 배포 워크플로우 관리자

- 웨비나: RAG를 사용하여 지능형 AI 챗봇 구축하기