Telecommunications

2025 年 5 月 30 日

5 大陸の通信事業者が、NVIDIA を活用したソブリン AI インフラを構築

大規模なインテリジェンスをもたらす新たなインフラである AI ファクトリーに対する大きなニーズは、通信企業にも新たなビジネス チャンスをもたらします。各国の事例をご覧ください。

3 MIN READ

2025 年 5 月 18 日

NVIDIA ARC-Compact を活用して、セル サイトに AI-RAN を展開

NVIDIA ARC-Compact があれば、高性能で電力効率に優れ、柔軟な AI-RAN ソリューションをあらゆるセル サイトで展開できます。

4 MIN READ

2024 年 11 月 12 日

AI-RAN が通信事業者向けに新しい AI のビジネス チャンスをもたらす

SoftBank が、NVIDIA アクセラレーション ハードウェアと NVIDIA Aerial ソフトウェアを技術基盤として活用し、神奈川県藤沢市で屋外フィールド トライアルを成功させ、AI-RAN ビジョンを現実のものにしました。

4 MIN READ

2024 年 10 月 9 日

先進的なソブリン AI モデルが、日本のイノベーションとチャンスを解き放つ

東京科学大学と産業技術総合研究所が、Llama 3.1 をベースに、日本特有の言語的/文化的ニーズによりよく応えるように設計された独自のソブリン AI モデル「Llama 3.1 Swallow」を共同開発しました。

2 MIN READ

2024 年 10 月 8 日

通信会社に AI-RAN を提供

NVIDIA は、同じコンピューティング インフラストラクチャを使用して AI サービスと無線アクセス ネットワーク (RAN) サービスの処理が可能な AI-RAN の展開プラットフォームである Aerial RAN Computer-1 を導入しています。

5 MIN READ

2024 年 6 月 7 日

NVIDIA NIM で LoRA アダプター群をシームレスにデプロイ

LoRA の概要と、LoRA でファインチューニングされたモデルをデプロイする 2 つの方法、また LoRA アダプター群のヘテロジニアスな LoRA デプロイを可能にして、混合バッチ推論リクエストを可能にするためのアプローチについても説明します。

3 MIN READ

2024 年 4 月 2 日

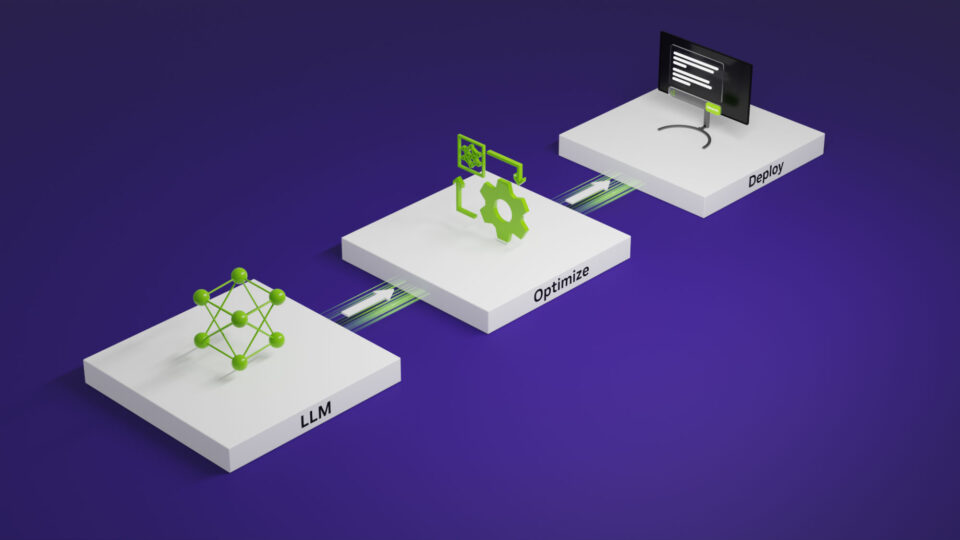

NVIDIA TensorRT-LLM による、LoRA LLM のチューニングとデプロイ

LLM のトレーニング コストを抑え、そのパワーを活用可能なファインチューニングの手法の 1 つである、Low-Rank Adaptation (LoRA) の洞察力と実装について説明し、その応用と利点の一部をご紹介します。

7 MIN READ

2024 年 3 月 20 日

記録を塗り替え続ける NVIDIA cuOpt アルゴリズムがルート最適化ソリューションを 100 倍高速化

最適化アルゴリズムの主要な要素、その定義、業界をリードするソリューションに対して NVIDIA cuOpt のベンチマークを実行するプロセスについて掘り下げ、その比較の重要性に焦点を当ててご紹介します。

3 MIN READ

2024 年 3 月 14 日

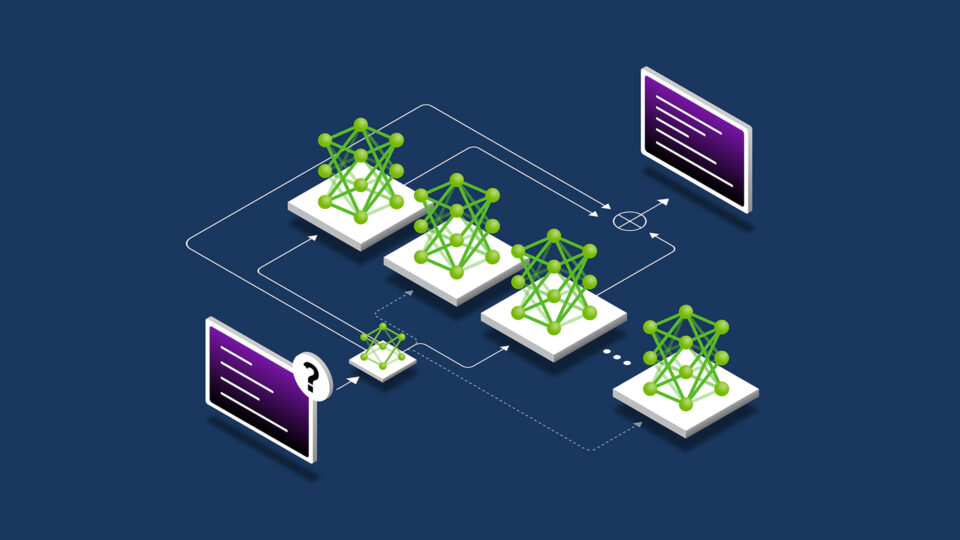

LLM アーキテクチャにおける Mixture of Experts の適用

Mixture of Experts (MoE) 大規模言語モデル (LLM) アーキテクチャは、GPT-4 などの商用の LLM と…

4 MIN READ

2023 年 11 月 17 日

LLM テクニックの習得: 推論の最適化

LLM 推論における最も差し迫った課題と、いくつかの実用的な解決策について説明します。

6 MIN READ

2023 年 11 月 16 日

LLM テクニックの習得: トレーニング

Transformer ネットワークを使用して構築された LLM の背後にある基本原則を、モデル アーキテクチャ、アテンション メカニズム、埋め込み手法、基盤モデルのトレーニング戦略にわたり説明します。

3 MIN READ

2023 年 11 月 7 日

企業ソリューション向け大規模言語モデル (LLM) を始める

大規模言語モデル (LLM: Large :Language Models) とは、数千億のパラメーターを持つインターネット規模のデータセットで学習されるディープラーニングのアルゴリズムです。

3 MIN READ

2023 年 10 月 2 日

ソフトウェアデファインドな、高性能で効率的な vRAN の構築には、プログラム可能なインラインによる高速化が必要

プログラム可能なインライン アクセラレーションが、高性能でエネルギー効率に優れ、高い拡張性でクラウドネイティブな vRAN を実現するための重要な基盤である理由をご説明します。

4 MIN READ

2023 年 9 月 12 日

実務で使える生成 AI を NVIDIA AI Enterprise 4.0 で実装しビジネスを強化

NVIDIA AI Enterprise 4.0 は、生成 AI でイノベーションを起こそうとしている企業向けに、本番環境に対応したサポート、管理性、セキュリティ、信頼性を提供し、さまざまな側面から開発を加速します。

1 MIN READ

2022 年 3 月 22 日

NVIDIA Sionna でリンクレベル シミュレーションを開始

世界中で 5G ワイヤレス ネットワークの導入と利用が進んでいますが、学術界や産業界の研究者の間では、

2 MIN READ