HPC /科学计算

2024年 2月 5日

使用新的 NVIDIA AI 基础模型生成代码、回答查询并翻译文本

本周的 Model Monday 版本包含 NVIDIA 优化的代码 Lama、Kosmos-2 和 SeamlessM4T,

4 MIN READ

2024年 2月 1日

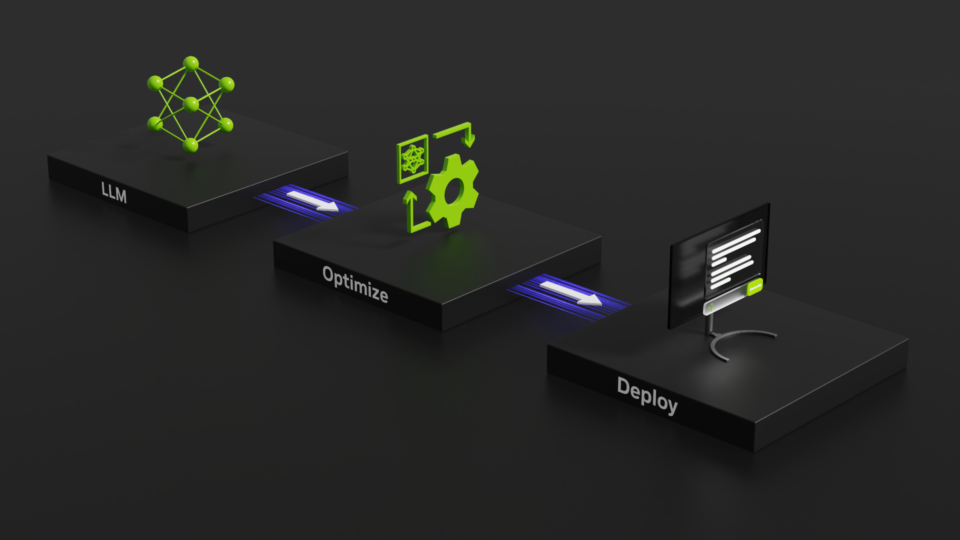

借助 NVIDIA TensorRT-LLM 和 NVIDIA Triton 部署 AI 编码助手

大型语言模型 (LLM) 的出现革新了人工智能领域,为与数字世界的交互提供了全新的方式。尽管 LLM 通常能够提供良好的通用解决方案,

4 MIN READ

2024年 1月 30日

借助加速网络实现数据中心现代化

加速网络将 CPU、GPU、DPU(数据处理单元)或 SuperNIC 组合成加速计算结构,专门设计用于优化网络工作负载。

1 MIN READ

2024年 1月 30日

使用现已推出 Beta 版的 NVIDIA AI Workbench 来创建、共享和扩展企业 AI 工作流程

NVIDIA AI Workbench 现已进入测试阶段,带来了丰富的新功能,可简化企业开发者创建、使用和共享 AI 和机器学习 (ML)…

3 MIN READ

2024年 1月 23日

借助 NVIDIA Quantum InfiniBand 简化 AI 网络运营

一个常见的技术误区是,性能和复杂性直接相关。也就是说,高性能的实现也是实现和管理最具挑战性的。但是,在考虑数据中心网络时,情况并非如此。

1 MIN READ

2024年 1月 22日

模型星期一:使用优化的 DePlot 模型查询图形

我们将在全年的每个星期一发布新模型。本周,我们发布了NVIDIA 优化的 DePlot 模型,您可以直接在浏览器中体验。

2 MIN READ

2024年 1月 8日

借助 NVIDIA RTX 系统为 Windows PC 上的 LLM 应用程序提供强效助力

大型语言模型 (LLM) 正在从根本上改变我们与计算机的交互方式。从互联网搜索到办公效率工具,这些模型正被整合到各种应用中。

2 MIN READ

2024年 1月 8日

使用 NVIDIA TensorRT 加速的全新 Stable Diffusion 模型

在 CES 上, NVIDIA 分享道,SDXL Turbo、LCM-LoRA 和 Stable Video Diffusion 均由…

1 MIN READ

2024年 1月 5日

在某些场景中使用 cgroup 缩短 CUDA 初始化时间

在多 GPU 平台上运行的许多 CUDA 应用程序通常使用单个 GPU 来满足其计算需求。在这种情况下,应用程序会支付性能损失,

2 MIN READ

2023年 12月 19日

2023 年最热门的 NVIDIA 技术博客文章:生成式 AI、LLM、机器人开发和虚拟世界的突破

在 NVIDIA 激动人心的又一年即将结束之际,是时候回顾 2023 年 NVIDIA 技术博客中最热门的案例了。 生成式 AI、

2 MIN READ

2023年 12月 18日

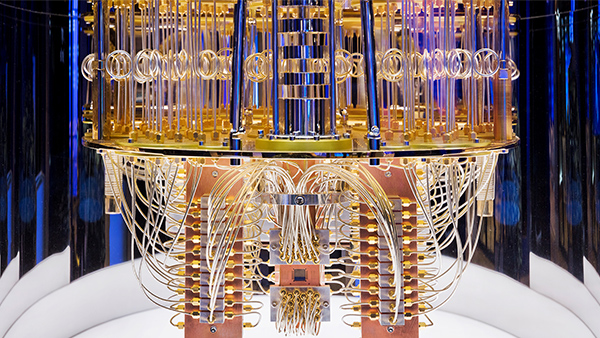

借助 NVIDIA cuQuantum 23.10 加速量子电路模拟

NVIDIA cuQuantum 是一个用于加速量子计算工作流程的优化库和工具集 SDK。借助 NVIDIA Tensor Core GPU,

2 MIN READ

2023年 11月 29日

CUDA Quantum 0.5 为量子经典计算提供新功能

CUDA 量子 是一个用于构建量子经典计算应用的平台。它是一种开源编程模型,适用于异构计算,例如 量子处理器单元 (QPU)、

1 MIN READ

2023年 11月 17日

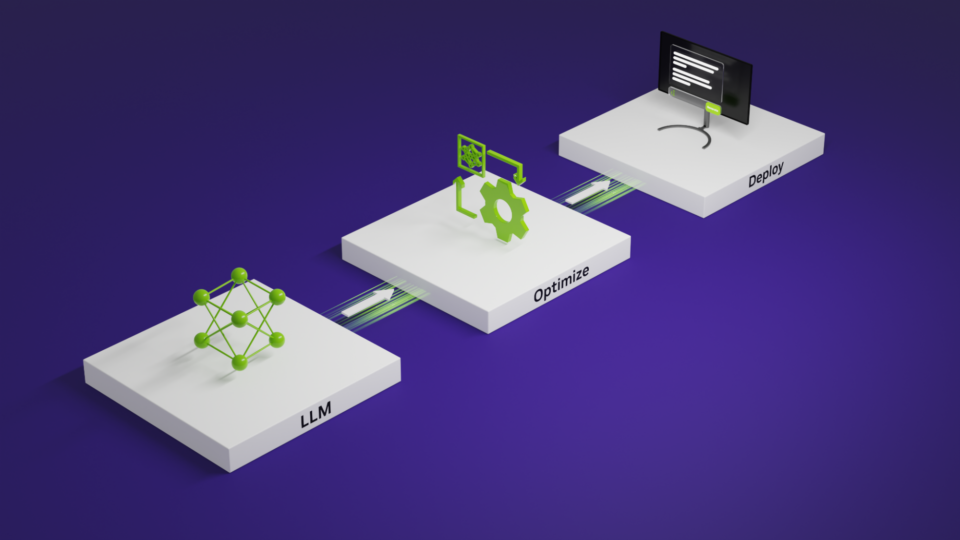

掌握 LLM 技术:推理优化

通过堆叠 Transformer 层来创建大型模型,可以提高准确性、实现少量学习功能,并且在各种语言任务中实现近乎人类的性能。

4 MIN READ

2023年 11月 16日

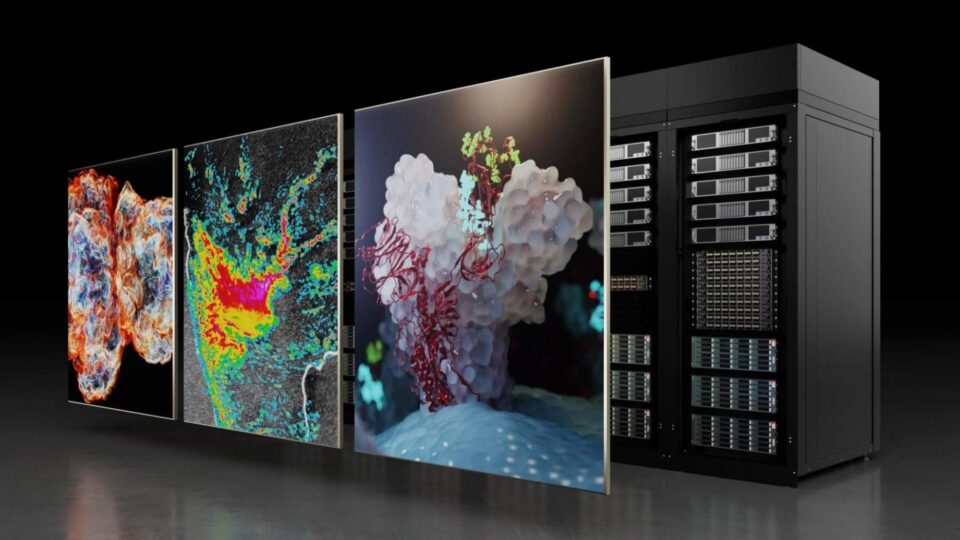

借助基础 HPC 软件发挥 NVIDIA Grace 和 NVIDIA Hopper 架构的强大功能

高性能计算(HPC)为模拟和建模、医疗健康、生命科学、工业和工程等领域的应用提供支持。在现代数据中心,HPC 与 AI 协同工作,

2 MIN READ

2023年 11月 14日

高性能计算的能效:平衡速度与可持续性

计算世界正处于巨变的边缘。 对计算能力的需求,尤其是高性能计算 (HPC) 逐年增长,这也意味着能源消耗也在增长。然而,潜在的问题当然是,

4 MIN READ

2023年 11月 14日

在 Diamond Light Source 使用 NVIDIA Holoscan 加速印刷工作流程

Diamond Light Source 是英国知名的同步辐射加速器设施,它为科学家们提供了密集的 X 射线、红外线以及其他形式的光线,

3 MIN READ