NVIDIA 向开发者透露了 AI 软件套件的主要更新,包括 JAX 、 NVIDIA CV-CUDA 和 NVIDIA RAPIDS 。

要了解 NVIDIA SDK 的最新进展,请观看首席执行官黄延森(黄仁勋)发布的 主题演讲 。

JAX 是 NVIDIA AI

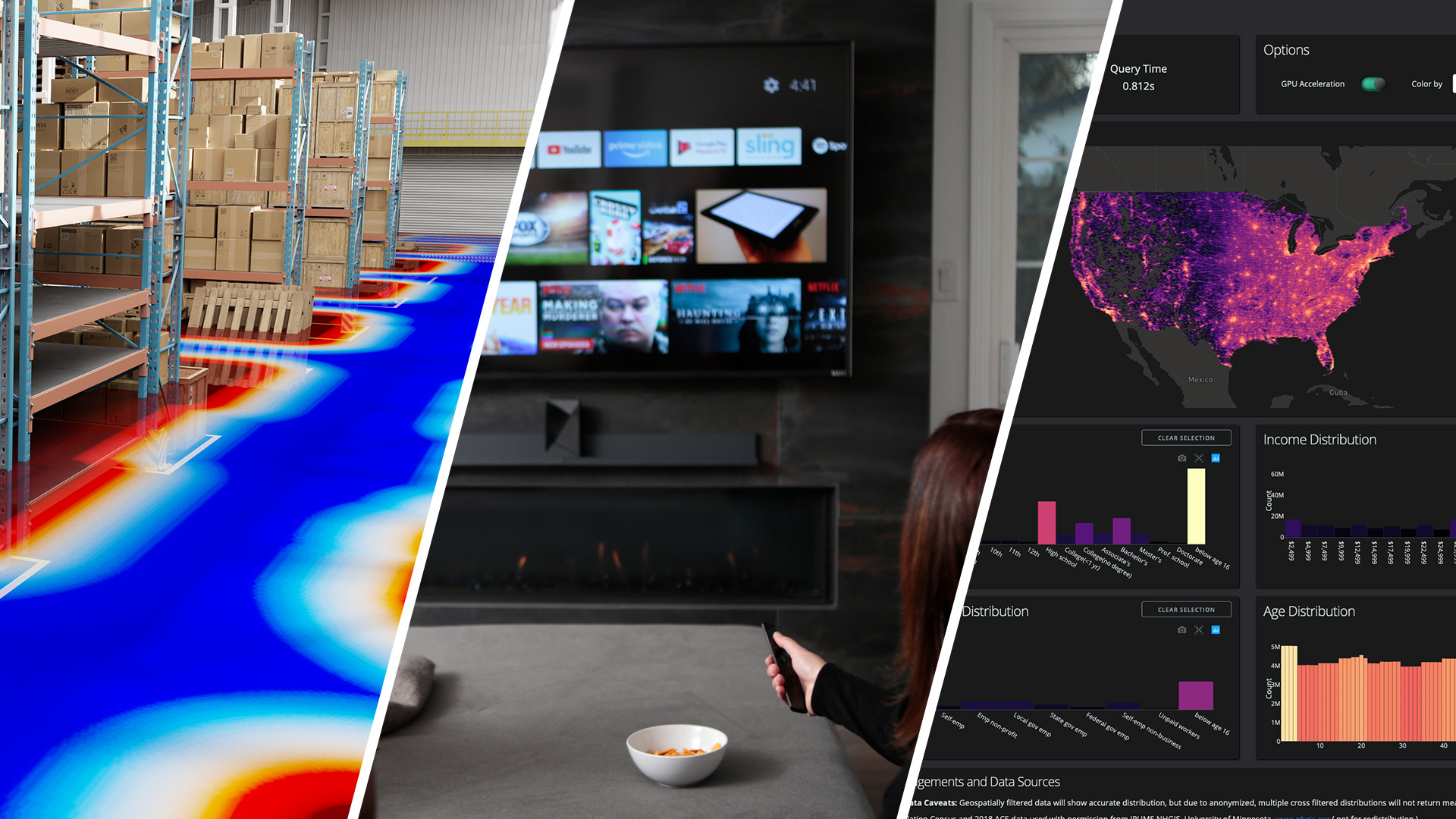

就在今天的 GTC 2022 年, NVIDIA 在 NVIDIA -AI 上引入了 JAX ,这是其 GPU 加速深度学习框架的最新补充。 JAX 是一个快速增长的高性能数值计算和机器学习研究库。

JAX 可以自动区分本机 Python 函数并实现类似 NumPy 的 API 。

只需几行代码, JAX 就可以跨多节点和多 GPU 系统进行分布式训练,并通过 NVIDIA GPU 上的 XLA 优化内核加速性能。

使用 JAX 实现的一些研究领域包括变压器、强化学习、流体动力学、地球物理建模、药物发现、计算机视觉等。 JAX 的早期采用者包括 DeepMind 、 Google Research 、 eBay 和 InstaDeep 。

NVIDIA 正在与 JAX 团队合作,以确保 GPU 上的 JAX 用户获得最佳性能和改进的体验。优化的亮点包括:

- 跨多个 GPU 和多个节点的高效扩展

- 使用针对 T5X 和基于 GPT 的模型的优化培训脚本,简化培训 LLM 的工作流程

- 为所有主要云平台构建

有关详细信息,请参阅以下资源:

- 立即申请 JAX NGC 容器更新 ,今年晚些时候可供私人提前访问。

- 查看新的 论坛 ,了解与 JAX 相关的软件产品更新、版本和关键错误修复。

- 加入我们的新 Discord server ,在 NVIDIA GPU 上使用 JAX 在社区内聊天。

将此 GTC 会话添加到日历中:

PyTorch NVIDIA AI 上的 Geometric 和 DGL

PyTorch Geometric ( PyG )和 Deep Graph Library ( DGL )是最流行的 GNN 框架。 NVIDIA 为 GPU 优化的 GNN 框架 PyG 和 DGL 引入了容器,旨在帮助开发人员、研究人员和数据科学家加速图形学习,包括 NVIDIA GPU 上具有数十亿条边的大型异构图形。

使用 NVIDIA AI 加速 GNN 框架,您可以实现端到端性能优化,使其成为预处理和训练 GNN 的最快解决方案。

此次发布的亮点:

- 用于 GPU 优化 DGL 和 PyTorch Geometric 的现成容器

- 与 CPU 相比, ETL 、采样和培训的端到端执行时间减少了 90%

- GraphSage 、 R-GCN 和 SE3 Transformer 的端到端参考示例

Amazon Search 、美国运通( American Express )、恩托斯( Entos )、美团( Meituan )和 Pinterest 已经利用了这项技术的早期版本,并取得了巨大的成果。

美国运通研究部很高兴 DGL 能够通过改进欺诈检测来帮助改善其持卡人的体验。

“ OrbNet 在 DGL 和 NVIDIA GPU 的帮助下,实现了对药物分子特性的准确和数据高效预测,通过铅识别和铅优化,将推进新药候选所需的时间减少了数年。” Tom Miller , Entos 首席执行官

“美团的 GNN 平台对 DGL 和 GPU 性能进行了优化,为美团提供多种服务,包括搜索、推荐、广告等。” Mengdi Zhang ,图学习主管,高级算法专家,美团

开发人员、研究人员和数据科学家可以使用新的容器来加速开发,从而更快地采用 GNN 。

要通过容器化解决方案快速利用 GNN ,请申请尽早访问 PyG 和 DGL 的 GPU 优化、性能优化和测试容器。

将这些 GTC 会话添加到您的日历中:

- Accelerating GNNs with PyTorch Geometric and GPUs

- Accelerating GNNs with Deep Graph Library and GPUs

- Accelerate and Scale GNNs with Deep Graph Library and GPUs

- Introduction to Graph Neural Networks

CV-CUDA I NVIDIA 公司

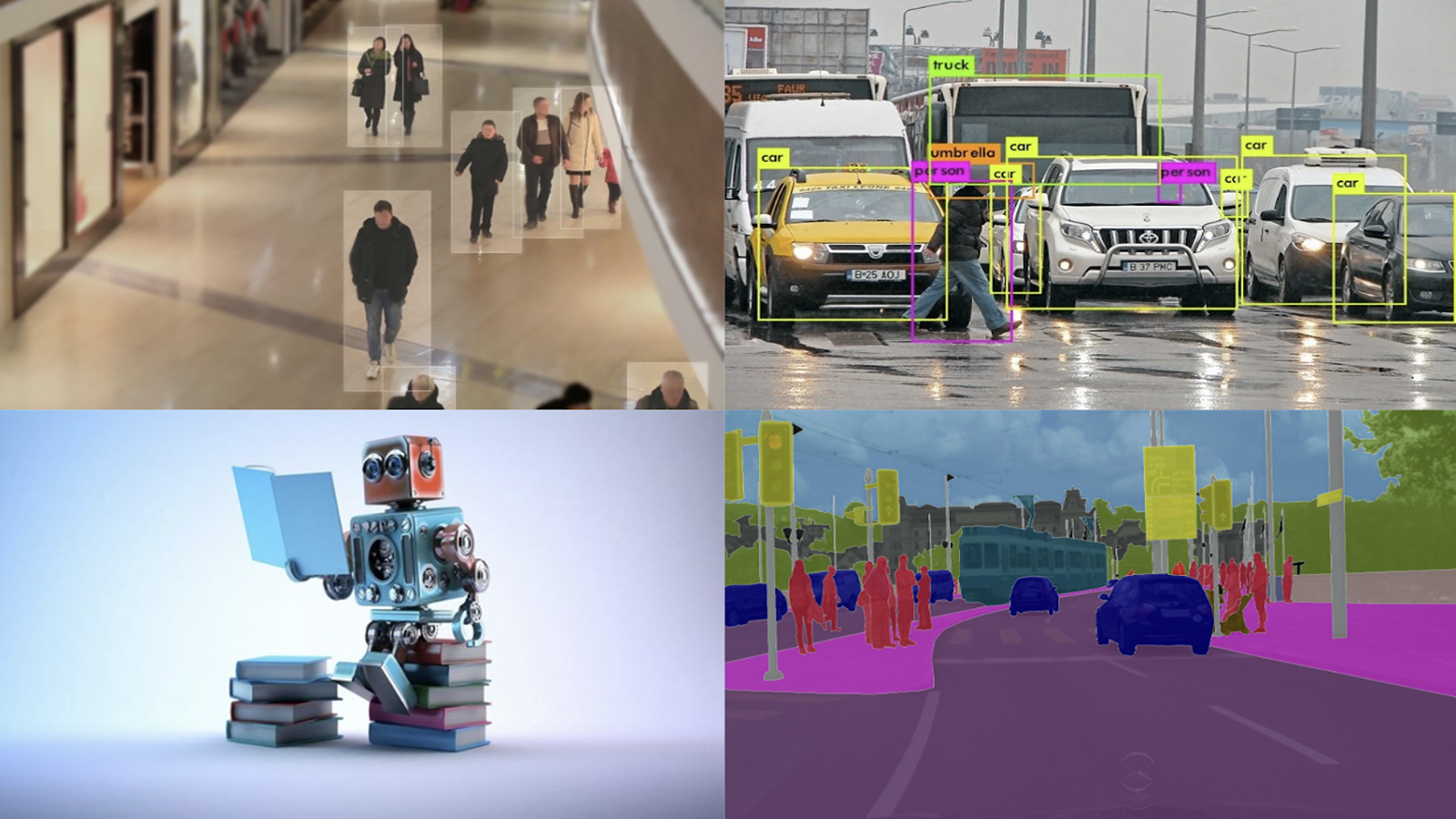

NVIDIA 推出了 CV-CUDA ,这是一个新的开源项目,使开发人员能够在云级 artificial intelligence (AI) imaging and computer vision (CV) 工作负载中构建高效、 GPU 加速的预处理和后处理管道。

亮点:

- 作为独立操作程序的 50 多个高性能 CUDA 内核的专门集合

- 批处理支持在一个批中使用可变形状图像

有关更多 CV- CUDA 更新,请参阅 CV-CUDA early access interest 页面。

NVIDIA Triton ®声波风廓线仪

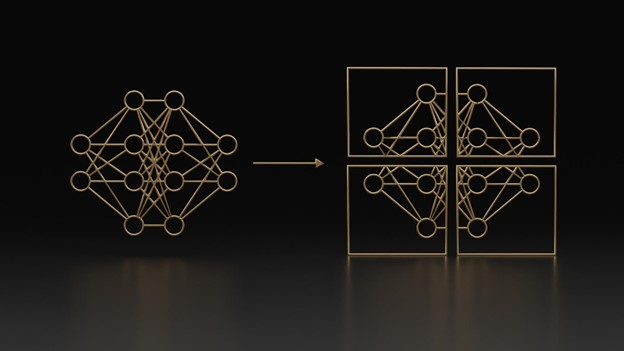

NVIDIA 宣布了对 NVIDIA Triton 的关键更新,该开源推理服务软件为生产中的每个应用程序带来了快速、可扩展的 AI 。在过去的 12 个月中,添加了 50 多个功能。

显著的功能添加:

- 使用 NVIDIA Triton 管理服务进行模型编排,该服务自动部署和管理 Kubernetes 中 Triton 推断服务器实例上的多个模型。申请 early access 。

- 具有多 GPU 的大型语言模型推理,使用 Faster transformer 后端的多节点执行。

- 使用业务逻辑脚本,使用高级逻辑对管道(集成)进行建模。

- 默认情况下,会自动生成快速部署所需的最低模型配置。

在 NVIDIA LaunchPad 中,无需设置您自己的环境即可立即、短期访问,开启您的 NVIDIA Triton 之旅。

您还可以从 NGC catalog 下载 NVIDIA Triton ,访问代码和 /triton-inference-server GitHub repo 上的文档,然后获取 企业级支持 。

将这些 GTC 会话添加到您的日历中:

- Take Your AI Inference to the Next Level

- Simplifying Inference for Every Model with Triton and TensorRT

- Accelerating and Scaling Inference with NVIDIA GPUs

- Efficient Cloud-based Deployment of Deep Learning Models using Triton Inference Server and TensorRT

查看快速

在 2022 年 GTC , NVIDIA 宣布,《财富》 100 强公司中有 25% 选择的数据科学加速解决方案 RAPIDS 正在进一步打破采用和可用性障碍。它使几乎每个组织都可以访问加速分析,无论他们使用的是低级 C ++库、 Windows ( WSL )还是基于云的数据分析平台。新功能将于 10 月中旬推出。

亮点:

- 对 WSL 和 Arm SBSA 的支持现已普遍提供

- 支持 Windows 为 900 万使用 Windows 的新 Python 开发人员带来了 RAPIDS 的便利和力量。

- 在 Kubernetes 和 Kubeflow 上轻松启动多节点工作流

- 提前估计集群资源以进行交互式工作通常具有极大的挑战性。现在,您可以方便地从交互式 Jupyter 会话中启动 Dask RAPIDS 集群,并在容器资源之外突发,以实现 ETL 和 ML 组合工作负载。

有关最新版本的更多信息,请下载并尝试 NVIDIA RAPIDS 。

将这些 GTC 会话添加到您的日历中:

- A Deep Dive into RAPIDS for Accelerated Data Science and Data Engineering

- Advances in Accelerated Data Science

NVIDIA RAPIDS Apache Spark 加速器

NVIDIA RAPIDS accelerator for Apache Spark 3.x 的新功能于 2022 年 GTC 发布。新功能带来了前所未有的透明度,帮助您在 NVIDIA GPU 上加速 Apache Spark DataFrame 和 SQL 操作,无需更改代码,也无需离开 Apache Spark 环境。版本 22.10 将于 10 月中旬推出。

此版本的新功能进一步促进了加速现有 Apache Spark 工作负载的任务,无论您在哪里运行它们。

亮点:

- 新的工作负载加速工具分析 Apache Spark 工作负载,并建议优化 GPU 参数以节省成本和提高性能。

- 与 Google Cloud DataProc 集成。

- 与三角洲湖和阿帕奇冰山融为一体。

有关最新版本的更多信息,请下载并尝试 NVIDIA RAPIDS Accelerator for Apache Spark

将这些 GTC 会话添加到您的日历中:

NVIDIA cuQuantum 和 NVIDIA -QODA

在 2022 年 GTC , NVIDIA 宣布推出最新版本的 NVIDIA cuQuantum SDK ,用于加速量子电路模拟。 cuQuantum 使量子计算生态系统能够以未来量子优势的规模解决问题,从而能够开发算法以及设计和验证量子硬件。

NVIDIA 还宣布了 NVIDIA QODA 的生态系统更新,这是一个开放的、不受 QPU 限制的混合量子经典计算平台。这种量子/经典混合编程模型可以与当今最重要的科学计算应用程序进行互操作。我们正在向大量新的领域科学家和研究人员开放量子计算机编程。

cuQuantum 亮点:

- DGX cuQuantum 设备中的多节点、多 GPU 支持

- 支持近似张量网络方法

- 采用 cuQuantum 的势头继续增强,包括 CSP 和工业量子集团

QODA 私人测试版亮点:

- 单源 C ++和 Python 实现,以及混合系统的编译器工具链和量子算法原语的标准库

- QPU 不可知,与量子硬件公司在广泛的量子比特模式上合作

- 与同样运行在 A100 GPU 上的领先 Pythonic 框架相比,速度提高了 300 倍

将这些 GTC 会话添加到您的日历中:

- An Introduction to cuQuantum

- Accelerating Quantum Computing Research with GPUs

- Scaling Quantum Circuit Simulations with cuQuantum for Quantum Algorithm

- Quantum Computing Simulation in Pharmaceuticals Research

- Defining the Quantum-Accelerated Supercomputer

- A Deep Dive into the Latest HPC Software