NVIDIA Groq 3 LPX는 에이전틱 시스템의 저지연 및 대규모 컨텍스트 요구 사항을 충족하도록 설계된 NVIDIA Vera Rubin 플랫폼용 신규 랙 스케일 추론 가속기입니다. NVIDIA Vera Rubin NVL72와 통합 설계된 LPX는 빠르고 예측 가능한 토큰 생성을 위한 최적화된 엔진을 AI 팩토리에 제공합니다. 반면, Vera Rubin NVL72는 학습과 추론을 위한 유연한 범용 워크호스로서, 롱 컨텍스트 처리, 디코드 어텐션, 대규모 고동시성 서비스 등 프리필과 디코드 전반에 걸쳐 높은 처리량을 제공합니다.

이러한 조합이 중요한 이유는 에이전틱 기술의 미래가 새로운 범주의 추론 방식을 요구하기 때문입니다. 사용자당 생성 속도가 초당 1,000토큰에 도달함에 따라, 모델은 단순한 대화 속도의 상호작용을 넘어 ‘생찰의 속도’로 계산하는 단계로 진입합니다. 이 속도에서 AI 시스템은 지속적으로 추론하고 시뮬레이션하며 응답할 수 있으며, 이는 차례를 주고받는 채팅보다는 실시간 협업에 가까운 경험을 가능하게 합니다.

이러한 변화는 멀티 에이전트 시스템의 한계치 또한 끌어올립니다. 개별 에이전트 자체로도 강력할 수 있지만, 조율된 에이전트 그룹은 인간 사회가 집단지성과 조율을 통해 능력을 확장하는 것처럼 훨씬 더 많은 일을 완수할 수 있습니다.

이러한 신규 워크로드를 지원하려면 높은 처리량과 낮은 지연 시간을 동시에 제공할 수 있는 인프라가 필요합니다. Vera Rubin NVL72와 LPX의 결합은 이러한 이기종 아키텍처를 가능하게 하며, 대규모 AI 팩토리 성능과 지속적으로 구동되는 에이전틱 시스템 및 차세대 AI 애플리케이션에 필요한 빠른 토큰 생성 능력을 결합합니다.

NVIDIA Groq 3 LPX를 소개합니다

Vera Rubin과 LPX는 Rubin GPU와 LPU의 극강의 성능을 결합하여, 조 단위 파라미터 모델에서 메가와트당 최대 35배 높은 추론 처리량과 최대 10배 더 많은 수익 기회를 제공합니다. NVIDIA MGX ETL 랙 아키텍처와 통합되고 광범위한 Vera Rubin 플랫폼과 보조를 맞추는 LPX는, 데이터 센터가 공통의 인프라 설계 내에서 Vera Rubin NVL72와 함께 전용 저지연 추론 경로를 구축할 수 있는 방법을 제시합니다.

이 시스템은 상호 연결된 256개의 NVIDIA Groq 3 LPU 가속기를 중심으로 구축되었습니다. 이 아키텍처는 결정론적 실행과 높은 온칩 SRAM 대역폭, 그리고 긴밀하게 조율된 스케일업 통신을 강조합니다. 이를 통해 동시 접속자 수가 증가하고 요청 형태가 다양해지더라도 인터랙티브 추론의 응답성을 유지할 수 있습니다.

Vera Rubin NVL72와 함께 배치된 LPX는 FFN 및 MoE 전문가 실행을 포함하여 디코드 루프 중 지연 시간에 민감한 부분을 가속화하며, 그동안 Rubin GPU는 프리필과 디코드 어텐션 처리를 지속합니다. 이들은 함께 결합하여 AI 팩토리의 처리량을 희생하지 않으면서도 인터랙티브 응답성을 향상시키는 이기종 서비스 경로를 제공합니다.

랙 스케일에서 LPX가 제공하는 성능은 다음과 같습니다:

| 사양 | NVIDIA Groq 3 LPX |

|---|---|

| AI 추론 연산 | 315 PFLOPS |

| 총 SRAM 용량 | 128 GB |

| 온칩 SRAM 대역폭 | 40 PB/s |

| 스케일업 칩 수 | 256개 |

| 스케일업 대역폭 | 640 TB/s |

Vera Rubin NVL72와 LPX는 고도의 총 토큰 생산량과 즉각적인 인터랙티브 AI 경험을 동시에 지원할 수 있는, AI 팩토리를 위한 더욱 강력한 이기종 추론 아키텍처를 형성합니다.

NVIDIA Groq 3 LPX 컴퓨트 트레이 심층 분석

LPX 랙 스케일 가속기는 대규모 저지연 추론을 지원하도록 설계된 32개의 액체 냉각 방식 1U 컴퓨트 트레이를 탑재하고 있습니다. 각 트레이는 8개의 LPU 가속기, 호스트 프로세서, 그리고 패브릭 확장 로직을 케이블 없는 설계로 통합하여, 랙 스케일 배포를 단순화하고 연산과 통신을 긴밀하게 결합합니다.

LPU 칩 간(C2C) 링크는 트레이 내부뿐만 아니라, LPU C2C 스파인을 통한 트레이 간 통신, 그리고 시스템 확장에 따른 랙 간 통신까지 직접 연결합니다. 이러한 연결성은 매우 중요한데, 인터랙티브 추론은 단순히 가공되지 않은 연산 성능뿐만 아니라 시스템이 얼마나 효율적으로 데이터를 이동시키고 작업을 조율하며 여러 장치를 거치는 요청 흐름에서 발생하는 가변적인 지연 시간을 최소화하느냐에 달려 있기 때문입니다.

각 트레이는 다음과 같은 기능을 제공합니다.

| 자원 | 트레이당 |

|---|---|

| LP30 칩 | 8개 |

| 온칩 SRAM | 4 GB |

| SRAM 대역폭 | 1.2 PB/s |

| DRAM (패브릭 확장 로직) | 최대 256 GB |

| DRAM (호스트 CPU) | 최대 128 GB |

| AI 추론 연산 (FP8) | 9.6 PFLOPS |

| 스케일업 대역폭 | 20 TB/s |

시스템 수준에서 LPX는 조정 오버헤드나 지터(Jitter)가 사용자에게 즉각적으로 감지될 수 있는 추론 환경에 최적화되어 설계되었습니다. 이는 점점 더 많은 AI 애플리케이션이 오프라인이나 처리량 중심의 서비스에서 벗어나 인터랙티브 생성 방식으로 이동함에 따라 더욱 중요해졌습니다. LPX가 이러한 환경에 어떻게 최적화되었는지 이해하려면 시스템의 핵심인 프로세서 아키텍처, 즉 NVIDIA Groq 3 LPU를 살펴볼 필요가 있습니다.

NVIDIA Groq 3 LPU 아키텍처 최초 공개—Vera Rubin 플랫폼의 일곱 번째 칩

LPX의 핵심인 NVIDIA Groq 3 LPU는 컴파일러 제어하에 연산, 메모리, 통신을 긴밀하게 결합하여 빠르고 예측 가능한 토큰 생성을 제공하도록 설계되었습니다. LPU 아키텍처는 단순히 이론적인 최대 연산 처리량만을 최적화하는 대신, 결정론적 실행과 높은 온칩 메모리 대역폭, 그리고 명시적인 데이터 이동을 강조합니다. 이러한 역량은 디코드 작업이 지배적이고 지연 시간에 민감한 추론 환경에서 특히 중요합니다.

텐서 중심 연산과 명시적 데이터 이동

LPU의 연산과 통신은 320바이트 벡터를 작업 단위로 하여 구성됩니다. 산술 연산, 메모리 액세스, 장치 간 전송이 모두 이 고정된 크기의 벡터를 기반으로 작동하므로 스케줄링과 동기화가 단순해집니다.

특화된 실행 모듈들이 각기 다른 범주의 작업을 처리합니다:

- Matrix execution modules (MXM): 텐서 연산을 위한 고밀도 곱셈-누산(Multiply-accumulate) 기능을 제공하며, 예측 가능한 처리량을 가진 고정 데이터 유형을 처리합니다.

- Vector execution modules (VXM): 각 레인(Lane)당 배치된 산술 논리 장치(ALU) 메시를 사용하여 포인트와이즈 산술, 유형 변환 및 활성화 함수를 처리합니다.

- Switch execution modules (SXM): 벡터의 순열, 회전, 분산 및 전치 등 구조화된 데이터 이동을 수행합니다.

데이터 이동을 명시적이고 프로그래밍 가능하게 설계함으로써, LPU는 하드웨어 휴리스틱에 의존하는 대신 메모리 액세스, 연산, 통신이 서로 중첩되어 실행되도록 지원합니다.

MEM을 통한 극한의 온칩 메모리 대역폭 구현

LPU의 핵심 요소는 MEM 블록입니다. 이는 500MB의 고속 온칩 SRAM이 추론을 위한 기본 작업 저장소 역할을 수행하는 플랫(Flat) 형태의 SRAM 중심 메모리 아키텍처입니다. 하드웨어가 관리하는 캐시에 의존하는 대신, 컴파일러와 런타임이 가중치, 활성화 값, KV 상태를 포함한 활성 작업 세트를 온칩 메모리에 배치하고 데이터를 명시적으로 이동시킵니다. 이는 예측 불가능한 중단을 줄이고, 지연 시간에 가장 민감한 데이터를 연산 장치와 가깝게 유지함으로써 낮고 안정적인 지연 시간을 실현하는 데 도움을 줍니다.

온칩 SRAM 용량은 한정되어 있기 때문에, 대규모 모델은 레이어별 파티셔닝과 같은 병렬 실행 전략을 사용하여 상호 연결된 여러 개의 LPU 가속기로 확장 배치되며, 이를 통해 전체 시스템은 훨씬 더 큰 유효 작업 세트를 갖게 됩니다. 이러한 설계에서 성능은 이론적인 최대 산술 처리량보다는 시스템이 연산 장치에 데이터를 얼마나 일관되게 공급할 수 있느냐에 의해 좌우됩니다. 이것이 바로 LPX가 LPU당 150TB/s의 온칩 메모리 대역폭과 고대역폭 스케일업 C2C 통신을 결합한 이유입니다.

예측 가능한 통신을 통한 C2C 확장

여러 장치로 추론을 확장하기 위해 LPU는 결정론적 데이터 교환을 위해 설계된 고밀도(High-radix) 고속 C2C 링크를 포함합니다. 각 LPU는 각각 112Gbps로 작동하는 96개의 C2C 링크를 통해 연결되어, 2.5TB/s의 높은 총 입출력(I/O) 양방향 대역폭과 예측 가능한 통신 타이밍을 갖춘 효율적인 LPX 스케일업 토폴로지를 구현합니다. 이는 통신 오버헤드가 지연 시간의 주요 원인이 될 수 있는 분산 추론 파이프라인에서 특히 중요합니다.

결정론적이고 컴파일러에 의해 조율되는 실행

LPU는 컴파일러가 연산, 데이터 이동 및 동기화를 명시적으로 스케줄링하는 Groq의 공간적 실행 모델을 기반으로 구축되었습니다. 런타임 시 동적 하드웨어 스케줄러에 의존하는 대신, 컴파일러는 하드웨어의 근사 동기식(Plesiosynchronous) 칩 간 프로토콜을 활용합니다. 이 프로토콜은 자연적인 클록 드리프트(Clock drift)를 상쇄하고 수백 개의 LPU 가속기를 정렬하여 하나의 조율된 시스템처럼 작동하게 합니다. 예측 가능한 데이터 도착과 주기적인 소프트웨어 동기화를 통해 개발자는 타이밍을 더 직접적으로 파악할 수 있으며, 시스템은 연산과 네트워크 동작 모두를 훨씬 더 높은 결정성을 가지고 조율할 수 있습니다.

이러한 실행 모델은 다음을 가능하게 합니다:

- 메모리와 연산 간의 정밀한 조율

- 명령어 타이밍에 대한 명시적 제어

- 가변적인 워크로드 환경에서 실행 지터(Jitter) 감소

실시간 추론에서 이러한 결정성은 배치가 작은 경우에도 첫 토큰 생성 시간(TTFT)과 토큰당 지연 시간을 안정적으로 유지하는 데 도움을 줍니다.

인터랙티브 추론으로의 전환

AI 추론은 광범위한 성능 스펙트럼을 포괄합니다. 한쪽 끝에는 대규모 문서 처리, 콘텐츠 모더레이션, 임베딩, 미디어 파이프라인과 같이 처리량에 최적화된 서비스들이 있습니다. 이 서비스들의 목표는 GPU당 토큰 수, 와트당 토큰 수, 또는 전반적인 비용 효율성을 극대화하는 것입니다. 이러한 워크로드는 종종 무료 티어나 백그라운드 AI 서비스와 같이 대규모 공용 서비스를 지원하며, 개별 사용자의 응답성보다는 높은 가동률이 더 중요하게 여겨집니다.

다른 한쪽 끝에는 코딩 어시스턴트, 챗봇, 음성 비서, 코파일럿, 인터랙티브 에이전트와 같이 지연 시간에 최적화된 서비스들이 있습니다. 이러한 서비스에서는 지연이 사용자에게 즉각적으로 감지됩니다. 따라서 이 워크로드에서 가장 중요한 지표는 첫 토큰 생성 시간, 사용자당 초당 토큰 수, 그리고 꼬리 지연 시간(Tail latency)입니다. 대다수의 현대 AI 플랫폼은 이 두 가지 환경을 동시에 지원해야 하며, 대규모 처리를 위한 고처리량 백엔드를 운영하는 동시에 즉각적인 응답성을 갖춘 인터랙티브 경험을 제공해야 합니다. 이러한 성능 요구사항의 분산이 바로 이기종 추론 아키텍처가 점점 더 중요해지는 이유 중 하나입니다.

인터랙티브 추론이 더 어려운 이유

표 3에서 보여주듯, 몇 가지 트렌드로 인해 저지연 인터랙티브 추론은 더 중요해지는 동시에 효율적으로 서비스하기는 더 까다로워지고 있습니다. 모델이 더 긴 결과물을 생성하고 컨텍스트 윈도우가 커짐에 따라, 워크로드의 더 많은 부분이 토큰이 순차적으로 생성되는 디코드 단계로 이동하게 되며, 이에 따른 응답성 수준이 사용자에게 직접적으로 노출됩니다.

인터랙티브 추론을 더 어렵게 만드는 네 가지 요인이 있습니다.

| 요인 | 중요한 이유 |

|---|---|

| 저지연이 제품 기능으로 자리잡음 | 인터랙티브 애플리케이션에서 응답성은 인프라 지표를 넘어 사용자가 평가하는 제품 품질의 일부가 됐습니다. |

| 추론 출력의 장문화 | 모델이 더 긴 출력과 다단계 사고 과정을 생성하면서, 요청의 더 많은 부분이 순차적 토큰 생성으로 채워집니다. |

| 프리픽스 캐싱 | 공유 프롬프트 상태를 재사용하면 프리필 비용은 줄지만, 빠르게 서비스해야 할 요청별 디코드 작업의 상대적 비중은 높아집니다. |

| 컨텍스트 길이 증가 | 컨텍스트가 길어질수록 트랜스포머의 셀프어텐션 메커니즘이 데이터 이동과 메모리 대역폭에 점점 더 제약받습니다. |

동시에 컨텍스트가 길어질수록 메모리 대역폭과 데이터 이동에 가해지는 압박이 커지며, 다수의 동시 사용자를 지원할 때는 처리량 중심의 시스템이 의존하는 배치 효율성이 저하됩니다. 결과적으로 총 처리량 극대화에만 최적화된 시스템은 각 요청에 대해 빠르고 예측 가능한 토큰 생성을 요구하는 워크로드에는 항상 최적의 선택이 아닐 수 있습니다.

이러한 과제는 시스템이 추론, 검색, 도구 사용 및 추론 과정을 반복적으로 순환하는 에이전틱 AI에서 더욱 두드러집니다. 이러한 루프 내에서는 각 단계마다 지연 시간이 복리로 누적되므로, 즉각적인 사용자 경험을 위해서는 안정적인 토큰당 성능과 강력한 꼬리 지연 시간 관리 능력이 필수적입니다.

에이전틱 추론의 시대, 새로운 아키텍처가 필요하다

추론은 단일하고 균일한 워크로드가 아닙니다. 하나의 요청 내에서도 프리필(Prefill)과 디코드(Decode)는 하드웨어에 서로 다른 요구 사항을 제시하며, 이러한 요구 사항은 배치 크기, 컨텍스트 길이, 모델 구조에 따라 달라집니다. 셀프 어텐션(Self-attention)이나 희소 MoE를 포함한 일부 단계는 메모리 대역폭과 데이터 이동에 매우 민감해질 수 있는 반면, 고밀도 프로젝션 및 피드포워드 레이어와 같은 단계는 병렬 처리가 충분할 경우 처리량 최적화 하드웨어에서 효율적으로 확장됩니다. 인터랙티브 디코드 상황에서는 많은 연산이 매우 작은 배치 크기에서 실행되므로, 지연 시간은 중단(Stall), 경합(Contention), 지터(Jitter)에 훨씬 더 민감해집니다.

전체 파이프라인을 단 하나의 환경에만 맞춰 최적화하면 타협이 강제됩니다. 큰 배치 환경에서 최대 처리량을 내도록 튜닝된 하드웨어는 지연 시간에 가장 민감한 실행 경로에는 이상적이지 않으며, 반대로 저지연 실행에 최적화된 하드웨어는 연산 집약적인 단계에서 효율성이 떨어집니다.

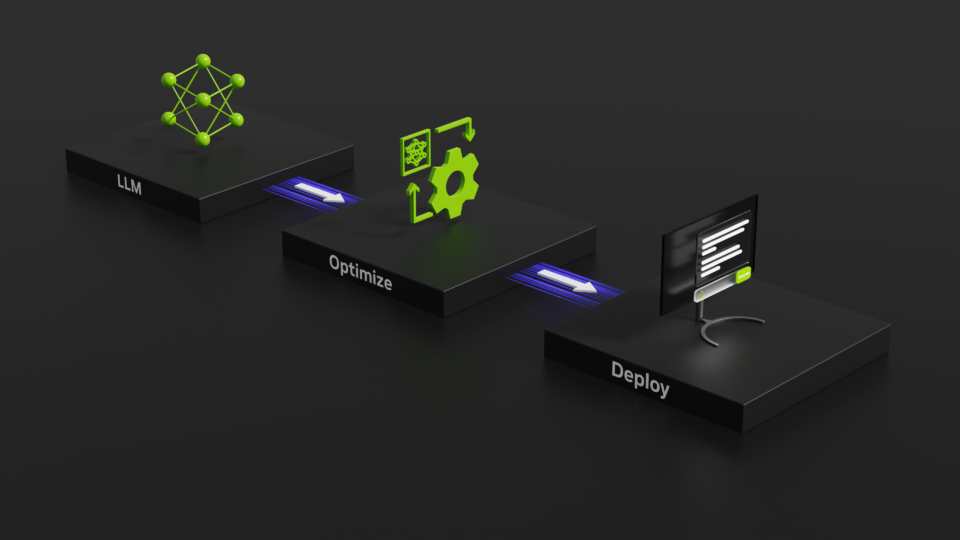

그림 4에서 보듯, 이기종 시스템은 이 두 가지 접근 방식을 결합하여 저지연 인터랙티브 성능과 높은 AI 팩토리 처리량을 동시에 구현합니다. 그 결과는 ‘투-엔진(Two-engine)’ 아키텍처입니다. GPU는 컨텍스트가 많은 프리필에서 높은 출력을 제공하고 디코드 어텐션을 실행하며, LPU는 FFN/MoE 실행과 같이 지연 시간에 민감한 디코드 구성 요소를 가속화합니다. 이들은 함께 결합되어 AI 팩토리의 처리량을 포기하지 않으면서도 인터랙티브 성능을 향상시킵니다.

Vera Rubin NVL72와 LPX의 만남

현대적인 추론은 마치 이어달리기와 같습니다. 대규모 컨텍스트를 처리하는 무거운 구간을 달린 하드웨어가 다음 토큰을 향한 전력 질주 구간까지 도맡을 필요는 없습니다. Rubin GPU는 학습과 추론을 위한 유연하고 범용적인 핵심 동력입니다. 이들은 롱 컨텍스트 프리필부터 디코드 어텐션, 대규모 고동시성 추론에 이르기까지 다양한 모델 크기, 배치 환경, 서비스 패턴 전반에서 높은 처리량을 제공합니다.

LPX는 빠르고 지연 시간에 민감한 토큰 생성을 위해 최적화된 전용 경로를 추가합니다. 이 둘의 결합은 시스템 규모의 효율성을 유지하면서도 인터랙티브 응답성을 향상시키는 이기종 추론 설계를 가능하게 합니다.

디코드 단계: 반복되는 멀티 엔진 루프

프리필(Prefill) 단계는 방대한 입력을 읽어 들이고 KV 캐시를 구축하는 작업이 주를 이루며, 이는 고밀도 병렬 연산과 대용량 메모리 성능의 혜택을 크게 받는 워크로드입니다. Vera Rubin NVL72는 특히 컨텍스트가 크고 가변성이 높은 롱 컨텍스트 워크로드와 MoE 모델에서 이 단계를 효율적으로 처리합니다.

디코드 단계는 이와 다릅니다. 디코드는 토큰당 반복되는 루프이며, 이 루프의 각기 다른 부분은 서로 다른 병목 현상을 유발합니다. LPX가 포함된 Vera Rubin 플랫폼 아키텍처에서 디코드는 ‘투-엔진(Two-engine) 루프’로 이해하는 것이 가장 좋습니다. GPU는 누적된 KV 캐시에 대한 전체 컨텍스트 어텐션과 같이 처리량과 대용량 메모리가 가장 중요한 디코드 작업을 처리합니다. 반면 LPX는 희소 MoE 전문가 피드포워드 네트워크(FFN) 및 기타 포인트와이즈 연산과 같이 지연 시간에 민감한 디코드 실행을 가속화합니다. 이러한 분할 방식은 흔히 ‘디코드 단계 분리’ 또는 ‘어텐션-FFN 분리(AFD)’라고 불립니다. 이는 디코드 내에서 어텐션과 FFN을 분리하고 각 토큰에 대한 중간 활성화 값을 교환함으로써, 각 엔진이 자신이 가장 잘 수행할 수 있는 루프의 부분을 실행하게 합니다. 이러한 AFD 루프는 파레토 프런티어(Pareto frontier)에서 가장 가치 있는 운영 영역을 확장해 줍니다.

랙 스케일 및 그 이상의 규모에서 LPX는 긴밀하게 조율된 하나의 연산 단위로 작동하도록 설계되어 조정 오버헤드를 최소화하고 지터(Jitter)를 줄입니다. 이는 작은 지연이 수많은 모델 호출과 검증 루프를 거치며 복리로 누적되는 디코드 중심의 에이전틱 워크플로에서 매우 가치 있는 특성입니다.

NVIDIA Dynamo를 통한 이기종 디코드의 실현

이기종 디코드를 실무에 적용하려면 요청을 분류하고, 지연 시간 목표에 따라 작업을 라우팅하며, 낮은 오버헤드로 중간 활성화 값을 이동시키고, 급증하거나 가변적인 트래픽 하에서도 꼬리 지연 시간을 안정적으로 유지할 수 있는 소프트웨어가 필요합니다. NVIDIA Dynamo는 이기종 백엔드 전반에서 분산 서비스 및 분산 디코드를 조율함으로써 이러한 오케스트레이션 레이어를 제공합니다.

실제 운용 시, Dynamo는 방대한 컨텍스트를 처리하고 KV 캐시를 구축하기 위해 프리필 단계를 GPU 워커로 라우팅합니다. 디코드 단계 동안 Dynamo는 AFD 루프를 조율합니다. 이 루프에서 GPU는 누적된 KV 캐시에 대해 어텐션을 실행하고, 중간 활성화 값은 FFN/MoE 실행을 위해 LPU로 전달되며, 그 출력값은 다시 GPU로 돌아와 토큰 생성을 지속합니다. 그 결과, 높은 AI 팩토리 처리량을 유지하면서도 더욱 예측 가능한 꼬리 지연 시간을 갖춘 단일하고 일관된 서비스 경로가 완성됩니다.

KV 인지 라우팅, 저오버헤드 전송, 지연 시간 목표 기반 스케줄링을 통해 Dynamo는 인터랙티브 세션이 긴 대기열에 갇히는 것을 방지하고, 테넌트 간 지터를 줄이며, 동시 접속자 수와 요청 형태가 변하더라도 안정적인 꼬리 지연 시간을 유지하도록 돕습니다. 그 결과, 대규모 AI 팩토리 처리량을 지속하면서도 즉각적인 사용자 경험을 제공하는 프로덕션급 이기종 서비스 모델이 완성됩니다.

LPX를 통한 투기적 디코딩 가속화

투기적 디코딩(Speculative decoding)은 LLM 추론 지연 시간을 줄이는 데 점점 더 중요해지고 있는 기술입니다. 이 방식은 더 작은 초안 모델(Draft model)을 사용해 여러 개의 후보 토큰을 미리 생성하고, 더 큰 타겟 모델(Target model)이 이를 병렬로 검증 및 수용하는 구조입니다. 예측이 일치하면 한 번에 여러 토큰을 확정할 수 있어, 실질적인 초당 토큰 수를 크게 늘리고 응답 지연 시간을 줄일 수 있습니다.

LPX는 이러한 아키텍처에서 초안 생성 엔진 역할을 수행하기에 매우 적합합니다. LPU의 결정론적 실행 모델과 극도로 높은 온칩 SRAM 대역폭은 초안 토큰을 매우 빠르게 생성하여 초안 모델이 검증 모델보다 앞서 나갈 수 있게 합니다. 동시에 Rubin과 같은 GPU는 프리필, 어텐션 처리, 토큰 검증과 같은 대형 모델 실행 작업에서 여전히 높은 효율성을 유지합니다.

두 장치를 결합함으로써 시스템은 두 프로세서의 강점을 모두 활용하게 됩니다:

- LPX는 저지연 아키텍처를 사용하여 초안 토큰을 신속하게 생성합니다.

- Rubin GPU는 고처리량 연산과 대용량 메모리 성능을 활용해 토큰을 효율적으로 검증하고 최종 확정합니다.

이러한 분리 구조는 초안 모델과 검증 모델을 동일한 하드웨어에서 실행하는 대신, 서로 다른 이기종 프로세서에 걸쳐 투기적 디코딩을 수행할 수 있게 합니다. 그 결과 GPU 기반 검증의 효율성을 희생하지 않으면서도 더 빠른 초안 생성이 가능한 시스템이 구축됩니다.

지능형 에이전틱 스웜의 가능성을 열다

AI 활용 사례가 단순한 채팅이나 배치 추론을 넘어 다단계 에이전틱 워크플로우로 진화함에 따라, 응답성은 필수 요건이 되었습니다. 오프라인 추론이나 기본적인 비서 서비스는 총 처리량을 우선시할 수 있지만, 인터랙티브 애플리케이션, 심층 연구, 그리고 에이전틱 파이프라인은 방대한 토큰 생성량과 긴밀한 피드백 루프가 결합된 형태를 띱니다. 이러한 환경에서는 수많은 모델 호출과 도구 간의 상호작용을 거치며 지연 시간이 복리로 누적됩니다.

이러한 환경에서 이기종 추론 아키텍처는 매우 중요합니다. 롱 컨텍스트 처리를 위한 고처리량 엔진과 디코드 FFN을 위한 저지연 엔진을 결합함으로써, AI 팩토리의 출력을 희생하지 않으면서도 사용자와의 상호작용 성능을 높이는 것이 가능해집니다.

파레토 프런티어에서 구현되는 새로운 범주의 AI 경험

성능과 비용 사이의 이러한 절충 관계를 시각화하는 실질적인 방법은 파레토 프런티어(Pareto frontier)를 이용하는 것입니다. 가로축에는 사용자당 초당 토큰 수(TPS per user)로 측정되는 ‘사용자 상호작용성’을, 세로축에는 메가와트당 초당 토큰 수(TPS per MW)로 측정되는 ‘AI 팩토리 처리량’을 배치하여 도식화할 수 있습니다.

그림 10에서 보듯, 서로 다른 AI 서비스들은 이 곡선 상의 매우 상이한 지점에서 작동합니다. 대다수의 무료 티어 및 백그라운드 워크로드를 포함한 처리량 우선 서비스들은 일반적으로 최대 효율과 높은 가동률을 우선시하며, 흔히 컨텍스트 윈도우가 짧은 소형 모델을 사용합니다. 반면 프리미엄 AI 서비스는 더 높은 모델 역량과 훨씬 더 민감한 사용자 체감 성능을 요구하며, 특히 롱 컨텍스트 추론과 에이전틱 워크플로에서 더욱 그러합니다. 그림 10에서 이러한 프리미엄 티어는 약 400 TPS per user 이상의 속도로 작동하는 40만 토큰 입력 컨텍스트 윈도우 기반의 2조 파라미터 MoE 모델로 표현됩니다.

단일한 동질적 플랫폼으로 이러한 프리미엄 운영 지점에 도달하려면 응답성과 전체 AI 팩토리 처리량 사이에서 타협이 강제됩니다. 워크로드 내에서 근본적으로 다른 성능 특성이 동일한 서비스 파이프라인에 섞여 있기 때문입니다. 이기종 아키텍처는 보완적인 실행 경로를 결합하여 달성 가능한 영역을 확장하며, 시스템이 높은 팩토리 출력을 유지하는 동시에 응답성이 뛰어난 저지연 인터랙티브 경험을 제공할 수 있게 합니다. 그림 10에서 알 수 있듯이, Vera Rubin NVL72와 LPX의 조합은 사용자당 400 TPS 환경에서 NVIDIA GB200 NVL72 대비 메가와트당 최대 35배 높은 TPS를 제공하며, 인터랙티브 AI 서비스를 위한 새로운 프리미엄 성능 등급을 효과적으로 창출합니다.

이러한 변화는 직접적인 경제적 영향을 미칩니다. 더 높은 응답성은 AI 팩토리가 제공할 수 있는 프리미엄 경험의 범위를 넓히고, 인프라 단위당 가치를 증대시킵니다. Vera Rubin 플랫폼을 통해 AI 팩토리는 GB200 NVL72 대비 메가와트당 최대 5배 더 많은 수익을 창출할 수 있으며, 에이전틱 코딩 및 멀티 에이전트 시스템과 같이 지연 시간에 가장 민감하고 가치가 높은 인터랙티브 워크로드에서 Vera Rubin NVL72와 LPX를 결합할 경우 최대 10배까지 수익 기회를 확대할 수 있습니다.

NVIDIA Groq 3 LPX가 개발자에게 제공하는 가치

개발자들은 점차 다음의 세 가지 요소를 동시에 충족해야 하는 시스템을 구축하고 있습니다:

- 응답성: 인터랙티브 경험과 에이전트 루프를 위한 낮고 예측 가능한 지연 시간.

- 역량: 강력한 모델 품질, 추론의 깊이, 그리고 롱 컨텍스트 이해 능력.

- 규모: 수많은 동시 사용자나 에이전트를 수용하기 위한 높은 처리량과 비용 효율성.

LPX는 AI 팩토리가 효율적으로 처리할 수 있는 워크로드의 범위를 넓혀줍니다. 코딩 어시스턴트, 긴밀한 도구 호출 루프가 포함된 에이전틱 워크플로, 음성 상호작용, 실시간 번역과 같이 예측 가능한 토큰 생성이 사용자 경험을 개선하는 영역에서는 저지연 경로를 사용하세요. 반면, 높은 동시성과 배치를 통해 GPU를 지속적으로 가동하고 비용 효율을 유지할 수 있는 배치 서비스나 롱 컨텍스트 처리량 중심 작업은 Rubin GPU에 맡기십시오. 이제 운영의 관점을 전환해야 할 때입니다. 단 하나의 대표 지표에만 매몰되지 말고, 실제 환경의 다양한 운영 지점에 맞춰 최적화를 시작하세요.

더 알아보기

NVIDIA Vera Rubin 플랫폼, LPX, AFD, Dynamo를 다루는 제품 페이지와 기술 블로그를 통해 NVIDIA Groq 3 LPX 및 Vera Rubin의 아키텍처를 더 깊이 살펴보세요. 텐서 스트리밍 프로세서 및 AI를 위한 소프트웨어 정의 실리콘 설계에 관한 기초 연구 자료도 확인해 보시기 바랍니다. 이러한 리소스들은 대규모 이기종 저지연 추론의 근간이 되는 하드웨어, 시스템 아키텍처 및 오케스트레이션 소프트웨어에 대한 심층적인 인사이트를 제공합니다. 그다음, 추론 및 배포에 집중된 NVIDIA 개발자 포럼 스레드에 참여하여 저지연 서비스 시스템을 구축 중인 다른 팀들과 정보를 공유해 보세요.

리소스

- NVIDIA LPX page

- 보도자료: NVIDIA Vera Rubin Opens Agentic AI Frontier

- 기술 블로그: Inside the NVIDIA Rubin Platform: Six New Chips, One AI Supercomputer

- 기술 블로그: NVIDIA Vera Rubin POD: Seven Chips, Five Rack-Scale Systems, One AI Supercomputer

- 기술 블로그: Announcing NVIDIA Dynamo 1.0: Scaling MultiNode Inference in Production

- 비디오: The Future of AI Inference – Explainer on Attention-FFN Disaggregation AFD (starting at 18:00)

- 기술 블로그: NVIDIA Vera CPU Delivers High Performance, Bandwidth, and Efficiency for AI Factories

- 리서치 문서: Think Fast: A Tensor Streaming Processor (TSP) for Accelerating Deep Learning Workloads

- 리서치 문서: A Software-defined Tensor Streaming Multiprocessor for Large-scale Machine Learning

- 비디오: Enabling PyTorch’s Thousand Ops for Software First Silicon Design

감사의 글

본 게시물에 기여해 주신 Amr Elmeleegy, Andrew Bitar, Andrew Ling, Graham Steele, Itay Neeman, Jamie Li, Omar Kilani, Santosh Raghavan, Stuart Pitts를 비롯하여, 이 성과를 가능하게 한 수많은 NVIDIA 제품 리더, 엔지니어 및 아키텍트 여러분께 감사를 표합니다.