教程

2024年 5月 13日

使用 NVIDIA NeMo 定制神经机器翻译模型,第 1 部分

神经机器翻译(NMT)是一种将一序列的文字从一种语言翻译成另一种语言的自动任务。近年来,

2 MIN READ

2024年 5月 13日

使用 NVIDIA NeMo 定制神经机器翻译模型,第 2 部分

在 上一篇文章 中,我们介绍了使用 NeMo 运行英-中翻译模型的示例,并评估其性能。在这篇文章中,我们将指导您如何定制数据集,

3 MIN READ

2024年 5月 9日

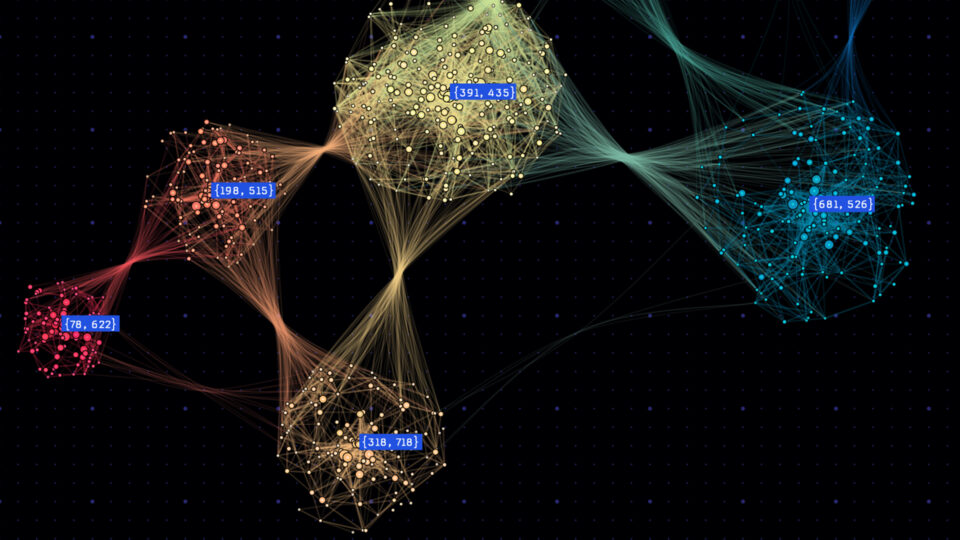

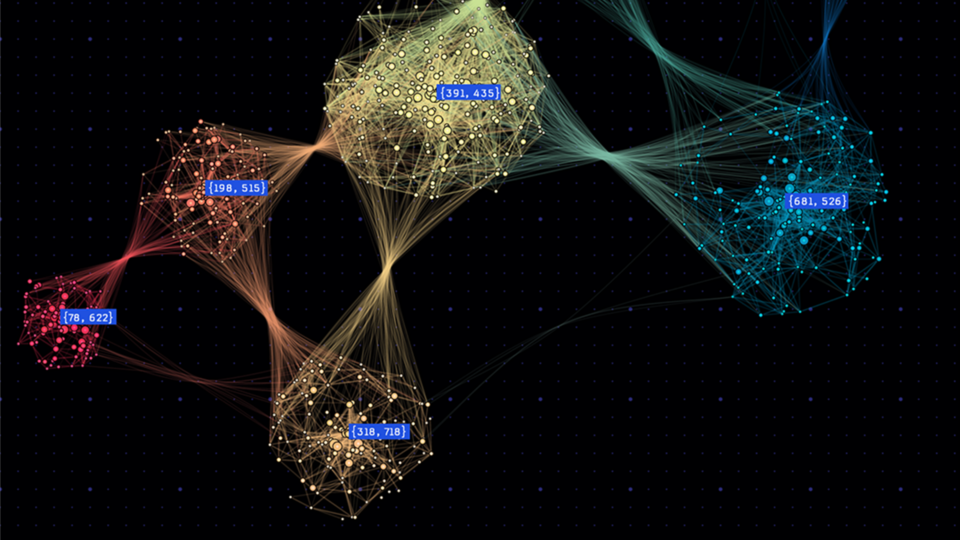

革命性的图形分析: NVIDIA cuGraph 加速的下一代架构

在我们的 先前的图分析探索 中,我们使用 NVIDIA cuGraph 揭示了 GPU-CPU 融合的变革力量。基于这些见解,

3 MIN READ

2024年 5月 9日

利用内置 Flowstate 和 NVIDIA Isaac 机械手实现智能取放自动化

我们宣布与Intrinsic.ai 合作,学习工业机器人任务的基础技能模型。 工业制造中的许多挑选和放置问题仍然由人工操作员完成,

1 MIN READ

2024年 4月 29日

NVIDIA GTC 2024 的顶级数据科学会议现已按需提供

在 GTC 2024 上, NVIDIA 的专家和我们的合作伙伴分享了有关 GPU 加速工具、优化和数据科学家最佳实践的见解。

1 MIN READ

2024年 4月 26日

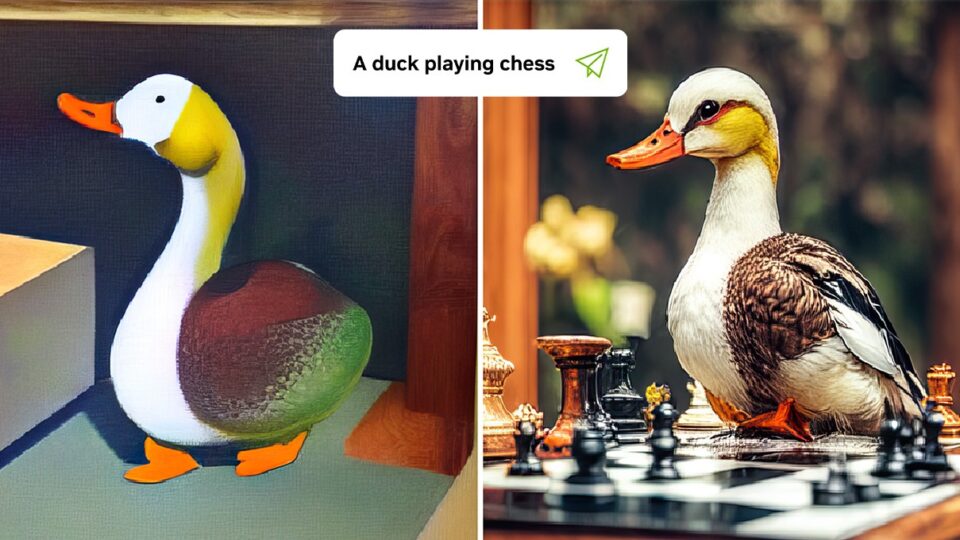

使用 DRaFT+增强文本到图像的微调,现已是 NVIDIA NeMo 的一部分

文本到图像的 Diffusion 模型已经被建立为基于给定文本的高保真图像生成的强大方法。然而,

3 MIN READ

2024年 4月 23日

借助 Union.ai 和 NVIDIA DGX 云实现 AI 工作流程的大众化

GPU 最初专用于在电子游戏中渲染 3D 图形,主要用于加速线性代数计算。如今,GPU 已成为 AI 革命的关键组成部分之一。 现在,

2 MIN READ

2024年 4月 22日

借助 NVIDIA TensorRT-LLM 和 NVIDIA Triton 推理服务器提升 Meta Llama 3 性能

我们很高兴地宣布支持 Meta Llama 3 系列模型,通过 NVIDIA TensorRT LLM 加速和优化 LLM 推理性能。

2 MIN READ

2024年 4月 19日

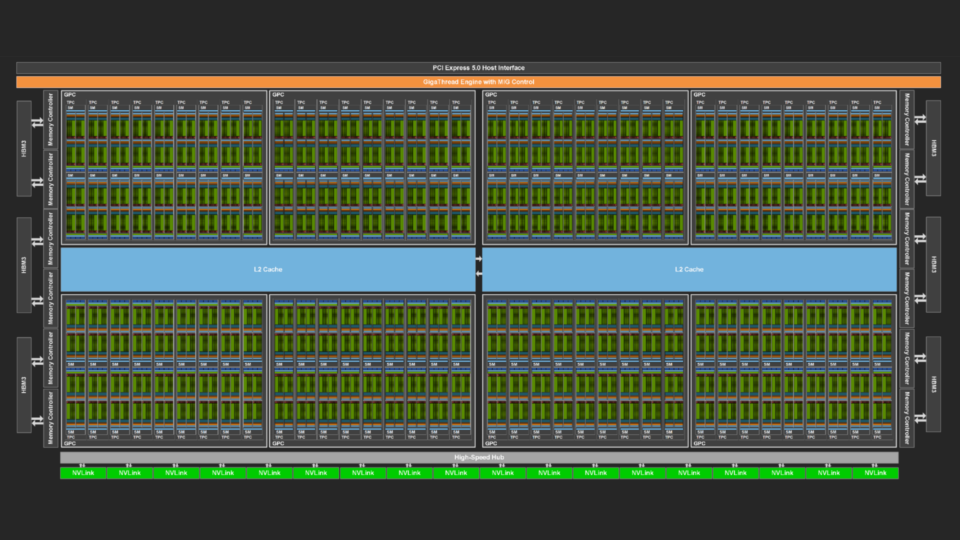

测量多流工作负载的 GPU 占用率

随着新一代产品的推出, NVIDIA GPU 的性能也变得越来越强大。这种提升通常有两种形式。每个流多处理器 (SM) (GPU 的主力)…

3 MIN READ

2024年 4月 18日

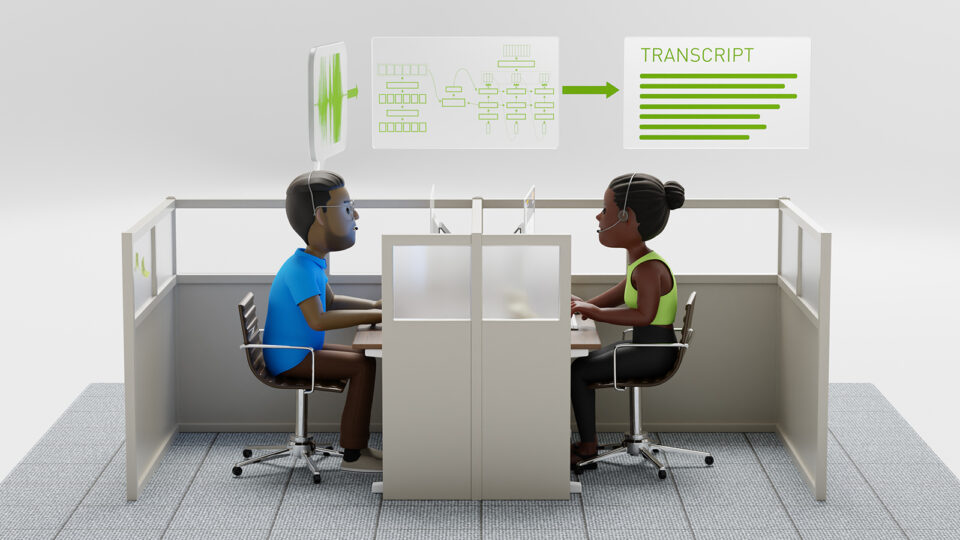

借助 NVIDIA NeMo Parakeet ASR 模型突破语音识别的界限

NVIDIA NeMo Parakeet 是一个端到端平台,用于在任何地方(任何云端和本地)大规模开发多模态生成式 AI 模型,

2 MIN READ

2024年 4月 18日

NVIDIA NeMo Canary 模型的语音识别和翻译新标准

NVIDIA NeMo 是一种端到端平台,用于开发和部署多模态 生成式 AI 模型。它可以随时随地进行大规模模型部署。

2 MIN READ

2024年 4月 2日

使用 NVIDIA TensorRT-LLM 调整和部署 LoRA LLM

大型语言模型 (LLM) 可以从大量文本中学习,并为各种任务和领域生成流畅、一致的文本,从而彻底改变自然语言处理 (NLP)。然而,

7 MIN READ

2024年 3月 27日

高效的 CUDA 调试:将 NVIDIA Compute Sanitizer 与 NVIDIA 工具扩展程序结合使用并创建自定义工具

NVIDIA Compute Sanitizer 是一款功能强大的工具,可以节省时间和精力,同时提高 CUDA 应用程序的可靠性和性能。

5 MIN READ

2024年 3月 18日

如何通过四个步骤将 RAG 应用程序从试点阶段转变为生产阶段

生成式 AI 具有改变各个行业的巨大潜力。人类工作者已经开始使用 大型语言模型(LLM) 来解释、推理和解决复杂的认知任务。

2 MIN READ

2024年 3月 8日

WholeGraph 存储:优化图形神经网络的内存和检索

图形神经网络 (GNN) 彻底改变了图形结构数据的机器学习。与传统神经网络不同,GNN 擅长捕捉图形中的复杂关系,

2 MIN READ

2024年 3月 7日

简化 Cumulus Linux 迁移

软件的主要版本之间的迁移可能会对基础设施管理团队带来几个挑战: 这些挑战可能会阻碍用户采用新版本,因此他们将错过更新、更强大的功能。

2 MIN READ