几年前,NVIDIA 创始人兼首席执行官黄仁勋亲自交付了世界上第一台NVIDIA DGX AI 系统到 OpenAI 。至今,OpenAI 的 ChatGPT 已经在全球范围内大受欢迎,这凸显了人工智能(AI)以及如何将其应用于各行各业,无论是小型企业还是大型企业。

现在,你有没有停下来思考一下托管和支持 ChatGPT 所需的技术和基础设施?

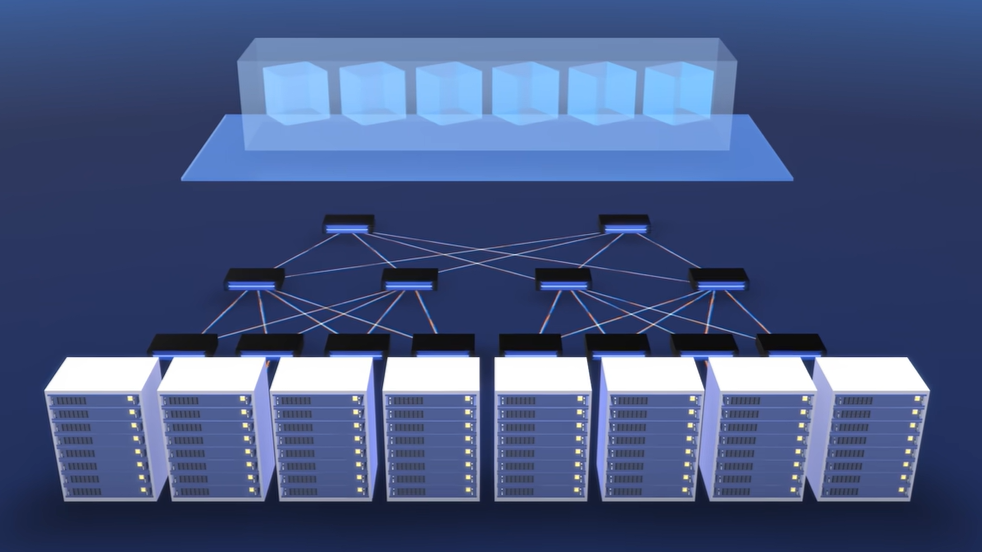

在这段视频中,微软 Azure 首席技术官 Mark Russinovich 解释了他们专门构建的人工智能超级计算机基础设施背后的技术堆栈。它是由 NVIDIA、Microsoft Azure 和 OpenAI 合作开发的,用于托管 ChatGPT 和其他大型语言模型(LLMs)以任何规模。

主要收获

- NVIDIA H100 Tensor Core GPUs 的数据并行方法使推理性能提高了 30 倍,模型训练性能提高了 4 倍。

- 满足LLM 的更高处理要求,虚拟机可以使用NVIDIA Quantum-2 InfiniBand联网进行扩展。

- 大规模训练不可避免地会出现服务器故障和网络故障。微软的 Project Forge 引入了透明的检查点,以快速恢复工作并在全球范围内保持高水平的利用率

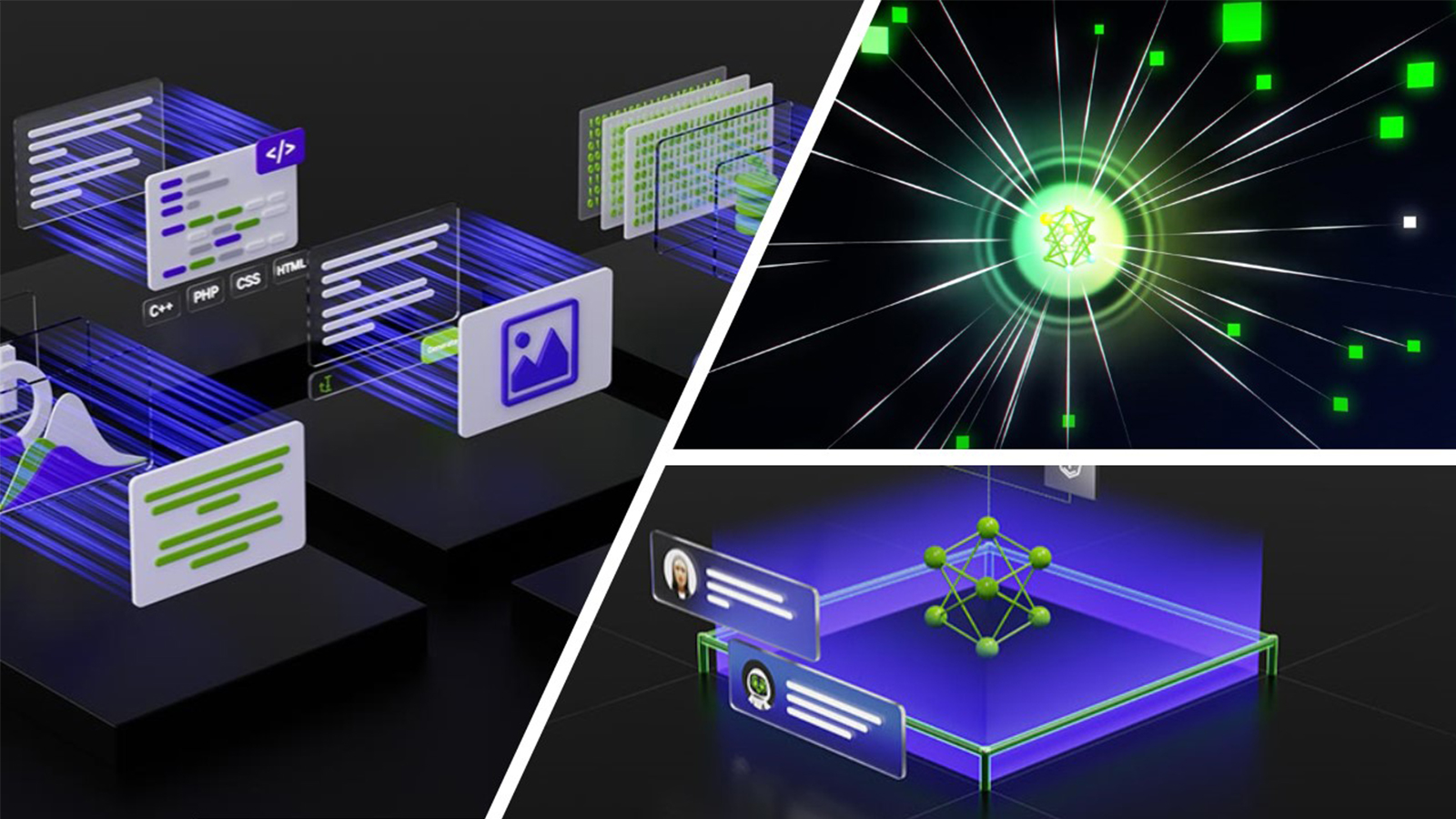

- 处理亿级参数模型时,可以参考大型语言模型、提示工程和 P-Tuning 的介绍。

- Wayve 等行业先驱正在利用人工智能超级计算机基础设施来实现计算密集型工作负载。

- 即将提供的支持机密计算可以在 Azure 上使用 NVIDIA H100 GPU,有助于保护敏感数据,保护正在使用的有价值的人工智能模型,实现人工智能的安全多方协作用例。

视频 1. 什么在运行 ChatGPT ?微软人工智能超级计算机内幕|马克·鲁西诺维奇

总结

当训练具有数千亿参数的人工智能模型时,高效的数据中心基础设施是关键:从提高吞吐量和最大限度地减少服务器故障,到利用多 GPU 集群进行计算密集型工作负载。

有关优化数据中心基础架构以可靠地大规模部署大型模型的更多信息,请参阅以下资源:

- NVIDIA AI platform:通过从计算到软件、人工智能模型和服务的全栈创新,使 AI 开发更容易。

- Modern Data Centers:了解 IT 领导者如何扩展和管理数据中心,以轻松实现 NVIDIA AI 的采用。

- H100 Tensor Core GPU:结合技术创新,LLM 比上一代性能提升了 30 倍。

- NVIDIA NeMo:可以帮助您的企业构建、自定义和部署 LLM,以增强生成式 AI应用程序。

- NVIDIA Quantum InfiniBand 平台