LLMs

2026 年 4 月 28 日

24 時間 365 日 のシミュレーション ループ: エージェント型 AI がサブサーフェス エンジニアリングを前進させる仕組み

繰り返し発生する技術的なハードルを、エージェント型 AI でオフロードすることで、より広範なソリューション空間を探索し、資産価値の向上を推進しましょう。

2 MIN READ

2026 年 3 月 17 日

Nemotron-Nano-9B-v2-Japanese の推論チュートリアル

NVIDIA DGX Spark、NVIDIA Jetson Thor、NVIDIA RTX PRO 6000 Blackwell 向けに Nemotron-Nano-9B-v2-Japanese をデプロイする実装例をご紹介します。

8 MIN READ

2026 年 3 月 16 日

NVIDIA OpenShell で自律的かつ自己進化するエージェントをより安全に実行

新しいオープンソース ランタイムにより、開発者はエンタープライズのプライバシーとセキュリティを維持しながら、claw の生産性を享受できます。

1 MIN READ

2026 年 3 月 11 日

Nemotron 3 Super の紹介: エージェント型推論向けのオープン ハイブリッド Mamba-Transformer MoE

Nemotron 3 Super は、高容量の推論モデルにおける典型的な効率と精度のトレードオフを軽減するアーキテクチャ革新を導入しています。

3 MIN READ

2025 年 12 月 15 日

NVIDIA Nemotron 3 の内部: 効率性と高精度を実現する手法、ツール、データ

新しいオープン モデル ファミリは、マルチエージェント システムにおける高速かつ長文コンテキスト推論向けに、オープンな Hybrid Mamba-Transformer MoE を導入します。

3 MIN READ

2025 年 11 月 18 日

NVIDIA テクノロジを活用した日本語医療音声エージェントの構築による臨床業務負担の軽減

日本の医療従事者がより多くの時間を患者に向き合えるようにする、音声 AI 技術を活用した音声対話エージェントの構築を NVIDIA のソリューションで加速しましょう。

5 MIN READ

2025 年 11 月 18 日

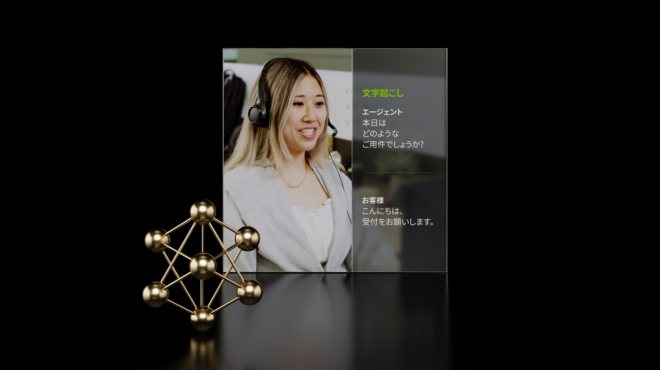

NVIDIA NIM と NVIDIA Blueprints で実現する日本語対応対話型エージェントの迅速な構築

NVIDIA NIM マイクロサービスと NVIDIA Blueprints を活用し、日本語環境に対応した Blueprints のカスタマイズを行うための実践的な手順を紹介します。

5 MIN READ

2025 年 11 月 3 日

NVIDIA AI Blueprints を活用した動画解析の新しいアプローチ

NVIDIA の動画検索および要約用 AI Blueprint (VSS: Video Search and Summarization) と RAG Blueprint を統合し、動画解析と要約を高度化する方法を紹介します。

4 MIN READ

2025 年 10 月 28 日

NVIDIA Nemotron の新しいモデル (Vision、RAG、ガードレール) で特化型 AI エージェントを開発

新しい Nemotron モデルを活用して、マルチモーダル エージェント、RAG パイプライン、コンテンツ安全性を備えた AI を構築する方法や、各モデルの特長、性能、チュートリアルを紹介します。

3 MIN READ

2025 年 10 月 24 日

LangGraph と NeMo Agent Toolkit ではじめる ReAct エージェント

AI エージェントの概念を簡潔に解説し、特に「ReAct (Reasoning and Acting) エージェント」に焦点を当てて、その仕組みと実装方法について詳しく説明します。

8 MIN READ

2025 年 9 月 25 日

NVIDIA NIM により Stockmark 100B 日本語フルスクラッチ LLM が 2.5 倍高速化

最適化コンテナーとして即時に API 化できる NIM は、大規模 LLM 導入時のさまざまな課題を解決します。NIM 対応した日本発の「Stockmark-2-100B-Instruct」を是非お試しください。業務利用に適した高精度な日本語 LLM がすぐに活用可能です。

1 MIN READ

2025 年 9 月 9 日

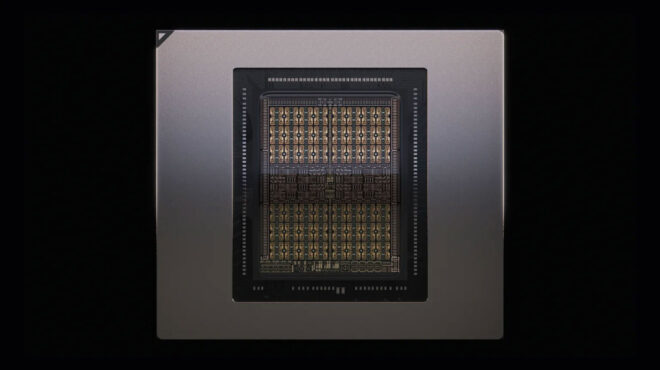

NVIDIA Rubin CPX により、トークン コンテキストが 100 万を超えるワークロードの推論性能と効率が向上

NVIDIA Blackwell や NVIDIA GB200 NVL72 などのプラットフォームと、低精度推論用の NVFP4 や NVIDIA TensorRT-LLM や NVIDIA Dynamo などのオープンソース ソフトウェアを組み合わせることで、AI 全体の推論性能を再定義します。

2 MIN READ

2025 年 8 月 29 日

NeMo Curator を使った日本語データのキュレーション - モデルベース編

NeMo Curator を使用したモデルベースのテキスト データの品質を簡単に向上するアプローチを、ステップバイステップでご紹介します。

4 MIN READ

2025 年 6 月 11 日

オープンソースの AI-Q NVIDIA Blueprint を通じてエンタープライズ データを用いてチャットする

社内ナレッジの活用を促進する AI-Q NVIDIA Blueprint の機能とコンポーネントについて、ユース ケースの例とともに説明します。

2 MIN READ

2025 年 4 月 18 日

Spotlight: DataStax Langflow で再現する NVIDIA AI Blueprints をマクニカの AI TRY NOW PROGRAM で検証可能に

環境構築や、プログラミングの工数を大幅に削減しつつ、効率良く AI エージェントを構築するソリューションをご紹介します。

2 MIN READ

2025 年 4 月 10 日

NVIDIA のフルスタック ソリューションで AI 推論のパフォーマンスを最適化

NVIDIA は、AI 推論の可能性を再定義し、これまで以上に高速で、効率的かつ拡張可能なソリューションを提供するために、フルスタックのイノベーションを通じて開発者を支援しています。

2 MIN READ