ジェネレーティブ AI は、AI 革命における重要なマイルストーンとなりました。AI は重大な転換点を迎えており、企業は単に新しい取り組みを開始しているだけでなく、難しい取り組みにも積極的に挑戦しているのです。

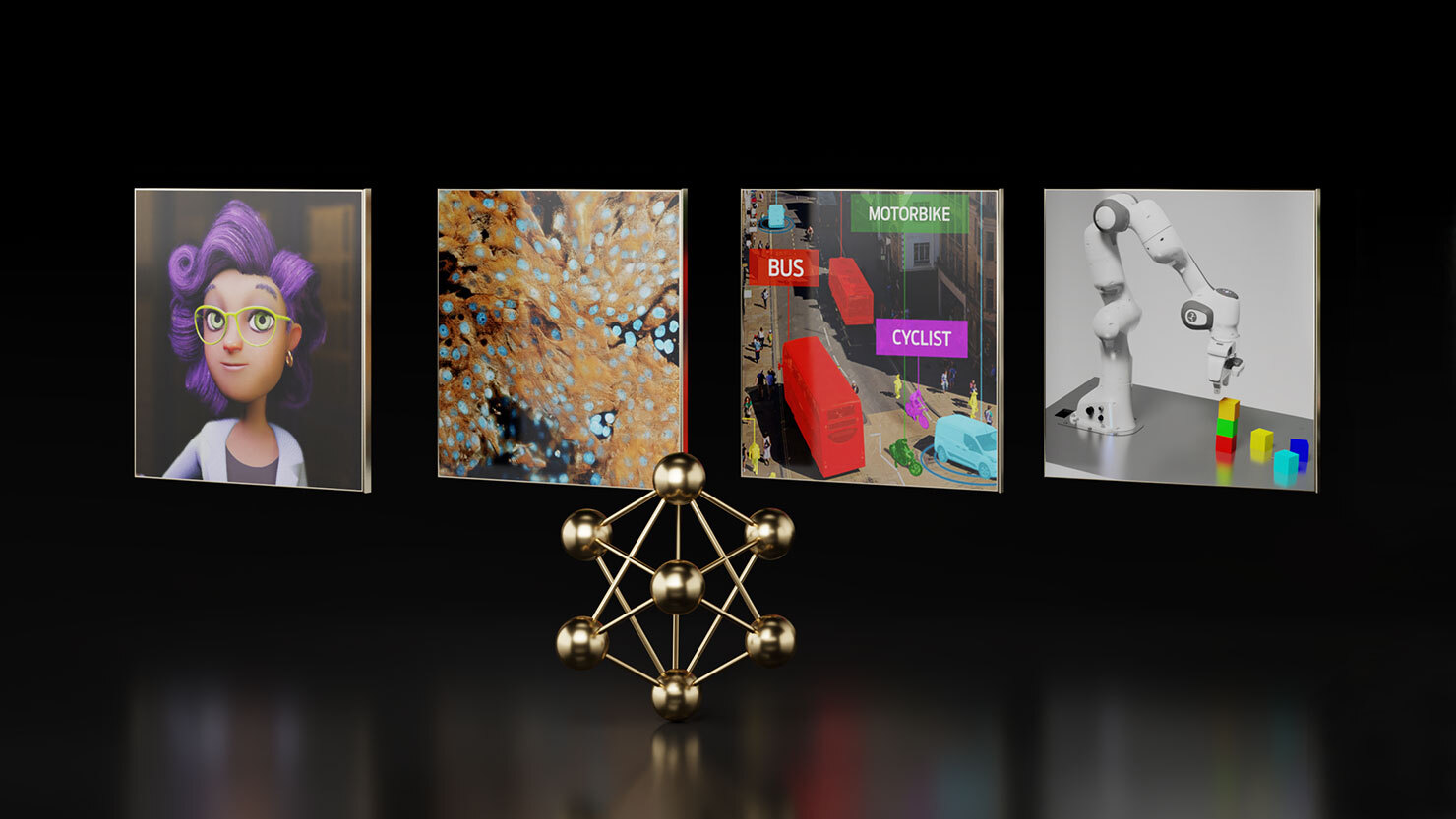

50 を超えるフレームワーク、事前学習済みモデル、開発ツールを備えた NVIDIA AI プラットフォームのソフトウェア である NVIDIA AI Enterprise は、企業が最先端 AI の利用を加速できるように設計されています。AI を簡素化し、すべての企業がAIを容易に利用できるようにすることを目的としています。

先日、AT&T Corp. と NVIDIA による協業が発表されました。今後 AT&T は、NVIDIA が提供する AI を活用しながら継続的に業務を変革し、サステナビリティの向上を進めていくことなります。その一例として、NVIDIA RAPIDS Accelerator for Apache Spark を含む NVIDIA AI Enterprise ソフトウェア スイートを使用したデータ処理の強化が挙げられます。

データ処理の高速化、AI Workflows、クラウドでの提供拡大

NVIDIA GTC 2023 で、オンプレミスでもクラウドでもより速やかに価値を実現できる NVIDIA AI Enterprise の最新バージョンを発表しました。今回のアップデートでは、以下の機能やツールなどが追加されています。

- RAPIDS Accelerator for Apache Spark

- パーソナライズされた商品レコメンデーションとルート最適化を実現する NVIDIA AI Workflows

- クラウドでの提供拡大

- 最新の NVIDIA Ada Lovelace アーキテクチャ GPU のサポート

RAPIDS Accelerator for Apache Spark でデータ処理を 5 倍高速化

データ処理は、大量のデータセットを処理して、AI モデルの学習や推論に必要な形式に変換するプロセスです。しかし、組織がますます大量データを蓄積するにつれて処理にかかるコストや時間も増大しています。

NVIDIA AI Enterprise 3.1 には RAPIDS Accelerator for Apache Spark が含まれており、データ サイエンティストやデータ エンジニアはコードを変更することなく、Apache Spark 3.x を最大 5 倍高速化し、CPU のみのプラットフォームと比較してインフラストラクチャ コストを最大 75% 節約できます。

Amazon EMR、Google Cloud Dataproc、Databricks on Azure、Databricks on AWS といった認定プラットフォームでのエンタープライズ グレードのサポートへのフル アクセスにより、Spark の展開におけるパフォーマンスを最適化できます。

新しい AI Workflows: 将来の商品予測とルート最適化

NVIDIA AI Workflows は、NVIDIA AI フレームワークを活用して AI ソリューションを構築する方法を示す、クラウドネイティブでパッケージ化されたリファレンス アプリケーションです。NVIDIA AI Enterprise 3.1 では 2 つの新しい AI Workflows を利用できます。

- 将来の商品予測 NVIDIA AI Workflow: レコメンダー パイプラインを構築し、顧客維持とアップセルを促進できます。

- ルート最適化 NVIDIA AI Workflow: 動的な制約条件に基づき、物流や配送車両を最適化し、コストと時間を削減できます。

これらのリファレンス アプリケーションによって、AI を活用したリコメンデーションやルート最適化ソリューションを素早く構築し、ビジネス目標を達成するための道筋を示します。

クラウド マーケットプレイスで NVIDIA AI Enterprise の提供を開始

クラウド上で NVIDIA AI ソフトウェアをより活用しやすくするために、Google Cloud Marketplace で NVIDIA AI Enterprise の提供を開始しました。また、AWS Marketplace や Microsoft Azure Marketplace でも近日中に提供を開始する予定です。

オンデマンドですぐに始めることも、合意済みのクラウド支出契約を使用して、フルスタックのソフトウェア スイートを数分以内で利用することもできます。NVIDIA AI Enterprise には、NVIDIA が提供するエンタープライズ グレードのサポート、データ サイエンス パイプラインや AI アプリケーションを構築するための AI フレームワークとツールが含まれています。

また、ライセンスをお持ちの場合は、ご自身のライセンスを利用して、Google Cloud、AWS、Azure、Oracle Cloud 上の認定されたクラウドインスタンスを購入して稼働させることも可能です。

CSP コンテナー オーケストレーション サービスによる Kubernetes の自動化

NVIDIA AI Enterprise 3.1 は、Amazon Elastic Kubernetes Service (Amazon EKS) や Google Kubernetes Engine (GKE) 含む Kubernetes コンテナー ホスティング環境をサポートしています。

GPU 付きインスタンスを使用することで、完全にサポートされ最適化された AI ソフトウェア スタックとシンプルな展開を利用して、分散した AI ジョブをクラウドで効率的に実行できます。

最新の GPU アーキテクチャによる高速化、ハイブリッド クラウド インフラストラクチャの拡張

最新バージョンの NVIDIA AI Enterprise は、コンピューティング集約型の AI および推論ワークロードを強化する以下の NVIDIA Ada Lovelace アーキテクチャ GPU にも対応しています。

- NVIDIA L4

- NVIDIA L40

- NVIDIA RTX 6000 Ada 世代

NVIDIA LaunchPad で、NVIDIA L4 GPU 上での NVIDIA AI Enterprise を体験できます。

今回のリリースによるハイブリッド クラウド インフラストラクチャの拡張により、混合ワークロード向けの異種プロファイル タイプのサポート と ClearML による MLOps 認定が提供されます。

Update 1 リリースでは VMware vSphere 8 が認定、サポートされ、NVIDIA NVSwitch の展開が可能になりました。

NVIDIA AI Enterprise を利用してみよう

NVIDIA LaunchPad に登録すると、一連のハンズオン ラボを含むプライベートなアクセラレーテッド コンピューティング環境で NVIDIA AI Enterprise のソフトウェア スイートを体験できる短期間アクセスを取得できます。商品のレコメンデーション、ルート最適化、スピーチ AI、サイバーセキュリティなどに対応する NVIDIA AI Workflows をぜひご体験ください。

GTC 2023 のセッションの視聴

パネル ディスカッション、『A Practical Guide to AI: Moving from Pilot to Production (AI の実践ガイド: パイロットから本番環境への移行)』を視聴して、NVIDIA、Carilion Clinic、ControlExpert からベスト プラクティスについて学び、AI 導入における一般的な課題を解決してください。

NVIDIA 専門家がレコメンデーション モデルやルート最適化について語る AI ワークフローのセッションもぜひチェックしてください。

翻訳に関する免責事項

この記事は、「Catapulting Enterprises to the Leading Edge of AI with NVIDIA AI Enterprise 3.1」の抄訳で、お客様の利便性のために機械翻訳によって翻訳されたものです。NVIDIA では、翻訳の正確さを期すために注意を払っておりますが、翻訳の正確性については保証いたしません。翻訳された記事の内容の正確性に関して疑問が生じた場合は、原典である英語の記事を参照してください。