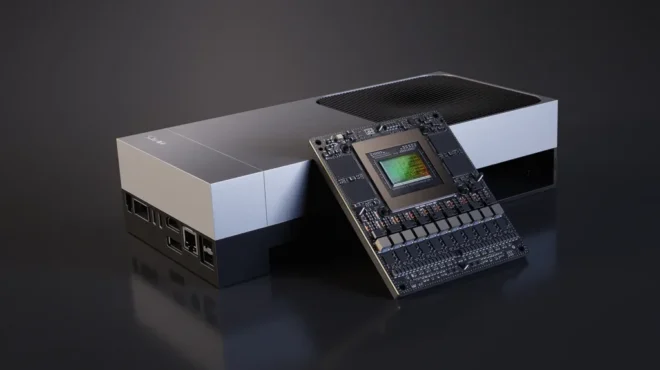

作为 NVIDIA Blackwell 架构系列的最新成员,NVIDIA Blackwell Ultra GPU 依托核心创新,显著加速 AI 训练与推理。它将先进的芯片设计与更高水平的系统级集成相融合,为 AI 工厂及其支撑的大规模实时 AI 服务,提供更卓越的性能、可扩展性和能效。

凭借其节能的双光栅设计、高带宽大容量的 HBM3E 显存子系统、第五代 Tensor Core 以及突破性的 NVFP4 精度格式,Blackwell Ultra 正在重新定义加速计算的新标准。本文深度解析了该架构的技术进步及其重要意义,并阐述了这些创新如何为 AI 工作负载带来可量化的性能提升。

双光栅设计:一个 GPU

Blackwell Ultra 由两个晶片级模块组成,通过 NVIDIA 高带宽接口(NV-HBI)连接。NV-HBI 是一种定制的、节能的模块间互连技术,可提供高达 10 TB/s 的带宽。该架构采用 TSMC 4NP 工艺制造,集成 2080 亿个晶体管,是 NVIDIA Hopper GPU 的 2.6 倍。尽管规模更大,Blackwell Ultra 仍作为一个单一的 NVIDIA CUDA 编程加速器运行,不仅显著提升了性能,还延续了开发者近二十年来所熟悉的 CUDA 编程模型。

优势:

- 统一计算域:两个模组共集成 160 个流处理器(SM),配备 640 个第五代 Tensor Core,可提供高达 15 PetaFLOPS 的密集型 NVFP4 计算性能。

- 完全一致性:共享 L2 缓存,实现完全一致的内存访问。

- 最大硅片利用率:实现每平方毫米的峰值性能。

流式多处理器:AI 工厂的计算引擎

如图1所示,Blackwell Ultra的核心由160个流处理器(SM)组成,在完整的GPU实现中,这些流处理器被组织为八个图形处理集群(GPC)。如图2所示,每个SM都是一个独立的计算引擎,包含:

- 128 个 CUDA 核心,支持 FP32 和 INT32 操作,以及 FP16、BF16 等多种精度运算。

- 4 个第五代 Tensor Core,搭载 NVIDIA 第二代 Transformer 引擎,针对 FP8、FP6 和 NVFP4 精度进行了优化。

- 配备 256 KB Tensor Memory (TMEM),可对中间结果进行 warp 级同步存储,提升数据重用率,减少片外内存访问流量。

- 集成专用的特殊功能单元 (SFU),用于 AI 核心中的超越函数数学运算及特殊操作。

NVIDIA Tensor Core,AI 计算强劲引擎

NVIDIA 在 Volta 架构中首次引入了 Tensor Core,彻底改变了 GPU 在深度学习领域的计算能力。Tensor Core 不再局限于逐个执行标量或向量运算,而是能够直接对小矩阵进行操作,通过单条指令完成矩阵乘积累加(MMA)运算。这一设计高度契合神经网络的计算特性,因为神经网络中的绝大部分计算本质上都涉及对大规模数值网格的乘法与求和操作。

Tensor Core 的功能、精度格式以及并行性在连续几代产品中不断得到扩展。

- NVIDIA Volta: 配备8线程MMA单元,支持用于训练的FP16和FP32累加。

- NVIDIA Ampere: 支持全warp范围的MMA运算,引入BF16和TensorFloat-32格式。

- NVIDIA Hopper:采用128线程的Warp组MMA架构,配备支持FP8的Transformer引擎。

Blackwell 和 Blackwell Ultra 采用第五代 Tensor Core 与第二代 Transformer 引擎,将性能提升至全新高度,为密集型和稀疏型 AI 工作负载提供更高的吞吐量与更低的延迟。在 Blackwell Ultra 中,其 160 个 SM 每个均配备四个 Tensor Core,共计 640 个 Tensor Core,现已升级支持 NVFP4 精度格式,以更好地应对最新的计算需求。

这些增强功能远不止于提升 FLOPS。全新的 Tensor Core 与每个 SM 配备的 256 KB Tensor 内存(TMEM)紧密集成,经过优化,可将数据置于计算单元附近,从而提升效率。此外,它们还支持双线程块 MMA,使成对的 SM 能在单个 MMA 操作中协同工作,共享操作数并减少冗余的内存流量。

其结果是持续吞吐量更高、内存效率更优,以及在批量预训练、后训练的强化学习和低批量高交互性推理方面速度更快。

超强 NVFP4 性能

Blackwell GPU 架构引入了全新的 4 位浮点格式 NVIDIA NVFP4,该格式结合了双级缩放机制:针对 16 元素块的 FP8(E4M3)微块缩放和张量级 FP32 缩放,从而实现硬件加速的量化,其误差率显著低于标准 FP4。与 FP8 相比,这一 Tensor Core 功能在精度上接近 FP8(通常差异小于 1%),同时将内存占用减少约 1.8 倍;相较于 FP16,内存占用最多可减少约 3.5 倍。NVFP4 在低精度 AI 推理的准确性、效率与性能之间实现了最佳平衡。

与原始的 Blackwell GPU 相比,Blackwell Ultra 在 NVFP4 计算能力方面实现了显著的性能提升。如图 3 所示,基础架构可提供 10 petaFLOPS 的 NVFP4 性能,而 Blackwell Ultra 可将该性能提升至 15 petaFLOPS,较原始 Blackwell GPU 提升 1.5 倍,较 NVIDIA Hopper H100 和 H200 GPU 提升高达 7.5 倍。这一性能提升显著增强了大规模推理能力,支持更多的并发模型实例,实现更快的响应速度,并有效降低每个 token 的生成成本。

注意力层的加速 softmax 层

现代 AI 工作负载在很大程度上依赖于注意力机制,通过长输入上下文和长输出序列来实现“思考”过程。Transformer 中的注意力层则进一步突显了 SM 的 SFU 在执行指数、除法及其他超越运算方面的重要性。

在 Blackwell Ultra 中,用于注意力机制的关键指令的 SFU 吞吐量相比 Blackwell GPU 提升了一倍,使得注意力层的计算速度最高可加快 2x 速度。这一改进不仅加速了短序列和长序列的注意力计算,尤其对具有大上下文窗口的推理模型影响显著,因为在这些模型中,softmax 阶段往往可能成为延迟瓶颈。

通过加速 Transformer 模型中的注意力机制,Blackwell Ultra 能够实现:

- 在交互式应用中,加速 AI 推理过程,缩短首次标记时间,

- 减少每次查询的总处理周期,从而降低计算成本,

- 提升系统效率:每瓦特可处理更多的注意力序列。

如图4所示,Blackwell Ultra通过将加速的注意力层指令与NVFP4精度相结合,显著提升了性能,从而为大语言模型(LLM)和多模态推理带来了阶跃式改进。

内存:为数万亿参数模型提供高容量和高带宽支持

Blackwell Ultra 不仅提升了计算能力,还大幅扩展了内存容量,以满足大型 AI 模型的需求。每块 GPU 配备 288 GB 的 HBM3e 内存,其封装内存容量是 H100 的 3.6 倍,比 Blackwell 也高出 50%,如图 5 所示。这一内存容量对于支持万亿参数模型、在不卸载 KV 缓存的情况下扩展上下文长度,以及在 AI 工厂中实现高并发推理至关重要。

高带宽显存功能

- 最大容量: 288 GB,较 H100 提升 3.6 倍

- HBM 配置: 8 堆栈,配备 16 个 512 位控制器,总宽度达 8192 位

- 带宽: 单 GPU 达 8 TB/s,相较 H100 的 3.35 TB/s 提升 2.4 倍

这种巨大的内存占用量能够实现:

- 完整模型驻留:支持 300B+ 参数的模型,无需内存卸载。

- 扩展上下文长度:为 Transformer 模型提供更大的 KV 缓存容量。

- 计算效率提升:优化各类工作负载的计算与内存比率。

互连:专为大规模构建而设计

Blackwell 和 Blackwell Ultra 支持第五代 NVIDIA NVLink,可通过 NVLink Switch 实现 GPU 间的高速通信,支持 NVLink-C2C 以实现与 NVIDIA Grace CPU 的一致性互连,同时配备 x16 PCI-Express Gen 6 接口,用于连接主机 CPU。

NVLink 5 规格说明

- 每块 GPU 带宽:1.8 TB/s 双向(18 路链路 × 100 GB/s)

- 性能扩展:相较 NVLink 4(Hopper GPU)提升 2 倍

- 最大拓扑:支持非阻塞计算网络中的 576 个 GPU

- 机架级集成:采用 72-GPU NVL72 配置,总带宽达 130 TB/s

主机连接:

- PCIe 接口: 支持 Gen6 ×16 通道,双向带宽达 256 GB/s

- NVLink-C2C: 实现 Grace CPU 与 GPU 间的内存一致性通信,带宽高达 900 GB/s

表 1 对不同世代的互连进行了比较。

| 互连 | Hopper GPU | Blackwell GPU | Blackwell Ultra GPU |

|---|---|---|---|

| NVLink (GPU-GPU) | 900 | 1,800 | 1,800 |

| NVLink-C2C (CPU-GPU) | 900 | 900 | 900 |

| PCIe 接口 | 128 (Gen 5) | 256 (Gen 6) | 256 (Gen 6) |

提升性能效率

Blackwell Ultra 在不牺牲效率的前提下,将 NVFP4 计算能力提升了 50%,HBM 容量也增加了 50%,从而支持更大的模型和更高的吞吐量,相较 Blackwell 实现了更为显著的飞跃。通过加速 softmax 执行,实际推理速度得到进一步提升,不仅提高了每位用户的每秒令牌数(TPS/user),也提升了数据中心每兆瓦的每秒令牌数(TPS/MW)。每一项架构增强均经过精心设计,旨在将用户体验与运营效率提升至全新水平。

如图6所示,通过绘制NVIDIA Hopper HGX H100 NVL8系统、NVIDIA Blackwell HGX B200 NVL8系统、NVIDIA Blackwell GB200 NVL72系统以及NVIDIA Blackwell Ultra GB300 NVL72系统的这两个指标可以看出,这些系统实现了显著的代际飞跃。曲线从Hopper NVL8的FP8精度开始,到Blackwell Ultra NVL72的NVFP4精度结束,清晰地展示了每一项架构改进如何推动帕累托前沿不断向上和向右移动。

这些架构创新提升了 AI 推理的经济性,重新定义了 AI 工厂设计中的可能性,相比之前的 NVIDIA 平台,能够提供更多的模型实例、更快的响应速度以及更高的每兆瓦输出。

要亲身体验硬件与部署配置方面的创新如何影响数据中心的效率和用户体验,请访问我们的交互式 Pareto Frontier 解释器。

企业级功能

Blackwell Ultra 不仅性能卓越,还具备企业级功能,可简化操作流程、增强安全性,并实现大规模稳定可靠的性能表现。

高级调度和管理功能

- 增强型 GigaThread 引擎: 采用新一代工作调度程序,可显著提升上下文切换性能,并优化全部 160 个 SM 的工作负载分配。

- 多实例 GPU (MIG): Blackwell Ultra GPU 支持划分为多个不同规模的 MIG 实例。例如,管理员可创建两个各拥有 140 GB 显存的实例、四个各拥有 70 GB 显存的实例,或七个各拥有 34 GB 显存的实例,从而实现具备可预测性能隔离的安全多租户环境。

安全性和可靠性

- 机密计算与安全 AI: 为敏感的 AI 模型和数据提供安全且高性能的保护,通过将基于硬件的可信执行环境(TEE)扩展至 GPU,并在 Blackwell 架构中引入业界首创的 TEE-I/O 功能,实现高效防护。NVLink 内联保护在提供数据加密的同时,性能几乎与未加密模式相当,确保高吞吐量。

- 高级 NVIDIA Remote Attestation Service (RAS) 引擎:一种由 AI 驱动的可靠性系统,可实时监控数千个参数,预测潜在故障,优化维护计划,从而最大限度延长大规模部署中的系统正常运行时间。

AI 视频和数据处理增强功能

Blackwell Ultra 还集成了专为需要多模态数据处理的现代 AI 工作负载而设计的引擎:

- 视频和 JPEG 解码: NVIDIA 视频解码器(NVDEC)和 NVIDIA JPEG 解码器(NVJPEG)是专用于高吞吐量图像与视频处理的固定功能硬件单元。

- NVDEC 支持 AV1、HEVC 和 H.264 等现代视频编解码器,无需占用 CUDA 核心,即可在 GPU 上直接实现批量或实时视频解码。

- NVJPEG 则通过硬件加速 JPEG 图像的解压缩过程,显著提升大规模图像处理流水线的性能。

- 两项硬件能力均被 NVIDIA DALI(数据加载库)充分利用,并无缝集成到 AI 训练与推理工作流中,广泛应用于图像增强、数据集预处理以及多模态模型输入准备等任务。

- 解压缩引擎: 该引擎提供硬件加速的数据解压缩功能,吞吐量高达 800 GB/s,有效降低 CPU 开销,加快压缩数据集的加载速度,满足高性能分析工作负载的需求。NVIDIA nvCOMP 为解压缩引擎提供了可移植的编程接口,便于开发者高效利用硬件能力。

NVIDIA GPU 芯片概要比较

为了让您直观了解 Blackwell Ultra 的优势,表 2 对比了 Hopper、Blackwell 和 Blackwell Ultra 的主要芯片规格。该对比清晰展现了晶体管数量、显存容量、互连带宽和精度计算吞吐量的代际提升,以及注意力加速和 NVFP4 等架构增强功能。通过这一并列视图,可以清楚看出 Blackwell Ultra 如何在节点和机架层面实现性能扩展,并增强对 AI 工厂部署至关重要的各项能力。

| 特性 | Hopper | Blackwell | Blackwell Ultra |

|---|---|---|---|

| 制造工艺 | TSMC 4N | TSMC 4NP | TSMC 4NP |

| 晶体管数量 | 800 亿 | 2080 亿 | 2080 亿 |

| 每个 GPU 的模具 | 122 NVFP4 | 稀疏性能 – 10 | 20 PetaFLOPS | 15 | 20 PetaFLOPS |

| FP8 稠密型 | 稀疏性能 | 2 | 4 PetaFLOPS | 5 | 10 PetaFLOPS | 5 | 10 PetaFLOPS |

| 注意力加速 (SFU EX2) | 4.5 TeraExponentials/s | 5 TeraExponentials/s | 10.7 TeraExponentials/s |

| 最大 HBM 容量 | 80 GB HBM (H100) 141 GB HBM3E (H200) |

192 GB HBM3E | 288 GB HBM3E |

| 最大 HBM 带宽 | 3.35 TB/s (H100) 4.8 TB/s (H200) |

8 TB/s | 8 TB/s |

| NVLink 带宽 | 900 GB/s | 1,800 GB/s | 1,800 GB/s |

| 最大功耗 (TGP) | 高达 700W | 高达 1,200W | 高达 1,400W |

从芯片到 AI 工厂

Blackwell Ultra GPU 是 NVIDIA 新一代 AI 基础设施的核心支柱,可为桌面超级芯片及全 AI 工厂机架提供突破性的性能。

NVIDIA Grace Blackwell 超级芯片

这款超级芯片通过 NVLink-C2C 技术将一颗 Grace CPU 与两颗 Blackwell Ultra GPU 相连接,可提供高达 30 PFLOPS 的密集型和 40 PFLOPS 的稀疏型 NVFP4 AI 计算性能。芯片配备 1 TB 统一内存,融合了 HBM3E 与 LPDDR5X 技术,实现了前所未有的节点内存容量。同时,搭载的 ConnectX-8 SuperNIC 提供高达 800 GB/s 的高速网络连接(见图 7)。NVIDIA Grace Blackwell 超级芯片是 GB300 NVL 72 机架级系统的核心计算单元。

- NVIDIA GB300 NVL72 机架级系统:该液冷机架集成了 36 个 Grace Blackwell 超级芯片,通过 NVLink 5 和 NVLink 交换机实现高速互连,可提供高达 1.1 exaFLOPS 的密集型 FP4 计算性能。相比 Hopper 平台,GB300 NVL72 的 AI 工厂输出能力提升达 50 倍,用户延迟(每用户 TPS)改善 10 倍,每兆瓦吞吐量提高 5 倍。GB300 系统还重新定义了机架级电源管理,采用多种电源架配置以应对 GPU 负载的同步爬升。NVIDIA 的电源平滑技术创新(包括能量存储与功耗调节机制)有效稳定了整个训练工作负载的功耗表现。

- NVIDIA HGX 与 DGX B300 系统:采用标准化的 8 GPU Blackwell Ultra 配置。NVIDIA HGX B300 与 NVIDIA DGX GB300 系统延续了对 AI 基础设施灵活部署的支持,同时保持完整的 CUDA 与 NVLink 兼容性。

完全兼容 CUDA

Blackwell Ultra 在保持与整个 CUDA 生态系统完全向后兼容的同时,还针对新一代 AI 框架引入了多项优化。

- 框架集成: 原生支持在 SGLang、TensorRT-LLM 和 vLLM,配备针对 NVFP4 精度和双模组架构优化的专用内核。

- NVIDIA Dynamo: 一个分布式推理与调度框架,可智能编排数千个 GPU 上的工作负载,在大规模部署中实现高达 30 倍 吞吐量提升。

- NVIDIA Enterprise AI: 一个端到端的云原生 AI 软件平台,提供经过优化的框架、SDK、微服务及企业级工具,支持 AI 工作负载的大规模开发、部署与管理。

- NVIDIA 开发工具与 CUDA 库:

- CUTLASS:用于自定义内核开发

- Nsight Systems 与 Nsight Compute:用于性能分析与调优

- Model Optimizer:支持精度感知的图优化工具

- cuDNN:用于深度学习原语的加速库

- NCCL:用于多 GPU 通信的优化库

- CUDA Graph:用于降低内核启动开销

底线思考

NVIDIA Blackwell Ultra 为 AI 工厂奠定了坚实基础,使其能够以空前的规模和效率进行智能的训练与部署。凭借双模组集成、NVFP4 加速、大容量内存以及先进互连技术等突破性创新,Blackwell Ultra 让以往在计算上无法实现的 AI 应用成为可能。

随着行业从 AI 概念验证迈向生产级 AI 工厂,Blackwell Ultra 以无与伦比的性能、效率和规模,提供了实现 AI 愿景的计算基础。

了解更多信息

深入了解推动万亿美元级 Token 时代的创新力量。下载 Blackwell 架构技术简介,全面探索从芯片到系统的完整演进历程。

致谢

感谢 Manas Mandal、Ronny Krashinsky、Vishal Mehta、Greg Palmer、Michael Andersch、Eduardo Alvarez、Ashraf Eassa、Joe DeLaere 以及众多其他 NVIDIA GPU 架构师、工程师和产品负责人对本文的贡献。