Posts by 薛博阳

加速计算

2024年 4月 25日

NVIDIA GPU 架构下的 FP8 训练与推理

本文聚焦 NVIDIA FP8 训练与推理的实践应用,该内容来源于 2023 云栖大会 NVIDIA 专场演讲。 FP8 训练利用 E5M2/

5 MIN READ

生成式人工智能/大语言模型

2024年 3月 19日

FP8:前沿精度与性能的新篇章

在深度学习和人工智能的快速发展背景下,尤其是大语言模型(Large Language Model, LLM)的蓬勃发展,

3 MIN READ

计算机视觉/视频分析

2022年 9月 8日

全栈创新为 NVIDIA 最高 MLPerf 推断 2.1 结果提供燃料

如今,人工智能驱动的应用程序正在实现更丰富的体验,这是由更大和更复杂的人工智能模型以及许多模型在管道中的应用所推动的。

4 MIN READ

对话式人工智能/自然语言处理

2022年 8月 3日

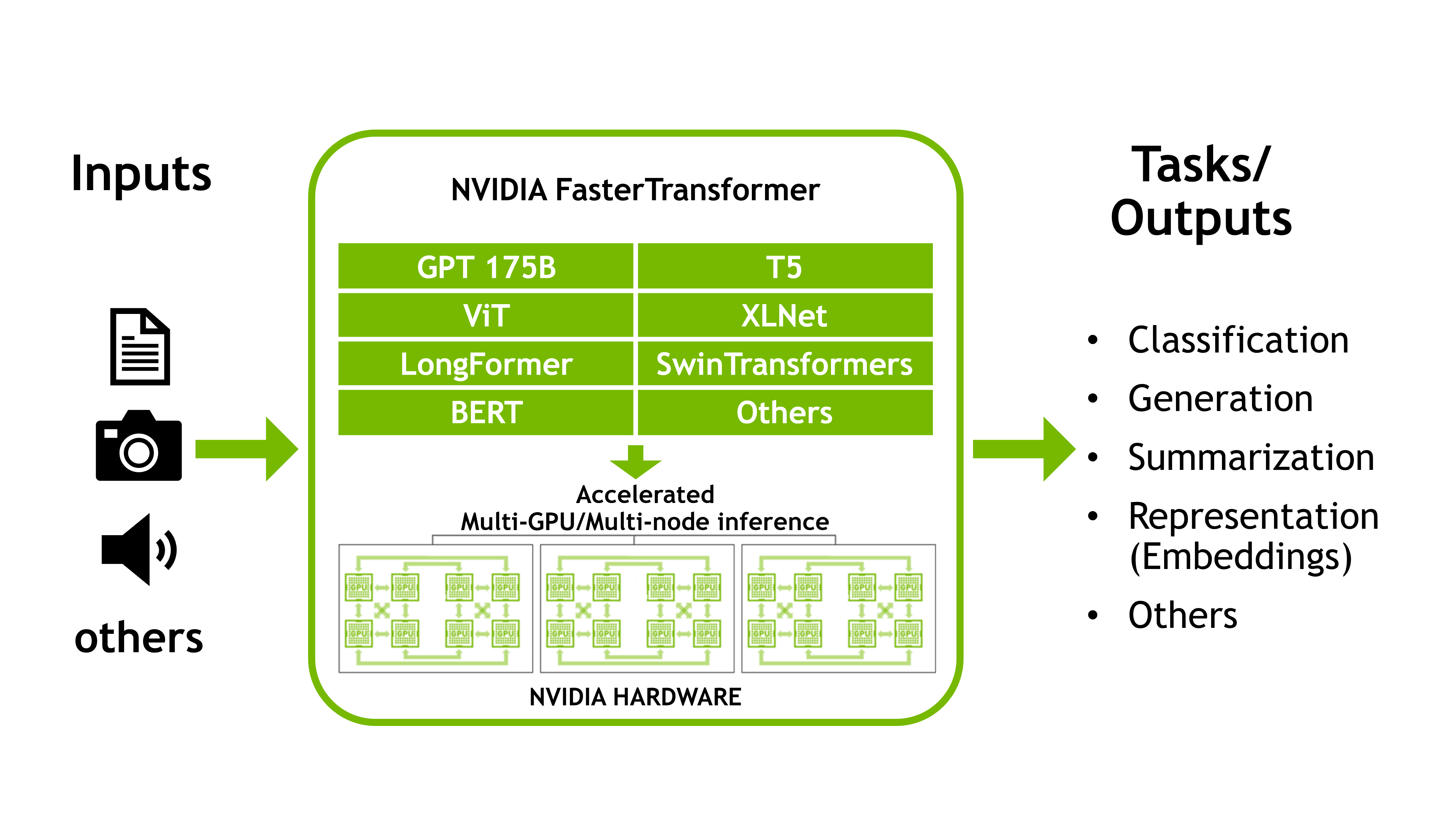

使用 FasterTransformer 和 Triton 推理服务器加速大型 Transformer 模型的推理

这是讨论 NVIDIA FasterTransformer 库的两部分系列的第一部分,

3 MIN READ

对话式人工智能/自然语言处理

2022年 8月 3日

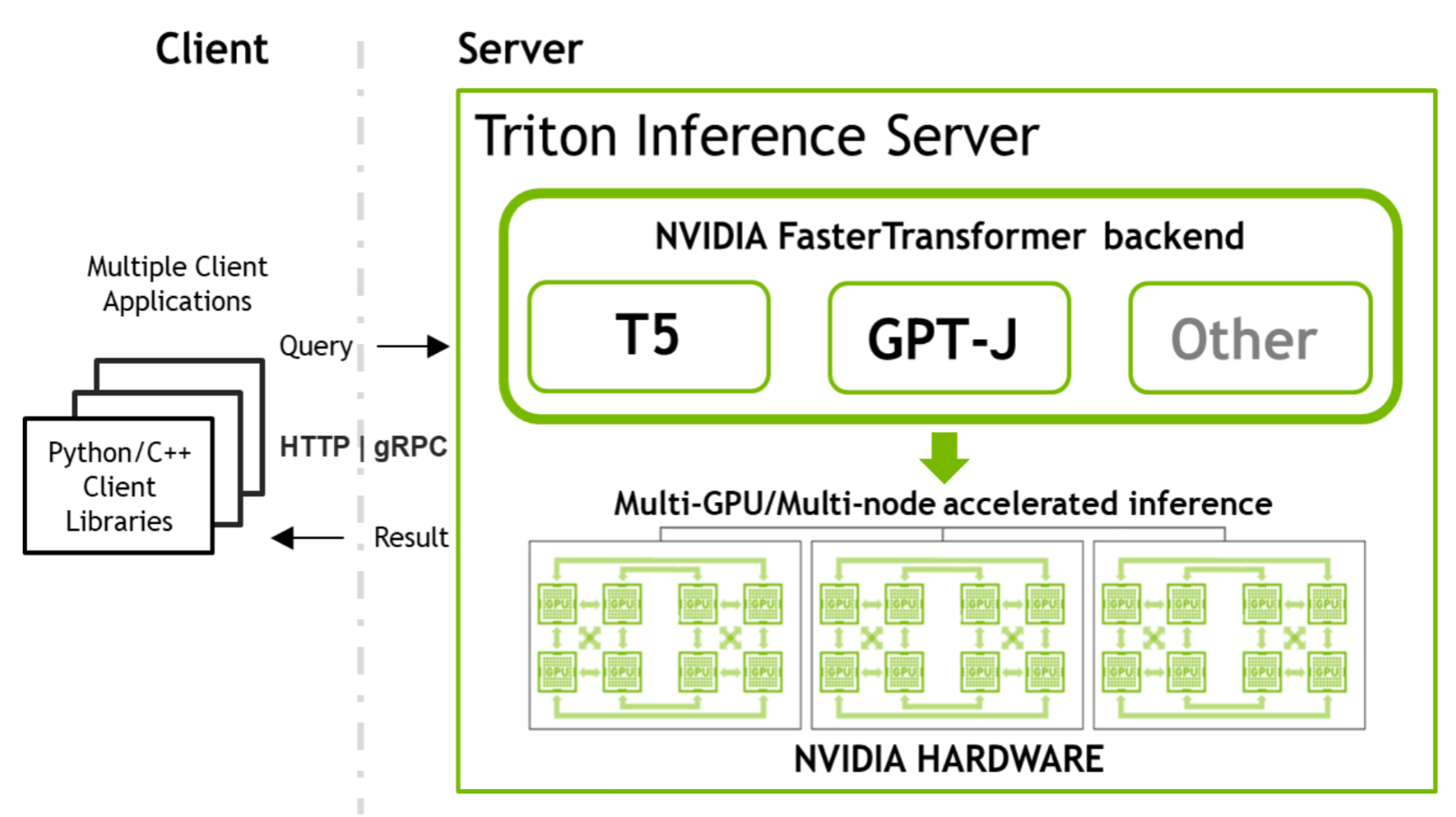

使用 FasterTransformer 和 Triton 推理服务器部署 GPT-J 和 T5

这是关于 NVIDIA 工具的两部分系列的第二部分,这些工具允许您运行大型Transformer模型以加速推理。

5 MIN READ