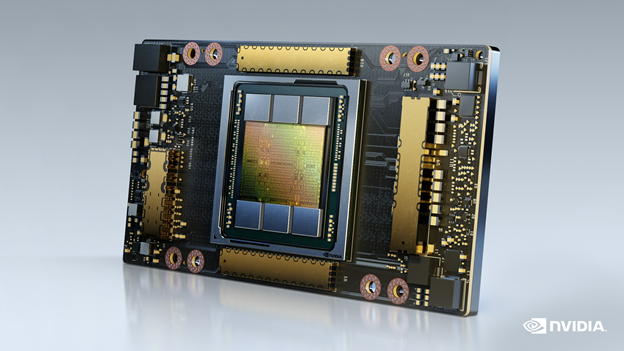

A100

2024년 11월 8일

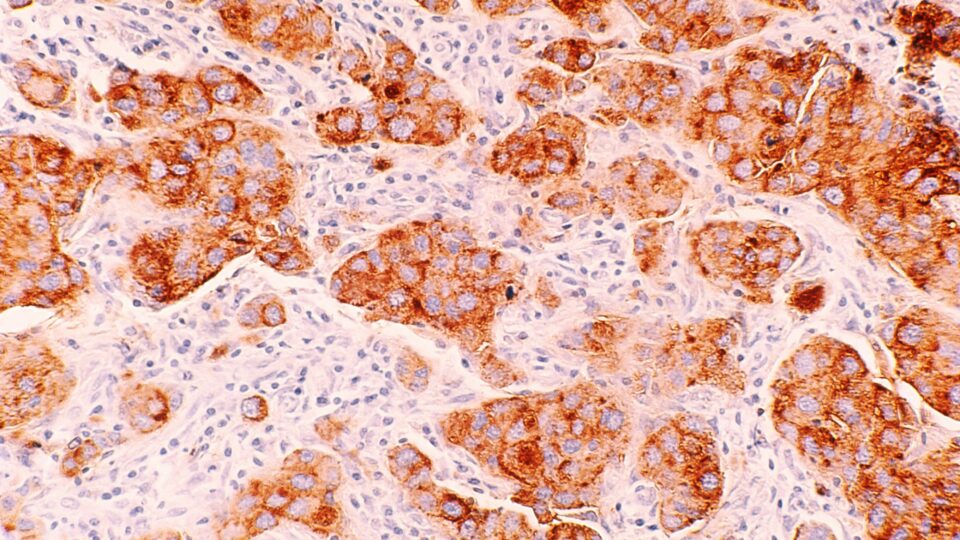

수술 없이 유방암 확산을 식별하는 딥러닝 AI 모델

새로운 딥러닝 모델은 암세포가 인근 림프절을 포함해 전이 여부를 진단할 때 수술의 필요성을 줄일 수 있습니다.

3 MIN READ

2024년 11월 1일

늑대를 구하기 위해 울부짖는 소리를 추적하는 AI 기반 디바이스

광활한 외딴 지역에 설치할 수 있는 휴대폰 크기의 새로운 기기는 AI를 사용하여 야생동물을 식별하고 지리적 위치를 파악하여 옐로스톤 국립공원 주변의…

3 MIN READ

2024년 5월 17일

NVIDIA TensorRT Model Optimizer로 생성형 AI 추론 성능 가속화

빠르게 진화하는 생성형 AI 환경에서 가속화된 추론 속도에 대한 요구는 여전히 시급한 문제입니다. 모델 크기와 복잡성이 기하급수적으로 증가함에 따라…

6 MIN READ

2024년 3월 15일

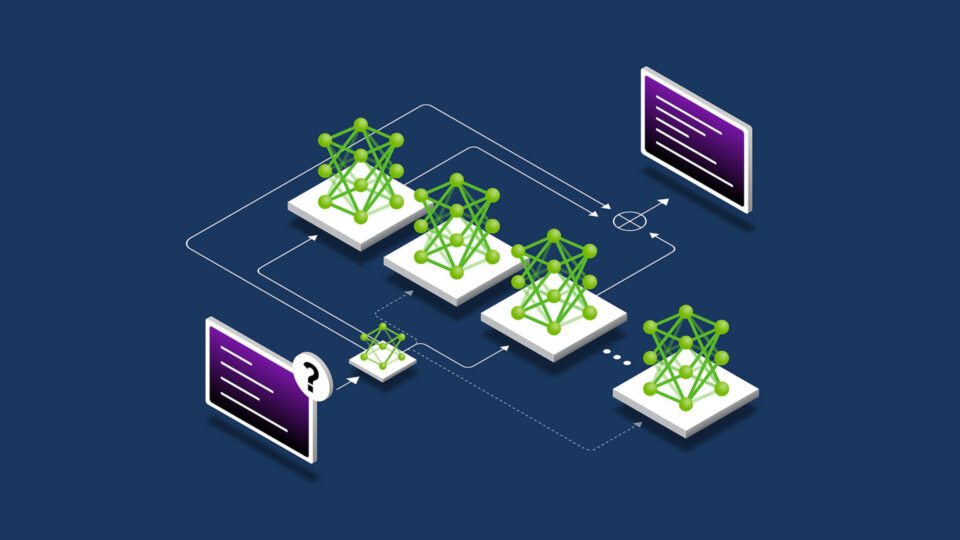

LLM 아키텍처에 Mixture of Experts(MoE)를 활용하기

Mixture of Experts(MoE) 거대 언어 모델(LLM) 아키텍처는 최근 GPT-4와 같은 독점 LLM은 물론 Mixtral 8x7B의…

7 MIN READ

2023년 7월 12일

맞춤형 언어 모델을 생성하는 방법

대규모 언어 모델은 강력하고 다재다능하지만 제로 샷 및 소수 샷 프롬프트 기법으로는 그 힘을 충분히 활용하지 못할 수 있습니다. 매개변수 효율적인 사용자 지정 기법이 해결책을 제시합니다.

8 MIN READ

2023년 6월 7일

NVIDIA DGX GH200 발표: 최초의 100테라바이트 GPU 메모리 시스템

COMPUTEX 2023에서 NVIDIA는 가장 까다로운 대규모 AI 워크로드를 지원하는 GPU 가속 컴퓨팅 분야의 또 다른 혁신인 NVIDIA…

4 MIN READ

2022년 6월 24일

풀 스택 혁신으로 고성능 컴퓨팅 지원

고성능 컴퓨팅(HPC)은 과학적 발견의 필수적인 수단이 되었습니다. 신약을 발견하든, 기후 변화에 맞서 싸우든, 정확한 세계 시뮬레이션을 만들든…

5 MIN READ