Data Center / Cloud / Edge

2026 年 2 月 6 日

NVFP4 が AI のトレーニングと推論を加速する 3 つの方法

NVIDIA による徹底的な共同設計によって、モデルのトレーニングと推論の両方において、優れた精度で大幅なパフォーマンスの向上が達成が見込めるようになりました。

2 MIN READ

2026 年 1 月 6 日

NVIDIA Spectrum-X イーサネット フォトニクス による電力効率に優れた AI ファクトリーの拡張

AI ファクトリーのために開発された、電力効率に優れ、信頼性、回復力に優れたコパッケージド オプティカル ネットワークを実現する Spectrum-X イーサネット フォトニクスのプロトコルとハードウェアにおける主要な最適化と革新について探ります。

2 MIN READ

2026 年 1 月 5 日

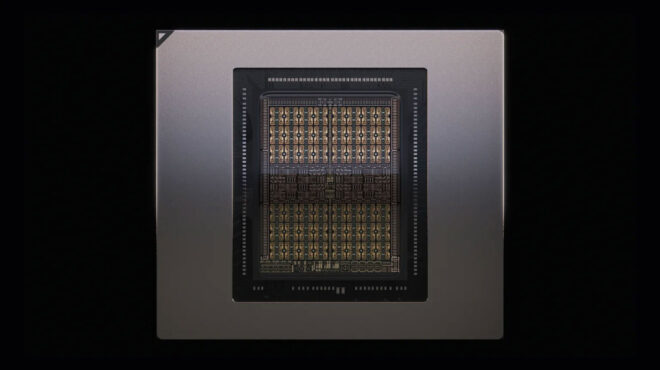

NVIDIA Rubin プラットフォームの内部: 6 つの新チップと AI スーパーコンピューター

AI は産業化段階に移行しています。 個別の AI モデルのトレーニングや人と直接対話する推論を実行するシステムとして始まった AI は、

13 MIN READ

2025 年 11 月 10 日

NVIDIA Grove で Kubernetes 上の複雑な AI 推論を合理化する

Kubernetes クラスタ上で最新の ML 推論ワークロードを実行するための Kubernetes API である NVIDIA Grove が NVIDIA Dynamo 内でモジュール型コンポーネントとして利用できるようになりました。

3 MIN READ

2025 年 9 月 9 日

NVIDIA Rubin CPX により、トークン コンテキストが 100 万を超えるワークロードの推論性能と効率が向上

NVIDIA Blackwell や NVIDIA GB200 NVL72 などのプラットフォームと、低精度推論用の NVFP4 や NVIDIA TensorRT-LLM や NVIDIA Dynamo などのオープンソース ソフトウェアを組み合わせることで、AI 全体の推論性能を再定義します。

2 MIN READ

2025 年 5 月 30 日

5 大陸の通信事業者が、NVIDIA を活用したソブリン AI インフラを構築

大規模なインテリジェンスをもたらす新たなインフラである AI ファクトリーに対する大きなニーズは、通信企業にも新たなビジネス チャンスをもたらします。各国の事例をご覧ください。

3 MIN READ

2025 年 5 月 18 日

NVIDIA ARC-Compact を活用して、セル サイトに AI-RAN を展開

NVIDIA ARC-Compact があれば、高性能で電力効率に優れ、柔軟な AI-RAN ソリューションをあらゆるセル サイトで展開できます。

4 MIN READ

2025 年 4 月 11 日

NVIDIA が、NVIDIA DGX SuperPOD でかつてない速さで AI ファクトリーの構築を支援

ソフトバンクが NVIDIA と提携して、どのように広大な AI ファクトリーを構築したのかをご覧ください。

2 MIN READ

2025 年 4 月 10 日

NVIDIA のフルスタック ソリューションで AI 推論のパフォーマンスを最適化

NVIDIA は、AI 推論の可能性を再定義し、これまで以上に高速で、効率的かつ拡張可能なソリューションを提供するために、フルスタックのイノベーションを通じて開発者を支援しています。

2 MIN READ

2025 年 2 月 4 日

NVIDIA Spectrum-X ネットワーキング プラットフォームと NVIDIA パートナーが AI ストレージを最大 48% 高速化

帯域幅が増えることで、AI ワークフローにおけるストレージに依存するステップの完了にかかる時間が短縮できるので、トレーニングにおいてはジョブの完了にかかる時間が短縮され、推論においてはトークン間の遅延が減少します。

2 MIN READ

2024 年 11 月 21 日

NVIDIA NIM でファインチューニングされた AI モデルのデプロイ

パフォーマンスを最適化した TensorRT-LLM 推論エンジンをローカルでビルドして、SFT でカスタマイズされたモデルに対する NIM マイクロサービスを迅速にデプロイする方法を説明します。

2 MIN READ

2024 年 11 月 4 日

NVIDIA AI Workbench によるハイブリッド環境におけるスムーズなコラボレーションと迅速なプロトタイピング

データ サイエンス、AI、機械学習などのプロジェクトを合理化する無料の開発環境マネージャー「NVIDIA AI Workbench」の、最新リリースでの主要な新機能とユーザーから要望のあった更新についてご紹介します。

3 MIN READ

2024 年 10 月 28 日

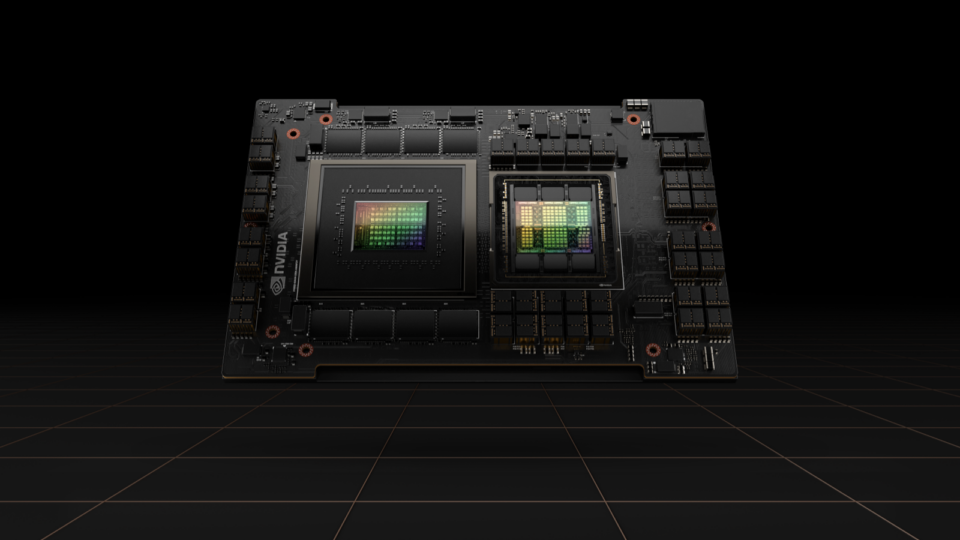

NVIDIA GH200 Superchip が、Llama モデルとのマルチターン インタラクションの推論を 2 倍高速化

NVIDIA GH200 Grace Hopper Superchip を活用し、システム スループットを犠牲にすることなく、x86 ベースの NVIDIA H100 サーバーと比較して、Llama 3 70B モデルでマルチターンでユーザーとのやり取りする場合、TTFT を最大 2 倍に向上させる方法について解説します。

2 MIN READ

2024 年 10 月 8 日

通信会社に AI-RAN を提供

NVIDIA は、同じコンピューティング インフラストラクチャを使用して AI サービスと無線アクセス ネットワーク (RAN) サービスの処理が可能な AI-RAN の展開プラットフォームである Aerial RAN Computer-1 を導入しています。

5 MIN READ

2024 年 9 月 30 日

NVIDIA NIM Operator で Kubernetes の AI 推論パイプラインを管理

NIM Operator を使用すれば、わずか数回のクリックまたはコマンドで、NVIDIA NIM マイクロサービスのデプロイ、オートスケーリング、ライフサイクルを管理することができます。

2 MIN READ

2024 年 4 月 15 日

本番環境への AI モデルのデプロイを効率化する NVIDIA NIM

NVIDIA AI Enterprise に含まれる NVIDIA NIM は、AI を活用するエンタープライズ アプリの開発と、AI モデルを本番環境にデプロイするための合理化された道のりを提供します。

2 MIN READ