AI Inference / Inference Microservices

2025년 9월 19일

AI 추론 지연 시간을 줄이기 위한 Speculative Decoding 소개

거대 언어 모델(LLM)로 텍스트를 생성할 때는 구조적인 한계로 인해 성능을 제대로 끌어내기 어려운 경우가 많습니다. GPU는 뛰어난 연산 성능을…

7 MIN READ

2025년 9월 10일

NVIDIA RTX PRO 6000 Blackwell Server Edition으로 단백질 구조 추론 100배 이상 가속

단백질 구조를 이해하기 위한 경쟁은 그 어느 때보다 중요해졌습니다. 신약 개발을 앞당기고 미래 팬데믹에 대비하기 위해서는…

4 MIN READ

2025년 8월 8일

Ditto in Action: Torch-TensorRT로 손쉽게 LLM 추론 가속하기

Direct Torch to TensorRT-LLM Optimizer, 줄여서 Ditto는 Transformer 모델을 TensorRT 엔진으로…

5 MIN READ

2025년 8월 8일

LLM 추론 벤치마크: TensorRT-LLM을 활용한 성능 튜닝

이 글은 TensorRT-LLM으로 LLM 추론 성능을 벤치마킹하고 최적화하는 방법을 소개하는 시리즈의 세 번째 편입니다.

6 MIN READ

2025년 7월 4일

NVIDIA Jetson와 RTX에서 Google DeepMind의 Gemma 3n 실행하기

이제 NVIDIA는 RTX 및 Jetson 플랫폼에서 Gemma 3n을 공식 지원합니다. 지난달 Google I/

3 MIN READ

2025년 5월 28일

NVIDIA Blackwell 플랫폼 DeepSeek-R1 추론 성능에서 세계 기록 달성

NVIDIA는 NVIDIA GTC 2025에서 DeepSeek-R1 추론 성능 세계 기록을 발표했습니다.

9 MIN READ

2025년 5월 28일

Blackwell, Meta의 Llama 4 Maverick을 활용해 사용자당 1,000 TPS 장벽 돌파

NVIDIA가 세계 최고 속도의 거대 언어 모델(LLM) 추론 성능을 달성했습니다. NVIDIA Blackwell GPU 8개를 탑재한 단일…

6 MIN READ

2025년 5월 21일

NVIDIA Dynamo, 대규모 분산 추론 발전을 위한 llm-d 커뮤니티 이니셔티브 가속화

2025년 Red Hat Summit에서 공개된 llm-d 커뮤니티는 오픈소스 생태계에서 생성형 AI 추론 혁신을 가속하는 중요한 진전입니다.

3 MIN READ

2025년 5월 15일

NVIDIA 풀스택 솔루션을 통한 AI 추론 성능 최적화

2025년 3월 18일부로 NVIDIA Triton Inference Server는 이제 NVIDIA Dynamo로 명칭이 변경되었습니다.

5 MIN READ

2025년 4월 16일

NVIDIA, Meta Llama 4 Scout 및 Maverick에서의 추론 가속화

많은 관심을 받아온 Llama AI 모델의 최신 버전, Llama 4 Scout와 Llama 4 Maverick이 새롭게 공개됐습니다.

3 MIN READ

2025년 3월 12일

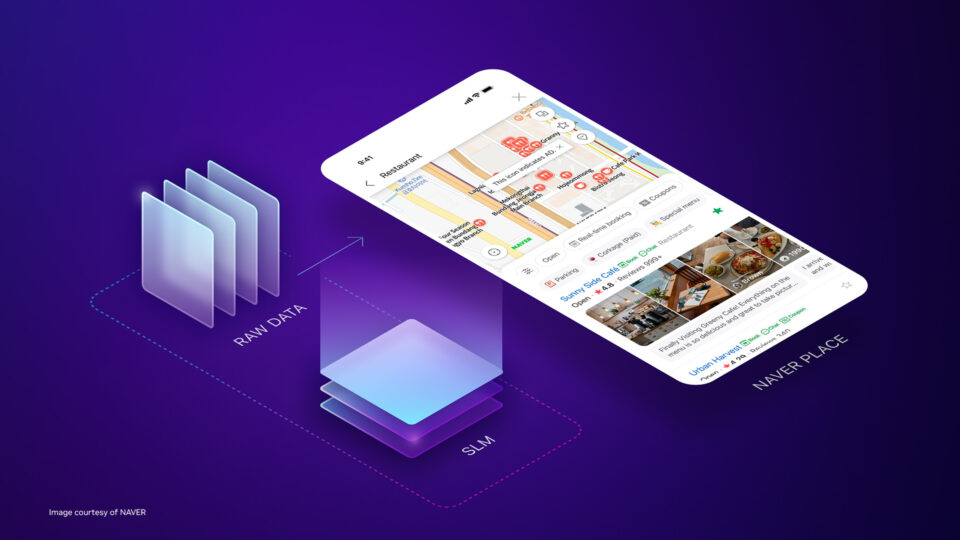

Spotlight: NVIDIA TensorRT-LLM을 활용한 NAVER Place의 SLM Vertical Service 운영 최적화

NAVER Place에서는 Place 영역에 특화된 SLM Vertical Service를 운영하여 플레이스 프로덕트 전반(플레이스, 지도…

7 MIN READ

2025년 2월 13일

DeepSeek-R1 및 추론 시간 스케일링을 통한 GPU 커널 생성 자동화

AI 모델이 점점 더 정교한 문제를 해결하기 위해 기능을 확장하면서, 테스트 시간 확장 또는 추론 시간 확장이라는 개념이 등장하고 있습니다.

4 MIN READ

2025년 2월 7일

OpenAI Triton, NVIDIA Blackwell에서 AI 성능 및 프로그래머블성 향상

행렬 곱셈과 어텐션 메커니즘은 현대 AI 워크로드의 연산적 기반입니다. NVIDIA cuDNN과 같은 라이브러리는 고도로 최적화된 구현을 제공하며…

3 MIN READ

2024년 12월 13일

NVIDIA TensorRT-LLM, 인플라이트 배치로 인코더-디코더 모델 가속화

NVIDIA는 최근 NVIDIA TensorRT-LLM이 인코더-디코더 모델 아키텍처를 가속화한다고 발표했습니다.

3 MIN READ

2024년 11월 15일

NVSwitch와 TensorRT-LLM 멀티샷으로 3배 빠른 AllReduce 구현

사용자 수가 수백 명에서 수십만 명까지 변동하고 각 요청의 입력 시퀀스 길이가 다른 프로덕션 환경에서 생성형 AI 워크로드를 배포하는 데는 여러…

3 MIN READ