AI Inference

2025 年 11 月 10 日

NVIDIA Grove で Kubernetes 上の複雑な AI 推論を合理化する

Kubernetes クラスタ上で最新の ML 推論ワークロードを実行するための Kubernetes API である NVIDIA Grove が NVIDIA Dynamo 内でモジュール型コンポーネントとして利用できるようになりました。

3 MIN READ

2025 年 4 月 10 日

NVIDIA のフルスタック ソリューションで AI 推論のパフォーマンスを最適化

NVIDIA は、AI 推論の可能性を再定義し、これまで以上に高速で、効率的かつ拡張可能なソリューションを提供するために、フルスタックのイノベーションを通じて開発者を支援しています。

2 MIN READ

2024 年 11 月 8 日

NVIDIA TensorRT-LLM の KV Cache Early Reuseで、Time to First Token を 5 倍高速化

KV キャッシュの再利用技術と、TTFT のさらなる高速化を実現するベストプラクティスについて解説します。

2 MIN READ

2024 年 4 月 2 日

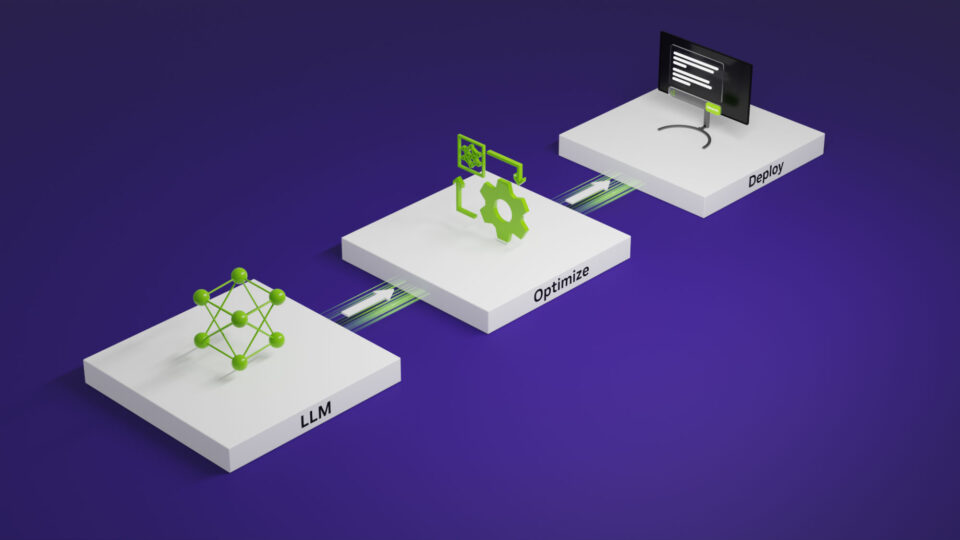

NVIDIA TensorRT-LLM による、LoRA LLM のチューニングとデプロイ

LLM のトレーニング コストを抑え、そのパワーを活用可能なファインチューニングの手法の 1 つである、Low-Rank Adaptation (LoRA) の洞察力と実装について説明し、その応用と利点の一部をご紹介します。

7 MIN READ

2024 年 3 月 18 日

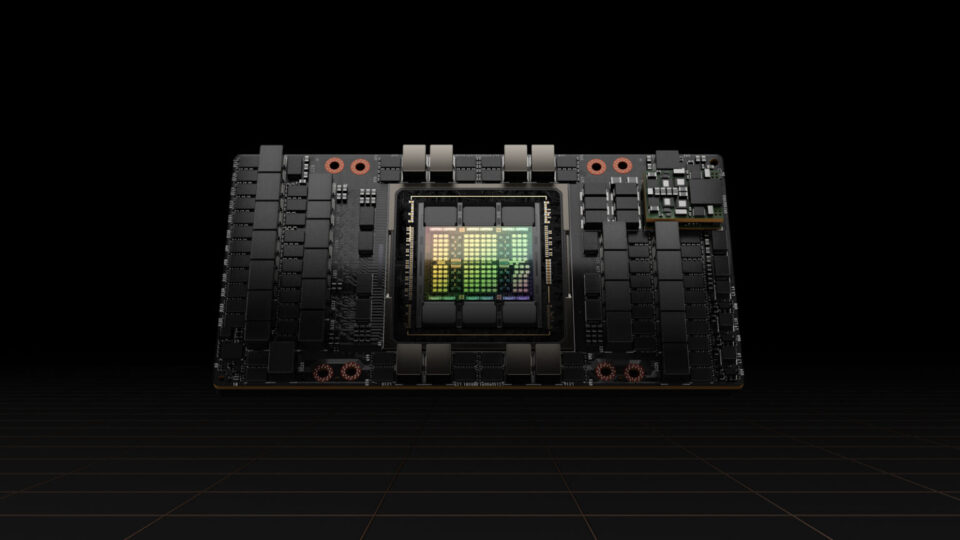

NVIDIA GB200 NVL72 は兆単位パラメーターの LLM トレーニングとリアルタイム推論を実現

新しい NVIDIA GB200 NVL72 は、計算負荷が高く、リソースを大量に消費する大規模なモデルのトレーニングとデプロイに対応するシステムの 1 つです。

4 MIN READ

2024 年 1 月 17 日

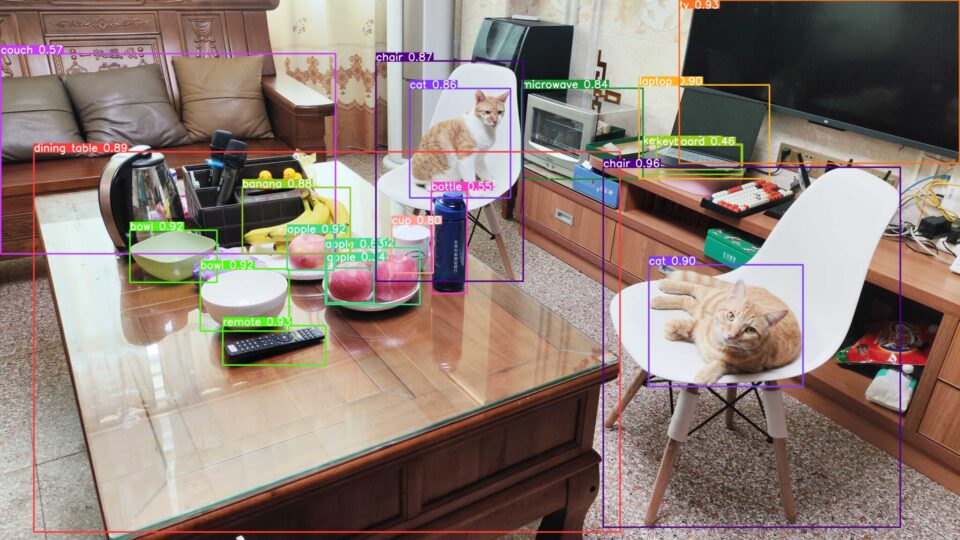

cuDLA による NVIDIA Jetson Orin 上での YOLOv5 の紹介

この投稿は、Orin プラットフォームを使用する組込み開発者が、YOLOv5 をリファレンスとして、

5 MIN READ

2023 年 11 月 17 日

LLM テクニックの習得: 推論の最適化

LLM 推論における最も差し迫った課題と、いくつかの実用的な解決策について説明します。

6 MIN READ