Posts by 乔显杰

代理式 AI/生成式 AI

2025年 9月 22日

扩展 TensorRT-LLM 中的专家并行度:大规模 EP 的设计与实现

DeepSeek-V3 / R1 等模型采用大规模细粒度混合专家模型 (MoE) 架构,大幅提升了开源模型的质量。

10 MIN READ

代理式 AI/生成式 AI

2025年 8月 26日

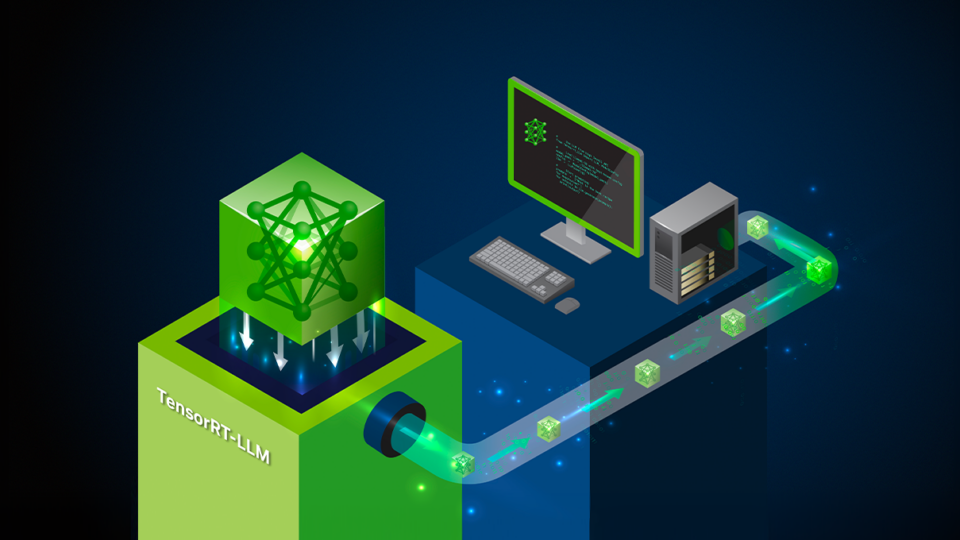

TensorRT-LLM 中的分离式服务

在之前的技术博客中,我们介绍了低延迟和高吞吐场景的优化方法。对于生产部署,用户还关心在满足特定延迟约束的情况下,每个 GPU 的吞吐表现。

3 MIN READ