graph neural networks

2024년 3월 15일

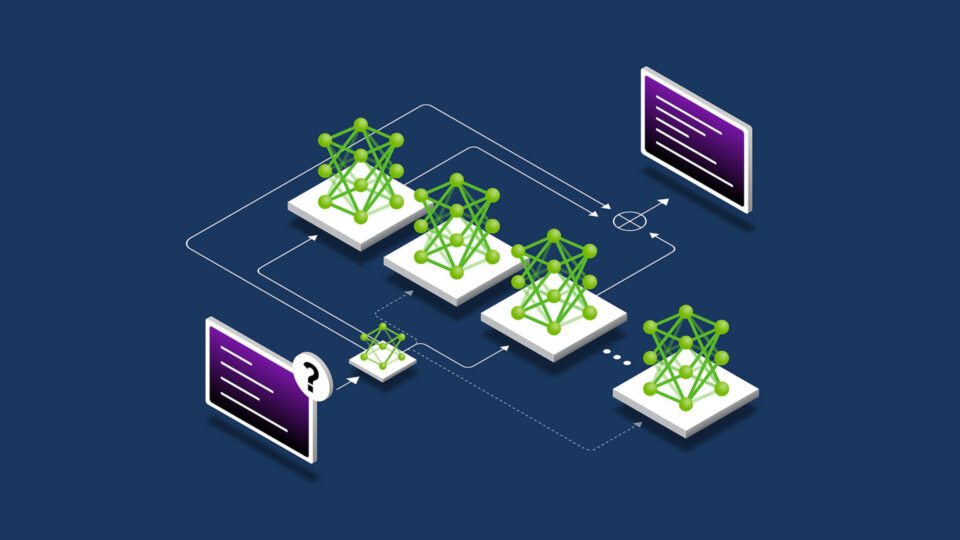

LLM 아키텍처에 Mixture of Experts(MoE)를 활용하기

Mixture of Experts(MoE) 거대 언어 모델(LLM) 아키텍처는 최근 GPT-4와 같은 독점 LLM은 물론 Mixtral 8x7B의…

7 MIN READ

2023년 11월 29일

LLM, 추천 시스템 및 GNN을 위한 하나의 거대한 슈퍼칩: NVIDIA GH200 NVL32

AWS re:Invent 2023에서 AWS와 NVIDIA는 AWS가 클라우드 제공업체 중 최초로 NVIDIA DGX 클라우드를 통해 NVIDIA…

6 MIN READ