Intermediate Technical

2026 年 4 月 28 日

24 時間 365 日 のシミュレーション ループ: エージェント型 AI がサブサーフェス エンジニアリングを前進させる仕組み

繰り返し発生する技術的なハードルを、エージェント型 AI でオフロードすることで、より広範なソリューション空間を探索し、資産価値の向上を推進しましょう。

2 MIN READ

2026 年 4 月 20 日

NVIDIA Jetson でメモリ効率を最大化して大規模なモデルを実行

リソースに制約のあるエッジ システムで、開発者がパフォーマンス、効率性、機能を最大化するのに役立つ最適化戦略について説明します。

4 MIN READ

2026 年 4 月 8 日

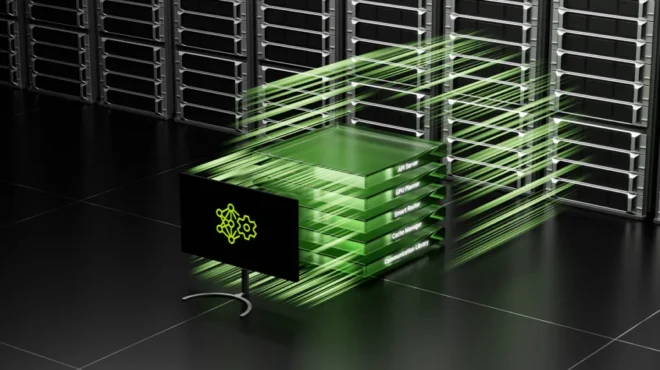

NVIDIA Omniverse ライブラリを活用した、フィジカル AI 機能の既存アプリへの統合

NVIDIA Omniverse は、既存アプリにフィジカル AI 機能を統合しやすくするため、レンダリング (ovrtx)、物理シミュレーション (ovphysx)、データ パイプライン (ovstorage) を C API として公開しています。

4 MIN READ

2026 年 3 月 13 日

NVIDIA Cosmos 世界基盤モデルによる、合成データのスケールアップとフィジカル AI リーズニングの実現

トレーニング データ不足の問題を解決する、最新の Cosmos WFM (世界基盤モデル)、フィジカル AI を進化させる主な機能、そしてそれらの使用方法について解説します。

3 MIN READ

2026 年 3 月 11 日

Nemotron 3 Super の紹介: エージェント型推論向けのオープン ハイブリッド Mamba-Transformer MoE

Nemotron 3 Super は、高容量の推論モデルにおける典型的な効率と精度のトレードオフを軽減するアーキテクチャ革新を導入しています。

3 MIN READ

2026 年 2 月 6 日

マルチ LLM 対応の NVIDIA NIM による合成データ SFT (Seed あり / なし) の効果分析

マルチ LLM 対応の NVIDIA NIM を用いた SFT 済みモデルのデプロイ方法、日本語常識推論タスクの評価手法、合成データ SFT の効果比較について解説します。

3 MIN READ

2026 年 2 月 6 日

NVIDIA NeMo RL を用いた合成データによる Supervised Fine-Tuning (SFT)

高品質な合成データを用い、 NeMo RL による Supervised Fine-Tuning (SFT) を行うことで、 小規模モデルの日本語常識推論性能を改善する方法を解説します。

7 MIN READ

2026 年 2 月 6 日

Nemotron-Personas-Japan を用いた NVIDIA NeMo Data Designer による合成データ生成

単なる LLM 合成生成を越え、構造化、検証、再現性、多様性という観点で品質とスケールを両立した合成データ フレームワークとして設計された NeMo Data Designer で、Seed データを活用した高品質データ生成方法をご紹介します。

4 MIN READ

2026 年 1 月 6 日

NVIDIA Spectrum-X イーサネット フォトニクス による電力効率に優れた AI ファクトリーの拡張

AI ファクトリーのために開発された、電力効率に優れ、信頼性、回復力に優れたコパッケージド オプティカル ネットワークを実現する Spectrum-X イーサネット フォトニクスのプロトコルとハードウェアにおける主要な最適化と革新について探ります。

2 MIN READ

2026 年 1 月 5 日

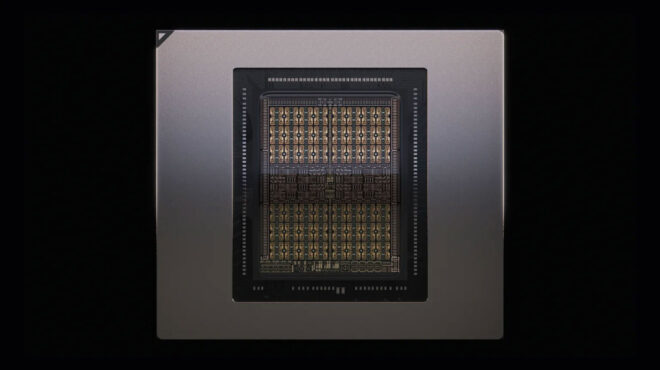

NVIDIA Rubin プラットフォームの内部: 6 つの新チップと AI スーパーコンピューター

AI は産業化段階に移行しています。 個別の AI モデルのトレーニングや人と直接対話する推論を実行するシステムとして始まった AI は、

13 MIN READ

2025 年 11 月 18 日

NVIDIA テクノロジを活用した日本語医療音声エージェントの構築による臨床業務負担の軽減

日本の医療従事者がより多くの時間を患者に向き合えるようにする、音声 AI 技術を活用した音声対話エージェントの構築を NVIDIA のソリューションで加速しましょう。

5 MIN READ

2025 年 11 月 10 日

NVIDIA Grove で Kubernetes 上の複雑な AI 推論を合理化する

Kubernetes クラスタ上で最新の ML 推論ワークロードを実行するための Kubernetes API である NVIDIA Grove が NVIDIA Dynamo 内でモジュール型コンポーネントとして利用できるようになりました。

3 MIN READ

2025 年 11 月 3 日

NVIDIA AI Blueprints を活用した動画解析の新しいアプローチ

NVIDIA の動画検索および要約用 AI Blueprint (VSS: Video Search and Summarization) と RAG Blueprint を統合し、動画解析と要約を高度化する方法を紹介します。

4 MIN READ

2025 年 9 月 29 日

NVIDIA Isaac Lab と Newton で四足歩行の移動ポリシーをトレーニングし、布の操作をシミュレートする

物理演算はロボティクス シミュレーションで重要な役割を果たし、

3 MIN READ

2025 年 9 月 9 日

NVIDIA Rubin CPX により、トークン コンテキストが 100 万を超えるワークロードの推論性能と効率が向上

NVIDIA Blackwell や NVIDIA GB200 NVL72 などのプラットフォームと、低精度推論用の NVFP4 や NVIDIA TensorRT-LLM や NVIDIA Dynamo などのオープンソース ソフトウェアを組み合わせることで、AI 全体の推論性能を再定義します。

2 MIN READ

2025 年 7 月 29 日

FourCastNet 3 がスケーラブルな幾何学機械学習によって高速かつ高精度な大規模アンサンブル気象予測を可能にする

FourCastNet3 (FCN3) は、NVIDIA Earth-2 による最新の AI グローバル気象予測システムで、中期予報における予測精度は最先端の機械学習モデルに匹敵し、従来の数値予報システムを上回ります。

3 MIN READ