GB200

2025年 9月 9日

NVIDIA Rubin CPX 加速百万级以上 token 上下文工作负载的推理性能和效率

推理正成为人工智能复杂性的前沿领域。现代模型正逐步演变为具备多步推理能力、持久化记忆和长时程上下文理解的代理式系统,使其能够胜任软件开发、

2 MIN READ

2025年 9月 9日

NVIDIA Blackwell Ultra 首次亮相 MLPerf 完成推理新纪录

随着大语言模型(LLM)规模的不断扩大,其智能水平也显著提升,领先开发者推出的开放模型已具备数千亿参数。与此同时,

3 MIN READ

2025年 8月 22日

揭秘 NVIDIA Blackwell Ultra:推动 AI 工厂时代的芯片动力

作为 NVIDIA Blackwell 架构系列的最新成员,NVIDIA Blackwell Ultra GPU 依托核心创新,

5 MIN READ

2025年 8月 13日

Dynamo 0.4 最新版本提供高达 4 倍性能提升、基于 SLO 自动扩展和实时可观察性

近期,OpenAI 的 gpt-oss、月之暗面的 Kimi K2 等多个新的前沿开源模型相继问世,标志着大语言模型 (LLM)…

2 MIN READ

2025年 8月 7日

在单个 NVIDIA Grace Hopper 超级芯片上使用 XGBoost 3.0 训练 TB 级数据集

梯度提升决策树 (GBDT) 驱动着从实时欺诈过滤到 PB 级需求预测的各种功能。由于其先进的准确性、

2 MIN READ

2025年 8月 7日

使用 JIT 编译在 cuDF 中高效转换

RAPIDS cuDF 提供了一系列用于使用 GPU 处理数据的 ETL 算法。对于 pandas 用户,

3 MIN READ

2025年 7月 28日

新的 GB300 NVL72 功能如何为 AI 提供稳定的动力

电网的设计目的是支持相对稳定的负载,例如照明、家用电器和以恒定功率运行的工业机器。但如今的数据中心,尤其是运行 AI 工作负载的数据中心,

2 MIN READ

2025年 6月 18日

抢先体验 NVIDIA GB200 系统如何帮助 LMarena 构建评估 LLM 的模型

在 NVIDIA 和 Nebius 的帮助下,加州大学伯克利分校的 LMArena 可以更轻松地了解哪些大语言模型在特定任务中表现出色。

2 MIN READ

2025年 6月 6日

NVIDIA GB200 NVL72 和 NVIDIA Dynamo 如何提升 MoE 模型的推理性能

最新一批开源大语言模型 (LLMs) 采用了 Mixture of Experts (MoE) 架构,如 DeepSeek R1、

4 MIN READ

2025年 6月 4日

NVIDIA Blackwell 在 MLPerf Training v5.0 中实现高达 2.6 倍的性能提升

创建先进的大语言模型 (LLM) 的过程始于预训练过程。预训练最先进的模型具有很高的计算要求,因为热门的开放权重模型具有数百亿到数千亿个参数,

3 MIN READ

2025年 5月 20日

NVIDIA 800V HVDC 架构赋能新一代 AI 工厂发展

AI 工作负载的指数级增长正在增加数据中心的功率需求。传统的 54 V 机架内配电专为千瓦(KW)-scale 机架设计,

2 MIN READ

2025年 4月 2日

NVIDIA Blackwell 在 MLPerf Inference v5.0 中实现巨大的性能飞跃

在不断增长的模型大小、实时延迟要求以及最近的 AI 推理的推动下, 大语言模型 (LLM) 推理的计算需求正在快速增长。与此同时,

3 MIN READ

2025年 3月 25日

借助 NVIDIA Mission Control 实现 AI 工厂自动化

DeepSeek-R1 等先进的 AI 模型证明,企业现在可以构建专用于自己的数据和专业知识的尖端 AI 模型。

2 MIN READ

2025年 3月 18日

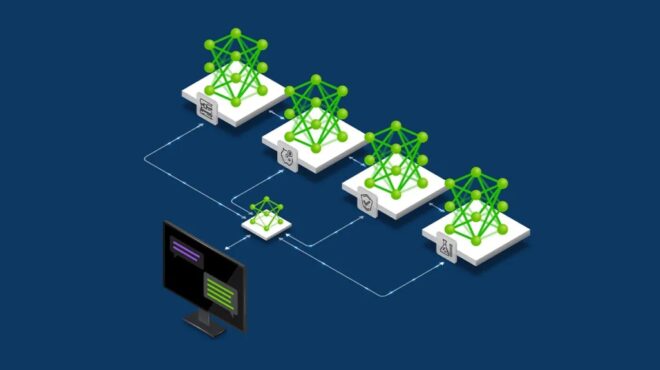

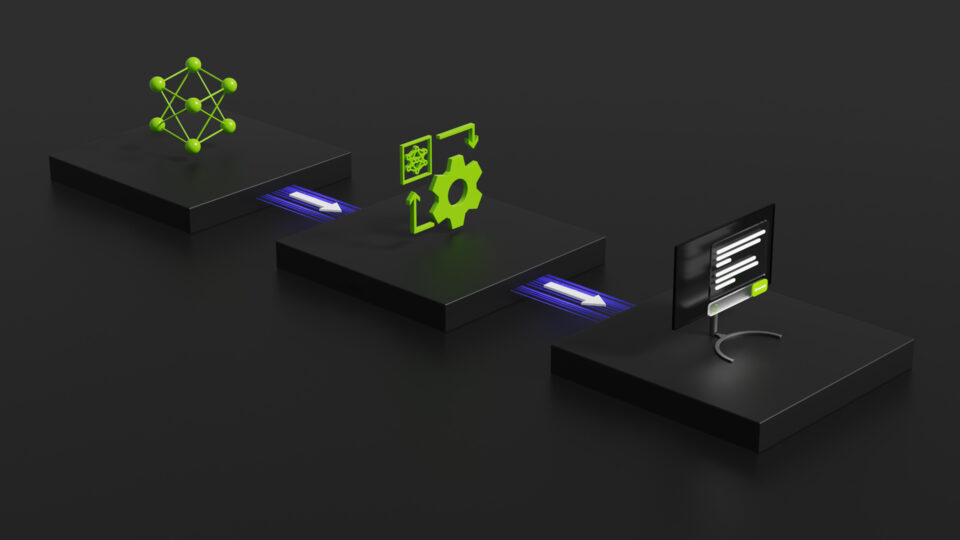

隆重推出 NVIDIA Dynamo:用于扩展推理AI模型的低延迟分布式推理框架

NVIDIA 今天在 GTC 2025 宣布发布 NVIDIA Dynamo 。NVIDIA Dynamo 是一个高吞吐量、

4 MIN READ

2024年 12月 24日

借助 NVIDIA 全栈解决方案提升 AI 推理性能

AI 驱动的应用的爆炸式发展对开发者提出了前所未有的要求,他们必须在提供先进的性能与管理运营复杂性和成本以及 AI 基础设施之间取得平衡。

2 MIN READ

2024年 11月 13日

NVIDIA Blackwell 在 MLPerf 训练 v4.1 中将 LLM 训练性能提高一倍

随着模型规模的扩大以及使用更多数据进行训练,它们的能力也随之提升,实用性也随之提升。为了快速训练这些模型,需要在数据中心规模上提供更高的性能。

3 MIN READ