Advanced Technical

2025年 9月 9日

如何利用跨区域 (Scale-Across) 网络将分布式数据中心连接成大型 AI 工厂

AI 技术日益复杂,训练与推理领域的新进展对数据中心提出了更高的要求。尽管数据中心的功能正在迅速扩展,但其基础设施受限于基本的物理条件,

1 MIN READ

2025年 8月 21日

更少的编码,更多的科学:借助 OpenACC 和统一内存简化 GPU 上的海洋建模

NVIDIA HPC SDK v25.7 为采用 GPU 加速的高性能计算(HPC)应用开发者带来了重大突破。

3 MIN READ

2025年 8月 13日

使用 ProRL v2 通过长时间训练扩展 LLM 强化学习

目前,AI 领域最引人注目的问题之一是大型语言模型 (LLM) 是否可以通过持续强化学习 (RL) 继续改进,或者其能力是否最终会达到顶峰。

4 MIN READ

2025年 8月 7日

在单个 NVIDIA Grace Hopper 超级芯片上使用 XGBoost 3.0 训练 TB 级数据集

梯度提升决策树 (GBDT) 驱动着从实时欺诈过滤到 PB 级需求预测的各种功能。由于其先进的准确性、

2 MIN READ

2025年 8月 4日

NVIDIA CUDA-Q 0.12 扩展了用于开发硬件性能量子应用的工具集

NVIDIA CUDA-Q 0.12 引入了新的仿真工具,可加速研究人员开发量子应用和设计高性能量子硬件。 借助新的 API,

2 MIN READ

2025年 8月 1日

通过训练后量化优化 LLM 的性能和准确性

量化是开发者的核心工具,旨在以最小的开销来提高推理性能。通过以可控的方式降低模型精度,无需重新训练,该技术可显著降低延迟、

4 MIN READ

2025年 7月 23日

PDF 数据提取方法及其在信息检索中的应用

PDF 是共享财务报告、研究论文、技术文档和营销材料等信息的常用文件格式之一。然而,在构建有效的检索增强生成 (RAG) 系统时,

4 MIN READ

2025年 7月 16日

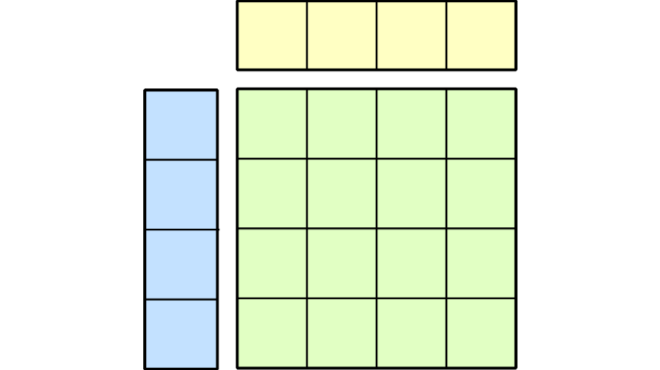

CUTLASS:基于张量和空间微核处理多维数据的原理抽象

在生成式 AI 时代,充分发挥 GPU 的潜力对于训练更好的模型和大规模服务用户至关重要。通常,

4 MIN READ

2025年 7月 2日

通过低精度量化优化用于图像编辑的 FLUX.1 Kontext

FLUX.1 Kontext 是 Black Forest Labs 最近发布的模型,是对社区图像生成模型的一项令人着迷的补充。

3 MIN READ

2025年 6月 9日

借助 EoRA 快速恢复 LLM 压缩错误的免微调方法

模型压缩技术已经过广泛探索,可减少为大语言模型 (LLM) 或其他大型神经网络提供服务所需的计算资源。 但是,与未压缩的模型相比,

5 MIN READ

2025年 5月 27日

在 NVIDIA Grace Hopper 上训练大型语言模型的高级优化策略

虽然分析有助于识别效率低下的情况,但高级优化策略对于解决硬件限制和有效扩展 AI 工作负载至关重要。在本文中,我们将探讨 CPU 卸载、

3 MIN READ

2025年 5月 22日

特级大师专业提示:使用 cuML 通过堆叠夺得 Kaggle 竞赛冠军

堆叠是一种先进的表格数据建模技术,通过结合多个不同模型的预测来实现高性能。利用 GPU 的计算速度,可以高效地训练大量模型。

2 MIN READ

2025年 5月 19日

聚焦:Atgenomix SeqsLab 提升健康组学分析以支持精准医疗

在传统的临床医学实践中,治疗决策通常基于一般准则、以往经验和试错方法。如今,随着电子病历 (EMRs) 和基因组数据的访问,

2 MIN READ

2025年 4月 24日

使用 NVIDIA OptiX 9 和 NVIDIA RTX Mega Geometry 实现动态场景的快速光线追踪

实时光线追踪是一种强大的渲染技术,可以生成非常逼真的图像。 NVIDIA OptiX 和 RTX 技术使这一切成为可能,

3 MIN READ

2025年 3月 25日

利用 NVIDIA Earth-2 提升洪水风险评估能力

陆地洪水每年都会造成重大的经济和社会影响。在 2024 年给保险业造成超过 10 亿美元损失的八场自然灾害中,有六场被归类为洪水事件,

3 MIN READ

2025年 3月 21日

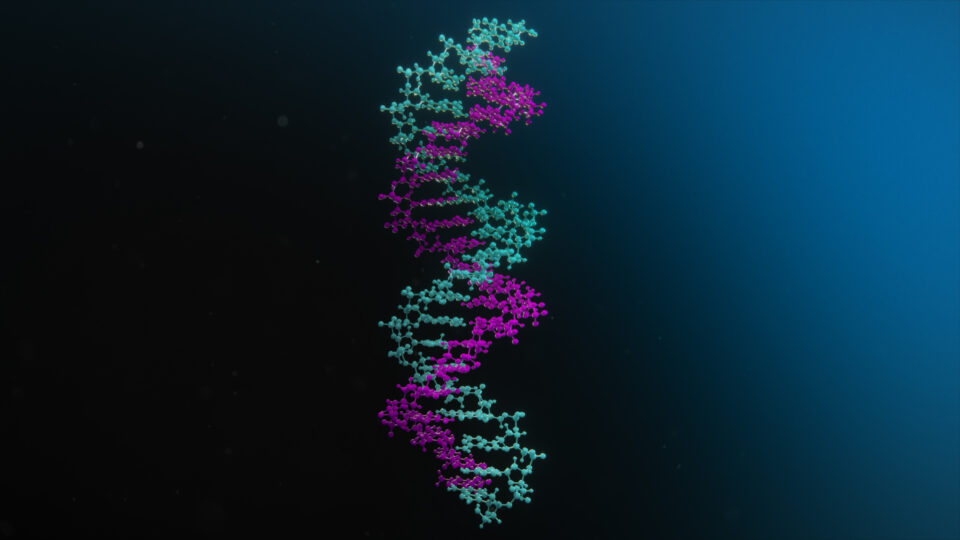

借助 NVIDIA Parabricks 和 NVIDIA AI Blueprints,将基因组学和单细胞分析时间缩短至几分钟

NVIDIA Parabricks 是一款可扩展的基因组学分析软件套件,通过加速计算和深度学习解决 omics 挑战,实现新的科学突破。

3 MIN READ