最近文章

2025年 10月 15日

面向代理式 AI 和 6G 时代的加速和分布式 UPF

电信行业正快速向AI原生无线接入网(AI-RAN)和以AI为核心的6G方向演进。分布式用户面功能(dUPF)通过去中心化的数据包处理与路由,

4 MIN READ

2025年 10月 15日

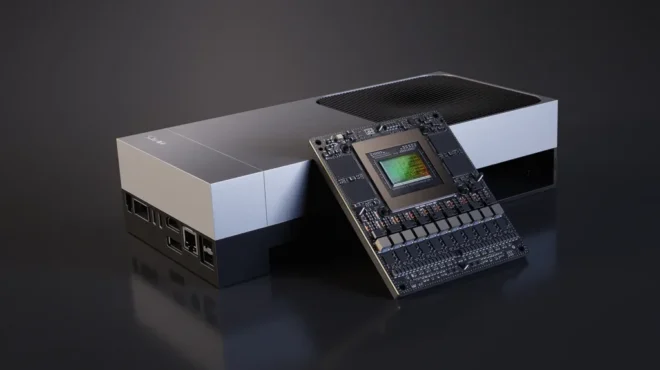

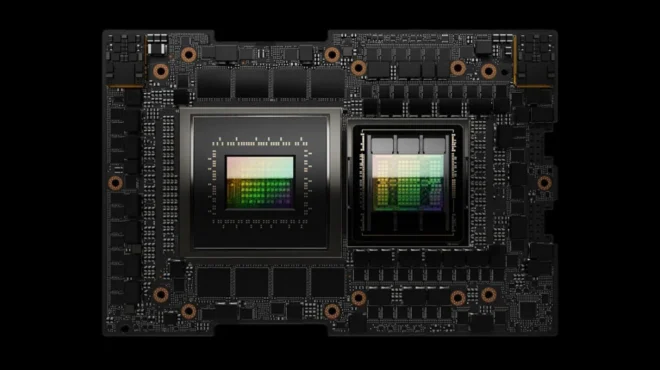

通过 NVIDIA Jetson AGX Thor 实现 7 倍生成式 AI 性能,解锁更快速、更智能的边缘模型

NVIDIA 软件生态系统的一大显著优势在于其持续优化的承诺。今年 8 月,NVIDIA 发布了 Jetson AGX Thor,

2 MIN READ

2025年 10月 14日

借助 NVIDIA Parabricks 提高变体识别准确性

NVIDIA Parabricks 是一款专为数据科学家和生物信息学家设计的可扩展基因组学软件套件,专注于基因数据的二级分析。

3 MIN READ

2025年 10月 14日

硬件一致性平台上的内存管理深入剖析

如果您是应用程序开发者或集群管理员,可能已经意识到非统一内存访问(NUMA)会对系统性能产生显著影响。

2 MIN READ

2025年 10月 14日

借助 QuTip 和 scQubits 中的 NVIDIA cuQuantum 集成加速量子位研究

NVIDIA cuQuantum 是一个软件开发工具包(SDK),可加速电路级(数字)和器件级(模拟)的量子模拟。

2 MIN READ

2025年 10月 13日

使用 NVIDIA Dynamo 部署 72B 模型提升 PD 分离性能

在生产环境部署大模型推理服务时,技术团队往往会遇到诸多挑战,例如缺乏成熟的 PD 分离方案、自动扩缩容机制不够灵活、缺乏动态路由,

2 MIN READ

2025年 10月 11日

探索在大模型训练中使用 Megatron-Core 训练框架提高显存使用效率

在大模型训练中,显存(GPU Memory)始终是最稀缺的资源之一。随着模型规模迈入百亿、千亿甚至万亿参数级别,如何在有限显存中“塞下”…

3 MIN READ

2025年 10月 10日

使用 NVIDIA Nemotron 构建日志分析多智能体自校正 RAG 系统

日志是现代系统的核心所在。然而,随着应用规模不断扩大,日志往往演变成一片冗长繁杂的文本海洋,充斥着重复与冗余信息,令人不堪重负。

2 MIN READ

2025年 10月 9日

从助手到对手:利用代理式 AI 开发者工具

越来越多的开发者开始采用支持人工智能的编码工具,例如 Cursor、OpenAI Codex、Claude Code 和 GitHub…

3 MIN READ

2025年 10月 8日

训练联合 AI 模型以预测蛋白质属性

预测蛋白质在细胞内的定位对于生物学研究和药物开发具有重要意义,这一过程被称为亚细胞定位。蛋白质的功能与其所处位置密切相关,明确其存在于细胞核、

2 MIN READ

2025年 10月 7日

使用 NVIDIA TensorRT Model Optimizer 剪枝和蒸 LLM

大语言模型(LLM)在自然语言处理(NLP)任务,如代码生成、推理和数学计算等方面,展现出卓越的性能,树立了新的标杆。然而,

3 MIN READ

2025年 10月 6日

GPU 原生 Velox 和 NVIDIA cuDF 加速大规模数据分析

随着工作负载规模的扩大以及对高效数据处理需求的提升,相比基于 CPU 的系统,采用 GPU 加速的数据库和查询引擎在性价比方面展现出显著优势。

2 MIN READ

2025年 10月 3日

NVIDIA NV-Tesseract 和 NVIDIA NIM 实现半导体制造智能异常检测

在之前的一篇博客文章中,我们介绍了 NVIDIA NV-Tesseract,这是一系列旨在统一框架内处理多种时间序列任务的模型,涵盖异常检测、

2 MIN READ

2025年 10月 2日

NVIDIA AI Red 团队的实用 LLM 安全建议

近年来,NVIDIA AI 红队(AIRT)已对多款在投产前的支持 AI 的系统进行了潜在漏洞和安全风险评估。

1 MIN READ

2025年 9月 30日

id Software 在 DOOM:黑暗时代中采用神经渲染和路径追踪技术的揭秘

《毁灭战士:黑暗时代》(DOOM: The Dark Ages)通过集成 RTX 神经渲染与路径追踪技术,

1 MIN READ

2025年 9月 30日

借助 NVIDIA NV-Tesseract-AD 推进行业应用的异常检测

在最近的一篇博客文章中,我们介绍了 NVIDIA NV-Tesseract,这是一系列旨在将异常检测、分类与预测统一到同一框架中的模型。

1 MIN READ