数据中心/云端

2025年 9月 2日

降低模型部署成本,同时通过 GPU 显存交换保持性能

大规模部署大语言模型(LLM)面临双重挑战:一方面需保障高需求时段的快速响应能力,另一方面又要有效控制 GPU 成本。组织通常面临两难选择:

2 MIN READ

2025年 8月 27日

如何通过共享内存寄存器溢出来提高 CUDA 内核性能

当 CUDA 内核所需的硬件寄存器数量超过可用数量时,编译器会将多余的变量溢出到本地内存中,这一过程称为寄存器溢出。

3 MIN READ

2025年 8月 26日

行业协作共推 NVIDIA CPO 技术

NVIDIA 通过光、电组件的无缝集成,重塑数据中心互连新格局。这一突破的关键在于与整个行业的合作伙伴的紧密合作。

1 MIN READ

2025年 8月 25日

NVFP4 实现 16 位训练精度,4 位训练速度和效率

近年来,AI工作负载呈指数级增长,这不仅体现在大型语言模型(LLM)的广泛部署上,也反映在预训练和后训练阶段对处理更多token的迫切需求。

2 MIN READ

2025年 8月 22日

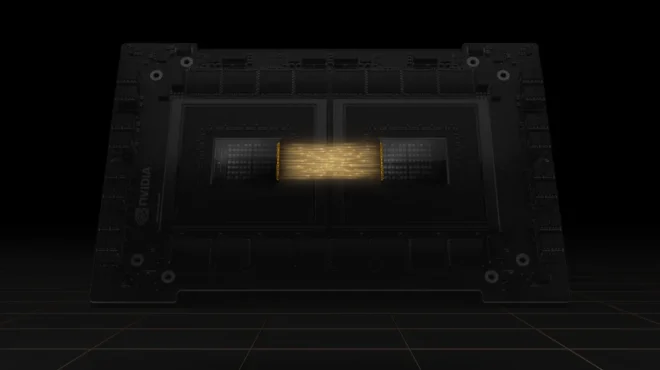

揭秘 NVIDIA Blackwell Ultra:推动 AI 工厂时代的芯片动力

作为 NVIDIA Blackwell 架构系列的最新成员,NVIDIA Blackwell Ultra GPU 依托核心创新,

5 MIN READ

2025年 8月 21日

借助 NVIDIA NVLink 和 NVLink Fusion 扩展 AI 推理性能和灵活性

AI 模型复杂性的指数级增长驱动参数规模从数百万迅速扩展到数万亿,对计算资源提出了前所未有的需求,必须依赖大规模 GPU 集群才能满足。

2 MIN READ

2025年 8月 21日

更少的编码,更多的科学:借助 OpenACC 和统一内存简化 GPU 上的海洋建模

NVIDIA HPC SDK v25.7 为采用 GPU 加速的高性能计算(HPC)应用开发者带来了重大突破。

3 MIN READ

2025年 8月 18日

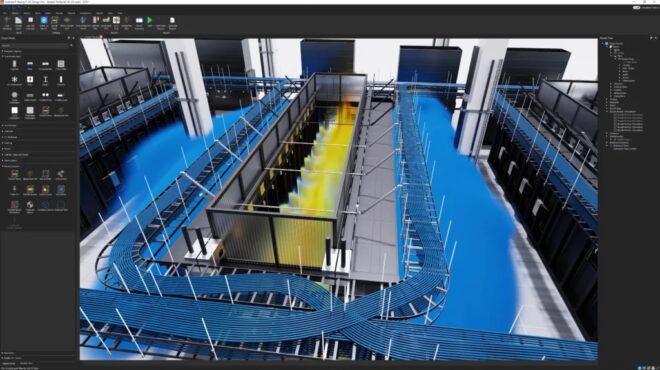

利用 CPO 技术扩展 AI 工厂,提高能效

随着 AI 重新定义计算格局,网络已成为构建未来数据中心发展的关键支柱。大语言模型的训练性能不仅取决于计算资源,更受到底层网络敏捷性、

2 MIN READ

2025年 8月 13日

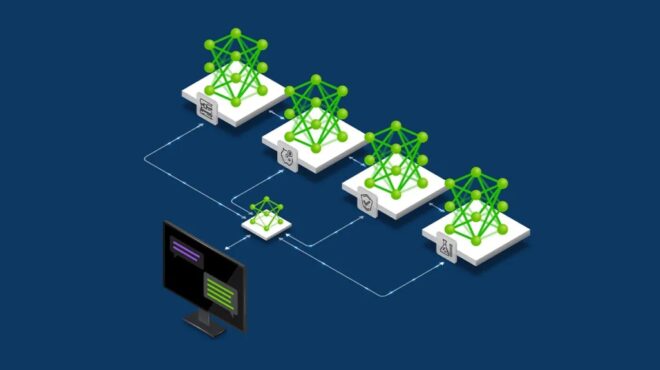

Dynamo 0.4 最新版本提供高达 4 倍性能提升、基于 SLO 自动扩展和实时可观察性

近期,OpenAI 的 gpt-oss、月之暗面的 Kimi K2 等多个新的前沿开源模型相继问世,标志着大语言模型 (LLM)…

2 MIN READ

2025年 8月 5日

NVIDIA vGPU 19.0 支持 NVIDIA Blackwell GPU 的图形和 AI 虚拟化功能

虚拟化长期以来一直承诺提高效率和可扩展性。然而,由于图形和计算工作负载的需求不断增加,以及需要找到经济高效的解决方案来提高用户密度,

2 MIN READ

2025年 8月 4日

NVIDIA CUDA-Q 0.12 扩展了用于开发硬件性能量子应用的工具集

NVIDIA CUDA-Q 0.12 引入了新的仿真工具,可加速研究人员开发量子应用和设计高性能量子硬件。 借助新的 API,

2 MIN READ

2025年 8月 4日

GPU 架构支持导航:面向 NVIDIA CUDA 开发者的指南

如果您最近使用 NVIDIA CUDA 编译器 (NVCC) 开发 NVIDIA GPU 应用,您可能会遇到以下警告消息: 这究竟意味着什么,

1 MIN READ

2025年 8月 1日

通过训练后量化优化 LLM 的性能和准确性

量化是开发者的核心工具,旨在以最小的开销来提高推理性能。通过以可控的方式降低模型精度,无需重新训练,该技术可显著降低延迟、

4 MIN READ

2025年 7月 30日

使用 CI/CD 自动化网络配置和部署

持续集成和持续交付/部署 (CI/CD) 是一套现代软件开发实践,用于更可靠、更频繁地交付代码更改。虽然 CI/CD 在软件领域得到广泛采用,

1 MIN READ

2025年 7月 28日

新的 GB300 NVL72 功能如何为 AI 提供稳定的动力

电网的设计目的是支持相对稳定的负载,例如照明、家用电器和以恒定功率运行的工业机器。但如今的数据中心,尤其是运行 AI 工作负载的数据中心,

2 MIN READ

2025年 7月 23日

在 Azure 上使用 Apache Spark 和 NVIDIA AI 进行无服务器分布式数据处理

将大量文本库转换为数字表示 (称为嵌入) 的过程对于生成式 AI 至关重要。从语义搜索和推荐引擎到检索增强生成 (RAG) ,

2 MIN READ