NVIDIA T4 于 4 年前作为通用 GPU 引入主流服务器。 T4 GPU 已被广泛采用,目前是 NVIDIA 数据中心中容量最大的 GPU s 。 T4 GPU 被部署到人工智能推理、云游戏、视频和视觉计算的用例中。

在 NVIDIA GTC 2023 主题演讲中, NVIDIA 为人工智能工作负载推出了 several inference platforms ,包括 NVIDIA T4 的继任者: NVIDIA L4 Tensor Core GPU 。 L4 GPU 现在是一款通用、节能的加速器,旨在满足视频、视觉计算、图形、虚拟化、生成人工智能和边缘计算的众多应用的人工智能需求。

在这篇文章中,我们介绍了与上一代( T4 )相比, L4 GPU 的主流服务器如何提供更多的 AI 视频性能,并实现更多的视频流。您将在从视频流到药物发现的各种用例中找到经过验证的结果,并了解如何体验今天在 L4 GPU 上运行人工智能工作负载的差异。

Ada Lovelace 架构 L4 张量核心 GPU

NVIDIA L4 GPU 基于 NVIDIA Ada Lovelace architecture ,具有以下功能:

- 第四代张量核

- 第三代 RT 核心

- 着色器执行重新排序( SER )

- 硬件加速的图像和视频处理引擎,包括 AV1 编码/解码

- 深度学习超级采样( DLSS 3 )

- 24 GB GDDR6 内存

这款多功能 GPU 采用 PCIe 单插槽低外形,功率为 72 W 。

为生成人工智能提供更多性能

随着生成的人工智能功能和用例使客户的生活更加便利,体验更加身临其境,对加速计算的需求比以往任何时候都更加增长。 L4 GPU 通过提供比上一代高 2.7 倍的生成人工智能性能来改善这些体验。

凭借 NVIDIA 人工智能平台和全栈方法, L4 GPU 针对广泛的人工智能应用进行了大规模推理优化。推理是人工智能在现实世界中发挥作用的地方,涉及到每一个产品、服务和互动。

创新者突破了可能的界限。从视频推荐到人工智能生成的化身,他们正在构建复杂度迅速增加的人工智能模型,以涵盖比以往更多的用例。

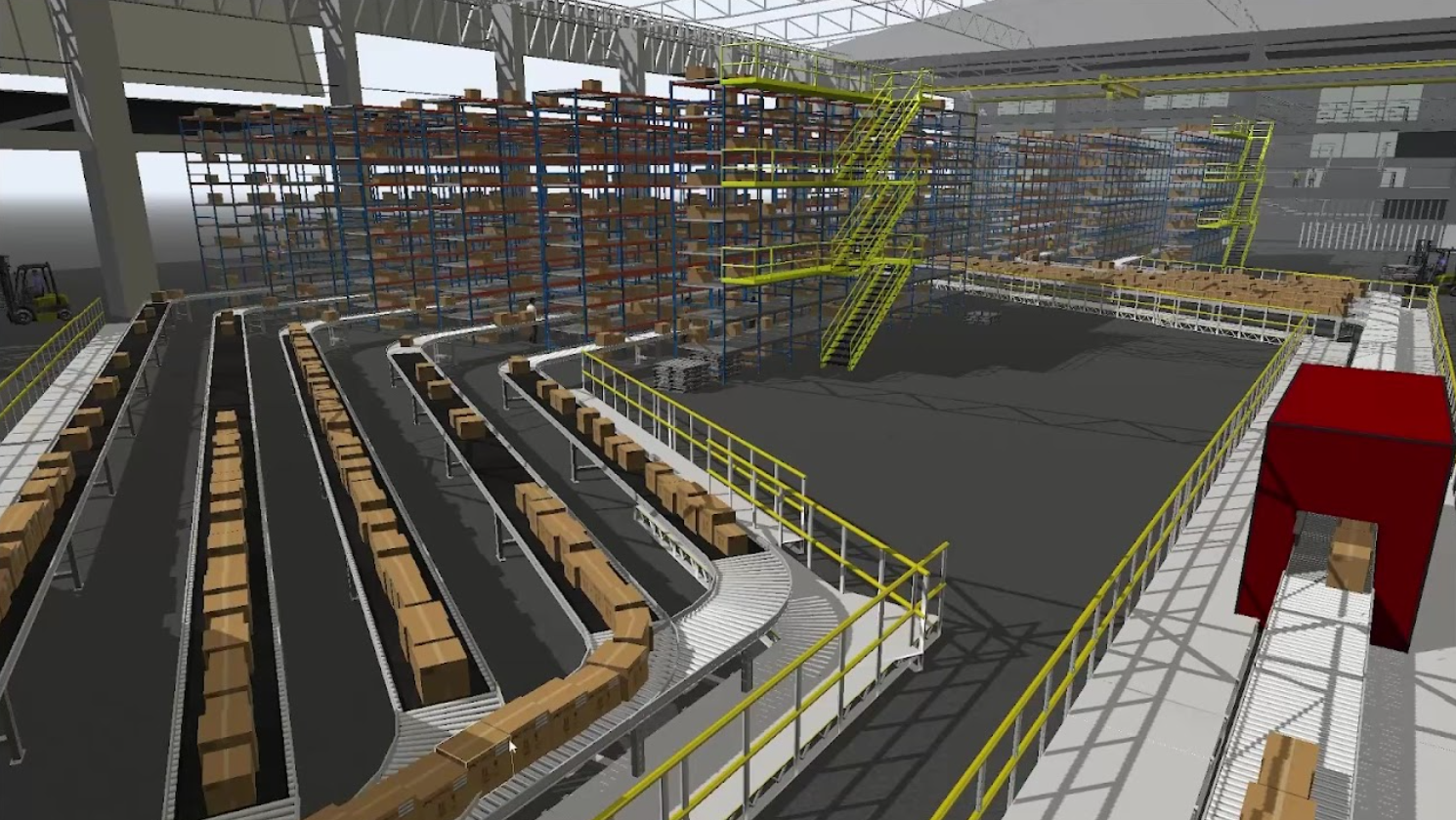

图形性能提高 4 倍

凭借第三代 RT 内核和人工智能驱动的 DLSS 3 , NVIDIA L4 GPU 为基于人工智能的化身、 NVIDIA Omniverse 虚拟世界、云游戏和虚拟工作站提供了近 4 倍的高性能。它使您能够构建实时电影质量的图形和令人难以置信的详细场景,以获得身临其境的视觉体验,这在 CPU s 中是不可能的。

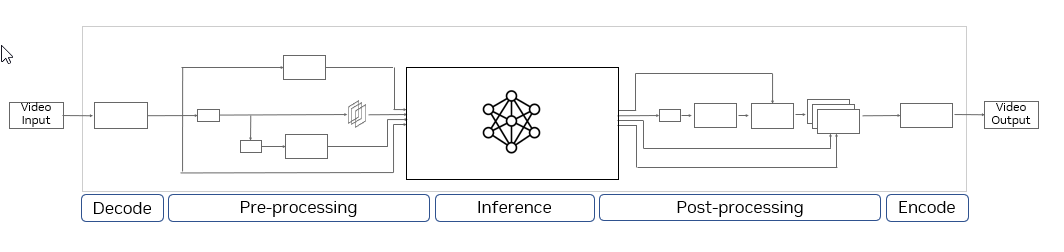

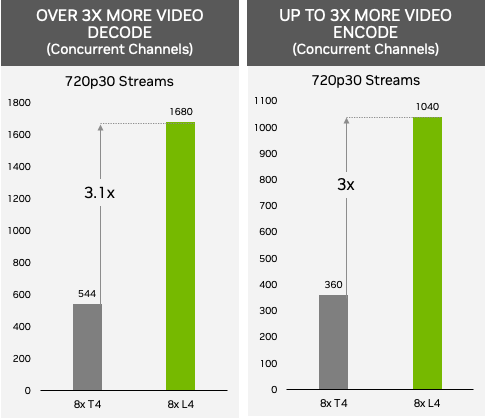

实时 AI 视频管道性能

截至目前, 80% 的消费者互联网流量是视频。无论是向数百万观众直播,让用户能够构建创意故事,还是提供身临其境的 AR / VR 体验,配备 L4 GPU 的服务器都可以同时以 720p30 的速度为移动应用程序托管多达 1000 多个 AV1 视频流。性能是通过带有 p1 预设的 AV1 低延迟编码来衡量的。

此外, L4 GPU 可以以多种分辨率和格式流式传输到多个平台,从而能够在包括社交媒体平台在内的更多频道上同时播放。

实测性能。视频解码:使用 FFMPEG 5.0.1 的 NVIDIA L4 ( H.264 720p30 )与 NVIDIA T4 ( H.264 720p30 )。视频编码(低延迟 p1 预设):使用 FFMPEG 5.0.1 的 NVIDIA L4 ( AV1 720p30 )与 NVIDIA T4 ( H.264 720p30

凭借第四代 Tensor Core 技术,增加了 FP8 精度支持, 1.5 倍大的 GPU 内存, NVIDIA L4 GPU s 与 CV-CUDA library 配对,将视频内容理解提升到了一个新的水平。

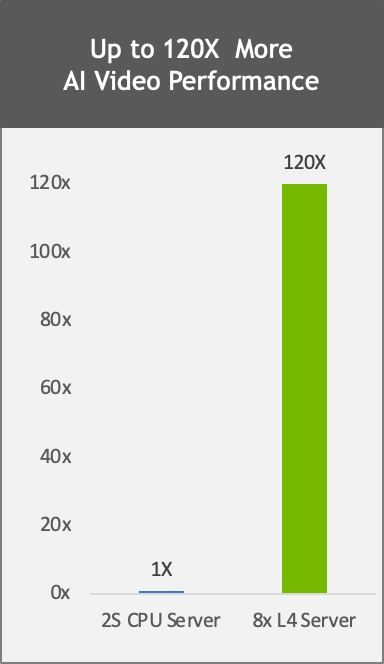

L4 GPU 为整个端到端管道提供了比基于 CPU 的解决方案高 120 倍的 AI 视频性能。这使企业能够获得实时见解,以提供个性化内容,提高搜索相关性,检测令人反感的内容,并实施智能空间解决方案。

Measured performance: 8x L4 与 2S Intel 8380 CPU 服务器性能比较, 具有 CV-CUDA 预处理和后处理、解码、推理( SegFormer )、编码、 TRT 8.6 的端到端视频管道与使用 OpenCV 4.7 的仅 CPU 管道相比, PyT 推理 。

AI 视频的高能效

随着人工智能和视频的普及,对高效、高性价比计算的需求比以往任何时候都更加增长。与传统的基于 CPU 的基础设施相比, NVIDIA L4 GPU 的 AI 视频性能提高了 120 倍,能效和拥有成本提高了 99% 以上。这使企业能够减少机架空间,显著降低总体碳足迹,同时使其数据中心能够扩展到更多的用户。

在 5MW 数据中心从 CPU 切换到 NVIDIA L4 所节省的能源可以为近 6000 户家庭或 carbon offset from 500,000 trees grown over 10 years 供电 1 年。

客户成功案例

以下是早期访问客户在评估 L4 GPU 及其当前解决方案时的一些用例和见解。

断裂

Snap 的可视消息应用程序 Snapchat 使用 NVIDIA GPU 对大量视频进行转码,最终为他们的社区提供尽可能好的视频质量。

“ 秒 napchat 的视频转码管道每天处理数百万个视频,重点是为 7.5 亿月活跃的 Snapchatter 提供尽可能好的质量。

Snap 的转码团队与 NVIDIA 合作,利用 GPU 加速,成功将 HEVC 转码成本降低了 80% 。 Snap 媒体交付平台工程经理余佳耀表示:“他们的团队对 NVIDIA L4 GPU 支持 AV1 的潜力感到兴奋,根据早期测试,他们看到了显著的质量改进和带宽减少,吞吐量与 GPU HEVC 转码类似。”。

快手

Kuaishou 提供了一个世界领先的内容社区和社交平台。全球数亿用户使用快手制作短视频,用特效编辑,并分享给他们的追随者。

快手有几个关键服务正在使用 NVIDIA 推理平台 A10 和 L4 GPU :

- 直播内容推荐系统 使用 GPU 以合理的基础设施成本提高用户对直播内容点击率( CTR )的预测。该工作流程有多个阶段,包括解码传入的直播视频、捕捉关键帧、执行任何必要的音频和视频解复用以及图像处理,最后使用基于 transformer 的大规模模型来理解多模态内容并提高 CTR 。

- 另一个系统使用 自然语言处理 ( NLP )、 ViT 和 Swin 视觉 transformer 来识别视频中的文本,以增强视频搜索的相关性。

- 广告投放和电子商务系统 向用户推荐直播和视频,用于推广商业商品。 L4 GPU 的人工智能和视频分析功能加速了系统对商业品牌和产品功能的理解,使其目标定位与用户更加相关。去年,即 2022 年,电子商务商品总值( GMV )超过 1000 亿美元。

快手高级副总裁 Yue YU 表示:“快手推荐系统为一个拥有超过 3.6 亿每日用户的社区提供服务,他们每天贡献数百万 UGC 视频。”。“与相同总拥有成本下的 CPU 相比, NVIDIA GPU 将系统端到端吞吐量提高了 11 倍,并将延迟减少了 20% 。”

描述

Descript 是一款基于人工智能的生成视频编辑应用程序,托管在谷歌云上,帮助人们快速编辑博客、纪录片和视频内容。 Descriptt 的人工智能功能和直观的界面为 YouTube 和 TikTok 频道、顶级播客以及使用视频进行营销、销售、内部培训和协作的企业提供了动力。使用 Descriptt ,编辑可以受益于人工智能自动删除填充词、建议字幕、添加字幕等功能。

“使用 Descriptt 的视频和音频转录管道进行的 L4 测试显示,与 T4 相比,性能提高了 150% 。这将使我们能够支持 50% 以上的用户使用相同数量的服务器进行基于文本的编辑,” Descriptt 人工智能主管 Kundan Kumar 说。

万博

WOMBO 是一家领先的移动应用程序开发商,也是消费者领域生成人工智能图像创建的领导者之一。 WOMBO Dream ,他们的主要应用程序已经被下载了 5500 多万次,平均每天生成 300 万张图像。他们今天在 NVIDIA GPU 上使用稳定扩散进行图像推理,最近评估了 L4 GPU s 。

WOMBO 首席执行官 Ben Zion Benkhin 表示:“ WOMBO 依靠最新的人工智能技术,让人们从用户提示中创作出身临其境的数字艺术品,让他们只需一个想法就可以创作出任何风格的高质量、逼真的艺术。”。“ NVIDIA L4 推理平台将使我们能够为寻求创作和分享独特艺术品的用户提供更好、更高效的图像生成体验。 ‘

用于药物发现的薛定谔分子模拟

Schrödinger 使用 GPU s 进行自由能微扰( FEP +)计算,以模拟蛋白质与配体的相互作用 in silico 。他们的数字化学平台被世界各地的药物发现研究人员使用。

薛定谔和 NVIDIA 合作优化分子动力学模拟的性能。分子动力学计算发生在需要计算模拟的时间尺度上。所使用的硬件决定模拟需要几天、几小时还是几分钟。

Schr ö dinger 评估了其在多代 NVIDIA GPU 上的 GPU – 加速分子动力学模拟: NVIDIA Pascal 、 NVIDIA Volta 、 NVIDIA Turing 和 NVIDIA Ampere 架构。他们发现,新的 NVIDIA Ada Lovelace 架构 L4 GPU 为分子动力学模拟提供了最佳的性价比。

CP 全部

CP All 是泰国 11000 多家 7-11 便利店的唯一持牌运营商。 CP All 的 IT 服务公司 Gosoft 部署了基于 NVIDIA 对话式人工智能平台的客户服务机器人,以帮助回答常见问题和跟踪订单。 CP All 副总经理 Areoll Wu 表示,这些机器人懂泰语和说泰语的准确率为 97% 。通常, Gosoft 每天会接到 250000 个电话。

Areoll Wu 表示:“为数百万用户提供卓越的客户体验对我们来说至关重要。这就是为什么我们很高兴能将 NVIDIA L4 和 Riva 用于我们的泰国端到端对话人工智能( ASR + NLP + TTS )服务。它的性能提高了 3 倍,延迟减少了 50% 以上,使我们的服务比以往任何时候都更好。”, CP All Public Company Limited (泰国)副总经理。

如何访问 NVIDIA L4 GPU ?

有几个选项可供选择,平台列表将在 2023 年全年扩展。

- 谷歌云平台( GCP )是第一个宣布 NVIDIA L4 实例的云平台,目前可通过私人预览访问。

- 它们可从 30 多家计算机制造商的全球网络中获得,包括 Advantech 、 ASUS 、 Atos 、 Cisco 、 Dell Technologies 、 Fujitsu 、 GIGABYTE 、 Hewlett-Packard Enterprise 、 Lenovo 、 QCT 和 Supermicro 。

- 您还可以通过 NVIDIA LaunchPad 访问 L4 GPU ,并通过我们的免费实践研讨会和 NVIDIA AI Enterprise 实验室了解更多信息。

在 GTC Accelerate your AI/ML and HPC Workloads with Google Cloud 2023 会话中了解有关 NVIDIA GPU 云实例的更多信息。