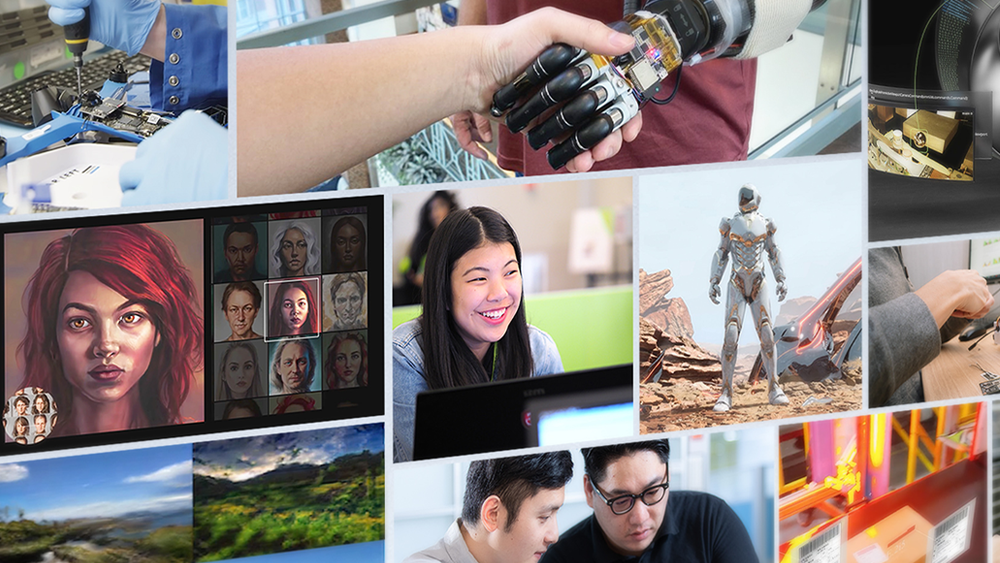

在过去的一年里,NVIDIA 宣布了在对话人工智能方面的几项重大突破,用于构建和部署自动语音识别( ASR )、自然语言处理( NLP )和文本到语音( TTS )应用程序。

为了让开发者在云 GPU 加速环境中快速入门, NVIDIA 深度学习培训中心( DLI ) 提供了三个快速、免费、自定进度的课程。

你会学到什么?

这些教学性 DLI 课程让开发者体验如何使用现代工具快速创建对话式 AI 和 NLP GPU 加速应用程序。学习目标包括:

- 使用 TAO 工具箱训练文本分类模型

- 在 SST-2 数据集上训练并微调 BERT 文本分类模型。

- 对模型进行评估和推断。

- 将模型导出为 ONNX 格式或 Riva 格式以进行部署。

- 使用 Riva 部署文本分类模型

- 使用 Riva ServiceMaker 获取 TAO 导出的 Riva 模型,并将其转换为最终部署。

- 在 Riva 服务器上本地部署模型。

- 使用 Riva API 绑定从演示客户端发送推断请求。

- Riva 语音 API 演示

- 将音频发送到 ASR 型号并接收回文本。

- 使用 NLP 模型转换文本、分类文本和分类标记。

- 向 TTS 型号发送文本并接收回音频。

课程完成后,开发者将熟悉:

- 如何使用 NVIDIA TAO 工具包在 NVIDIA GPU 上训练、推断和导出文本分类模型。

- 如何在 NVIDIA GPU 上使用 NVIDIA Riva 部署文本分类模型。

- 如何从示例客户端构造对 NVIDIA Riva 语音服务器的请求。

为什么文本分类有用?

文本分类回答了这个问题:这段文本属于哪一类?例如,如果你想知道电影评论是正面的还是负面的,你可以使用两个类别来建立一个情绪分析项目。

更进一步,使用几个类别按主题对句子或文档进行分类。在这两个用例中,您都从预先训练好的语言模型开始,然后使用示例分类文本“训练”分类器来创建文本分类项目。

诚然,文本分类只是使用预先训练的语言模型来理解书面语言的许多 NLP 任务之一。一旦开发人员尝试使用 NVIDIA TAO 工具包和 NVIDIA Riva 来培训和部署 文字分类 项目,他们将能够将这种经验扩展到其他 NLP 任务,例如 命名实体识别( NER ) 和 问答 。

NVIDIA Riva 语音 API 是如何工作的?

Riva 语音 API 服务器公开了一个用于执行语音识别、语音合成和各种 NLP 推断的简单 API 。在本课程中,开发人员使用 Python 示例从 Riva 示例客户机中运行其中几个 API 调用。服务器预填充了 ASR 、 NLP 和 TTS 模型。这些内置模型允许开发人员轻松快速地测试几个对话 AI 组件。

开始学习 NLP 和对话人工智能

- 使用 TAO 工具箱训练文本分类模型 ( 60 分钟)

- 使用 Riva 部署文本分类模型 ( 30 分钟)

- Riva 语音 API 演示 ( 30 分钟)